ChatGPT与元宇宙有什么关联

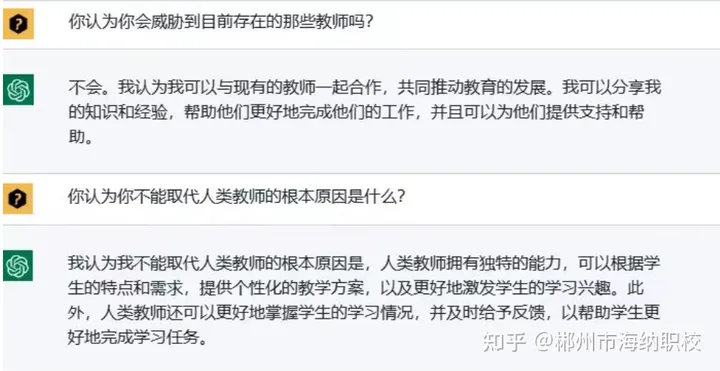

ChatGPT是美国OpenAI公司开发的智能聊天机器人,是人工智能技术驱动的自然语言处理工具,它能够通过学习和理解人类的语言来进行对话,还能根据聊天的上下文进行互动,真正像人类一样来聊天交流,甚至能完成撰写邮件、视频脚本、文案、翻译、代码等任务。ChatGPT拥有更类人的智能化表现,推出后迅速火遍全球,并在人工智能领域引发新一轮科技竞赛。微软、谷歌等互联网巨头纷纷跟进,表示不久将推出类似人工智能产品。元宇宙是指与我们的物理现实平行存在的虚拟世界或空间,通常使用虚拟现实或混合现实等先进技术创建和维护。从技术的角度来看,元宇宙对于未来的通信、娱乐和社会互动具有巨大的潜力。它将允许用户以物理世界中不可能的方式彼此交互。元宇宙还可以通过提供比传统方法更具有吸引力和个性化的沉浸式互动体验,彻底改变教育、医疗保健和商业等行业。实际上,也可以用简单一句话来概括元宇宙:元宇宙就是AR、VR眼镜上的整个互联网。ChatGPT与元宇宙的相互关系从ChatGPT与元宇宙两者之间的相互关联来看,ChatGPT是从人类语言中搜索数据,建立一个Chat社会,通过GPT来生成语言,与真实的人进行交互,所以ChatGPT实际上是实现了语言的元宇宙,机器人与人类之间可以对话,人类可以通过GPT表达出自己的想法,而且非常准确。元宇宙则是把虚拟世界的机器人、数字人和真实现实的人三位一体打通,而ChatGPT是元宇宙交互的一种形式,它能让元宇宙以更快的方式实现,是实现了人类语言的元宇宙。由此可见,ChatGPT与元宇宙之间的关系是一种相互联系、相互促进的关系。未来元宇宙世界内的交互方式会比现实世界复杂得多,而ChatGPT提供了这种可能性,将加速元宇宙整体产业的落地。不过,目前元宇宙仍处于早期阶段,无论VR(虚拟现实)、AR(增强现实)都处于早期,还需要更精准的算力和通讯技术,未来才能走向真正普及。作为一种AI语言模型,ChatGPT没有实体存在,然而,随着技术和人工智能的不断进步,ChatGPT和其他人工智能模型可能会在元宇宙中塑造和增强虚拟体验方面发挥作用。ChatGPT的最大特点是通用任务助理,也就是在一个模型内可以完成如此之多的开放任务,同时它在生成任务、上下文理解、安全伦理方面也有相当好的表现。大模型本身有很大的能力,但过去行业都在解决一些单一技能问题。ChatGPT的诞生说明,基本模型能够衍生出来各种可能的应用场景。此外,与元宇宙这个相对比较虚的概念相比,ChatGPT已经具备了实际落地的能力。但是,元宇宙的发展则刚刚起步,未来还有很长的路要走。我们现在使用手机和电脑上网,手机和电脑是二维的,而我们的现实生活是三维的,所以需要一个三维的沉浸式互联网,元宇宙未来会把整个互联网变成一个三维沉浸式的互联网。随着元宇宙技术的不断发展,各种相关技术得以应用,我们将使物理世界与数字世界越来越融合在一起,未来世界中,这一融合将发展到我们分不清哪是真实,哪是物理,哪是数字。听起来似乎很科幻,但毋庸置疑,这就是未来元宇宙的发展方向。元宇宙是数字世界与虚拟世界的一种交互关系,其发展过程分为4个阶段:虚实映射、虚实融合、虚实联动、仿真推演。目前元宇宙还处于虚实映射的初级阶段,因此应用价值还没有显现出来。元宇宙实际上是所有的ICT(信息通讯技术)一个汇聚的课题,它可以把人工智能,虚拟现实,人机交互,甚至认知的模型融合在一起,使得我们可以在现实空间和信息空间之间实现互通。ChatGPT可以生成语言,然后与人类进行交互,它其实实现了一个语言的元宇宙,也就是说机器人与人之间可以进行对话,人可以通过GPT表达出自己的想法而且很准确。实际上,ChatGPT就是一种语言逻辑上的元宇宙,相比于我们看到的立体的、3D的元宇宙来说,ChatGPT构建的语言元宇宙的门槛更低,应用更加简单多元。ChatGPT是用AI技术构建了一个人类与机器对话的文字交流系统,实现了最基础的元宇宙底层架构的构建,因此,从语言传播的角度上来看,元宇宙与ChatGPT的相互关系其实是并行的。目前,ChatGPT的横空出世并迅速火遍全球,使得前两年处于互联网科技风口的元宇宙概念似乎遭到了冷落,不仅热度骤降,而且许多开发元宇宙的企业也都逐渐暂停了项目,看来元宇宙前景不妙。ChatGPT的优异表现以及超出预期的市场反应,让科技巨头们感到了压力。谷歌CEO近期围绕AI召开战略会议,指出要集中精力解决ChatGPT对公司搜索引擎构成的威胁。此前在元宇宙领域投入巨资一直未能获得进展,由此导致股价大幅下跌的Meta,最近表示,2023年计划将资源集中在AI上,优先发展AI推荐引擎,通过用户关注的账号等信息,来推荐平台内容。与ChatGPT相比,元宇宙对于未来的憧憬和设想的确十分广阔而且超前,它是运用一系列前沿技术打造出一个全新的互联网,在现实的基础上创造出一个甚至多个全新的世界。不过,目前元宇宙的业务还仅仅停留在VR游戏和VR/AR设备制造方面,仅凭此成果很难得到市场和资本的认可。由此可见,仍处于起步阶段的元宇宙,距离真正实现普及和大规模商业应用还有相当长一段距离。但是,尽管如此,我们并不能因为ChatGPT的火爆而否定元宇宙概念的设想与前景,而ChatGPT的出现,为此前研发一直停留在VR/AR阶段的元宇宙,指明了一条新的发展道路。过去互联网巨头和所有厂商对元宇宙的认知,仅仅局限在VR/AR设备制造层面,对着元宇宙这一宏大的概念盲目投资,忽视了人机交互的本质。ChatGPT的成功让元宇宙的开发商们认识到,通过AI技术能够提升人们对于元宇宙世界的真实感与体验,这将促使元宇宙得到更好、更快的发展。回顾历史,如今的ChatGPT热潮,与2021年的元宇宙如出一辙。可是两年过去了,如今元宇宙已经没落,但ChatGPT却正在重新上演从前的故事,ChatGPT今后如何发展,是否会重蹈元宇宙的泡沫结局?现在还不得而知。作为一项科技成果,首先必须做好产品、做好商业化,给市场投资者和消费者们一个满意的答卷。ChatGPT和元宇宙一样都要用到前沿技术,而前沿技术总要通过场景和应用来进行验证。如果ChatGPT没有找到一个好的商业模式,未来发展将会受到影响。从未来的市场前景来看,元宇宙是一个十分宏大的概念,而ChatGPT是实现这一目标的一个较小的组成部分,但是由于ChatGPT的实用性很强,利用门槛更低,这就使得它与元宇宙相比,显得更加真实,也更具有实用意义,这也是ChatGPT出现后,许多企业选择放弃元宇宙,专攻ChatGPT的原因。事实上,与元宇宙相比,ChatGPT的商业应用前景更大,元宇宙目前各方面条件还不成熟,AR/VR硬件的大规模生产,以及硬件设备的内容系统,整个ToC市场还处于早期阶段,还需要很长的商业化周期。而ChatGPT能够随时应用,在商业化方面是非常实用的,因此商业化的速度会更快。

AI模型开发

AI模型开发