文章主题:刘佳玮, 推荐

@刘佳玮 推荐

#Knowledge Graph Embedding

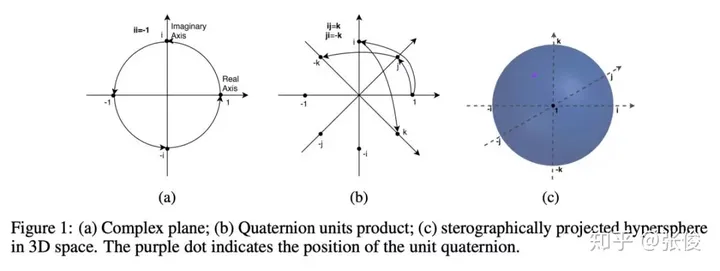

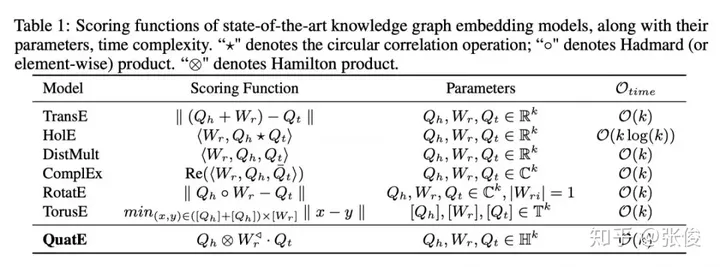

这篇文章是由新南威尔士大学团队于2019年在NeurIPS会议上发表的。这项研究突破性地将传统复值表示形式超越,为模型实体和知识图嵌入关系带来了更为丰富的表示方式,也就是所谓的四元嵌入。其中,四个虚部超复数值嵌入用于表示实体,而关系则被构建在四元数空间中的旋转上。这种创新性的表示方法不仅提高了模型的表现力,还为实体和关系的表示提供了全新的视角。

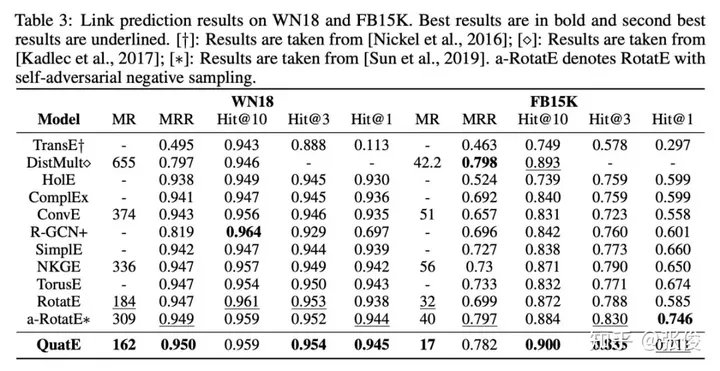

这篇文章所提出的方法具有以下三个主要优点:首先,它巧妙地利用了汉密尔顿积分来捕捉各个组件间潜在的相互依赖性,从而推动实体与关系之间的互动更为紧密;其次,四元数在四维空间中能够进行表达式旋转,相较于复杂平面中的旋转,其自由度更大;最后,该框架是对ComplEx在超复数空间上的扩展,同时提供了更加精确的几何解释,满足了关系表示学习的核心需求,包括对称性、反对称性和反演。根据实验数据显示,本文的方法在四个知识图谱完成基准上展现出了最卓越的性能表现。

论文链接:https://www.paperweekly.site/papers/3221

源码链接:https://github.com/cheungdaven/QuatE

@kilifunny 推荐

#Semi-Supervised Learning

这篇文章由Google Research团队撰写,该方法融合了自洽正则化、最小化熵和传统正则化的优点,通过整合这三者的长处,并弥补各自的不足,从而提出了MixMatch的方法。在CIFAR-10数据集上,只需采用250个标签数据,就能实现11%的错误率,这一成果显然超越了许多主流方法。

论文链接:https://www.paperweekly.site/papers/3035

源码链接:https://github.com/google-research/mixmatch

@jhy1993 推荐

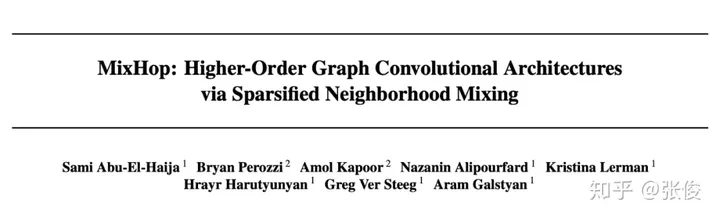

#Graph Neural Networks

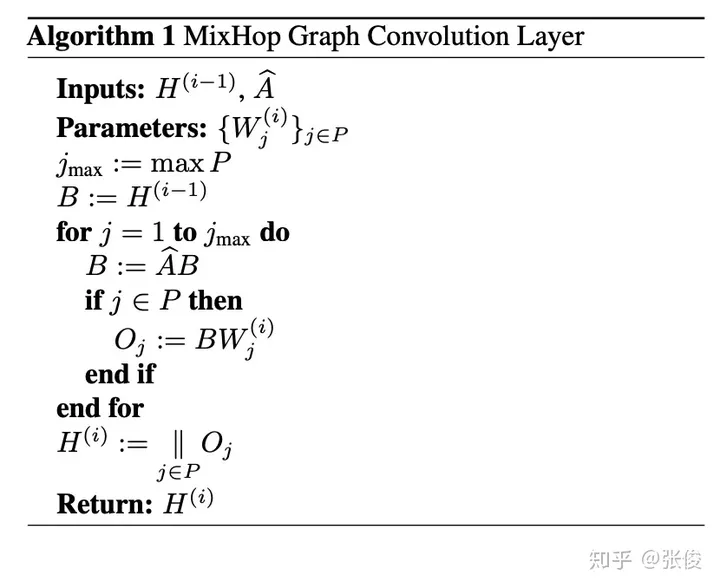

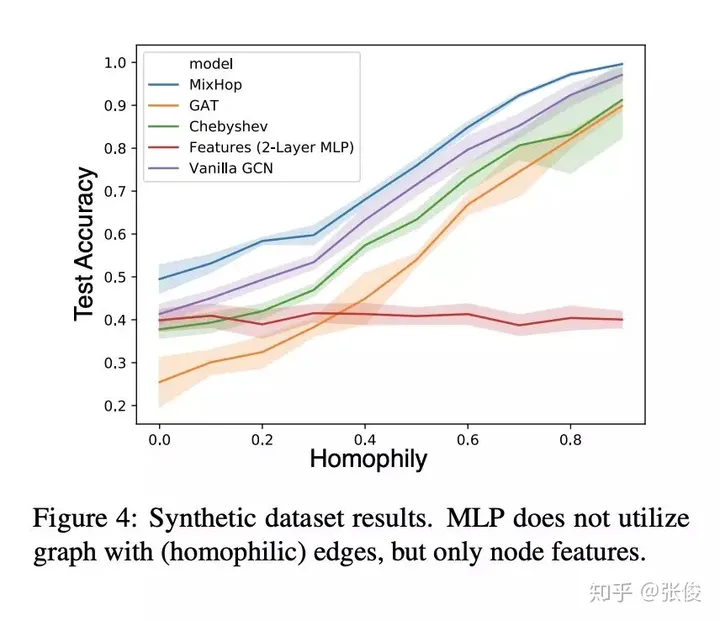

这篇文章是由Bryan Perozzi率领的图分析团队于2019年在ICML上发布的一项研究成果。文章指出,当前流行的GNN模型尚无法掌握一种普遍适用的邻居混合信息学习方法。为了解决这个问题,研究人员提出了一种名为MixHop的新方法,旨在融合不同层次邻居的信息,从而更好地学习节点表示。

MixHop 是一种高效的方法,同时具备深厚的理论基础,该方法在理论和实践中都展现出了卓越的性能。尤其是它能够将不同层次的信息进行混合,从而在一定程度上解决了 GNN 过平滑的问题。所谓的 GNN 过平滑问题是指,随着网络层数的增加,GNN 学习到的节点表示逐渐失去区分度。为了证明 MixHop 的有效性,作者进行了大量实验,并取得了显著的成果。

在学术界的重要平台 Citeseer、Cora 和 Pubmed 上,研究团队针对 MixHop 的性能进行了大量实验。尽管 MixHop 并未采用注意力机制来深入挖掘邻居信息的影响,但实验结果表明其表现仍然显著优于 GAT。这充分展示了 MixHop 强大的学习能力和适应性,使其在无注意力机制的情况下仍能脱颖而出。

论文链接:https://www.paperweekly.site/papers/3216

源码链接:https://github.com/samihaija/mixhop

@tron1992 推荐

#Image Segmentation

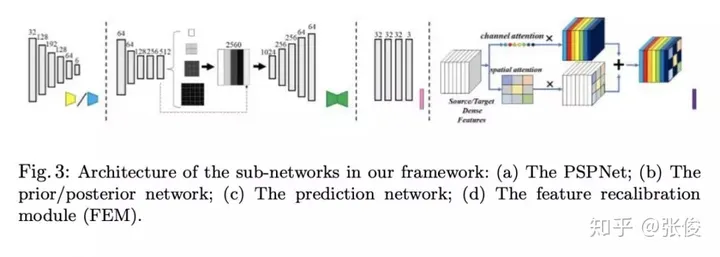

本文来自厦门大学、腾讯优图、中山大学和香港中文大学。论文提出了一种新的不确定度计算方式,尝试利用不确定度解决无监督域适应的问题。此外,本文还提出了一种基于不确定度的损失。

论文链接:https://www.paperweekly.site/papers/3207

@马学喆 推荐

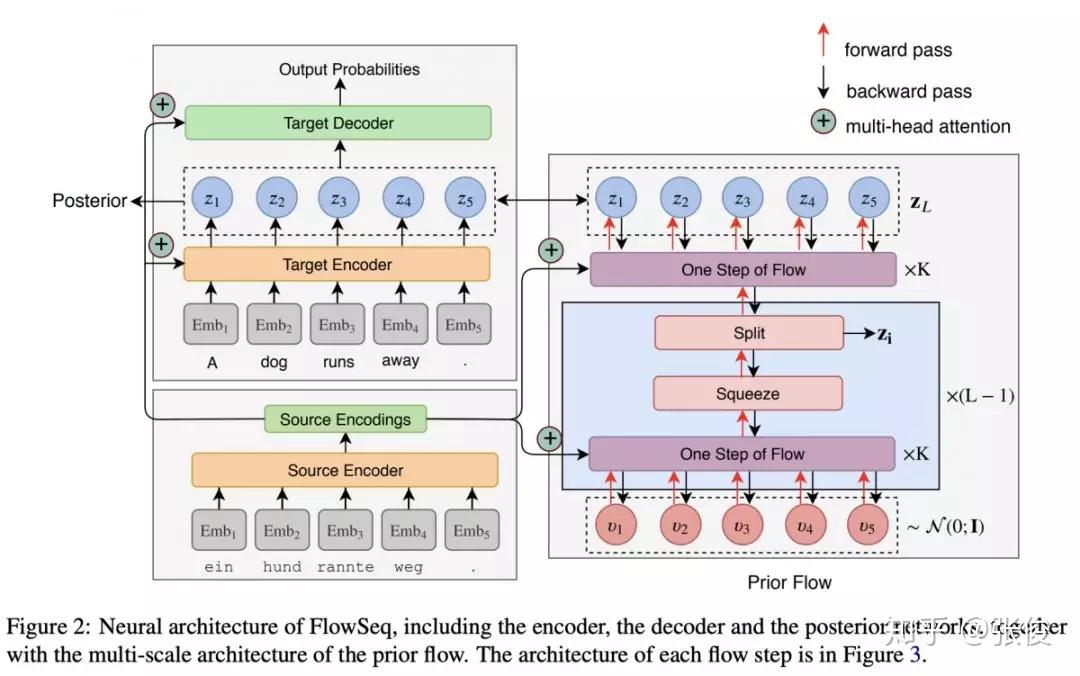

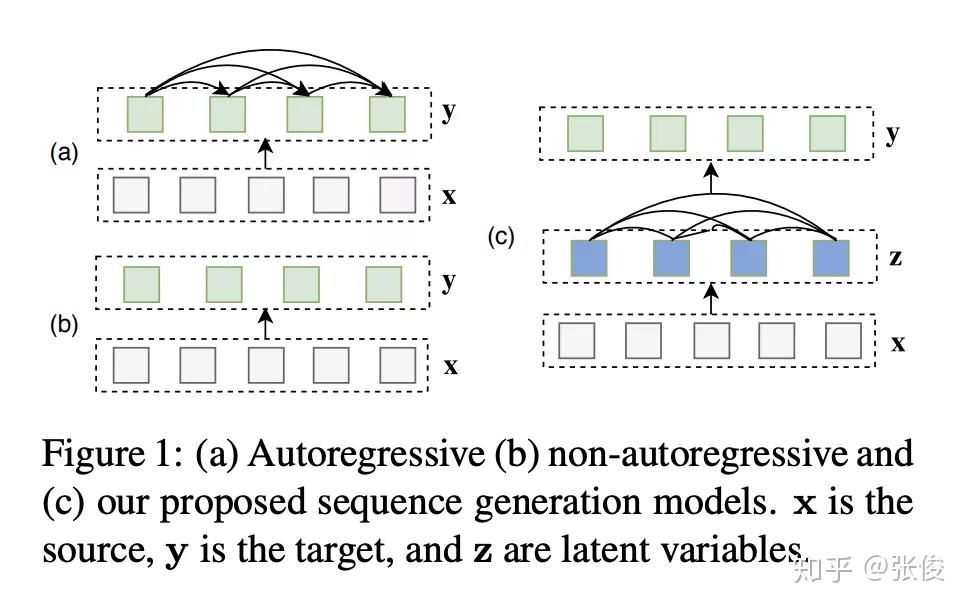

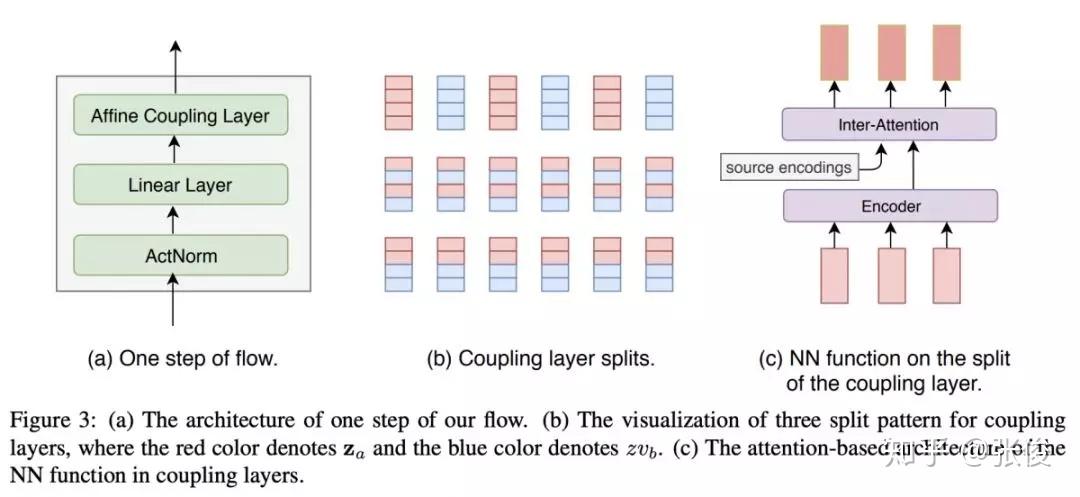

#Seq2Seq

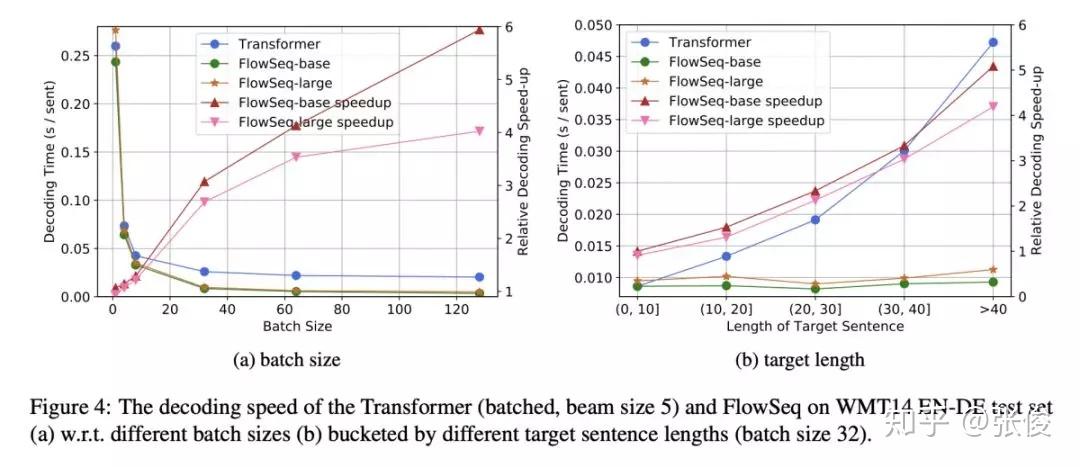

本文是 CMU 和 Facebook AI 联合发表于 EMNLP 2019 的工作。为了解决自自回归模型(auto regressive)在 Seq2Seq 问题上解码速度慢,只能利用一侧上下文信息等问题,提出了利用 generative flow 的非自回归模型(non-autoregressive)FlowSeq。在机器翻译任务上面的相比于之前的非自回归模型有显著提高,大大缩小了与自回归模型的差距。同时解码速度比自回归模型明显加快。

论文链接:https://www.paperweekly.site/papers/3218

源码链接:https://github.com/XuezheMax/flowseq

@SandraWu 推荐

#Video Representation Learning

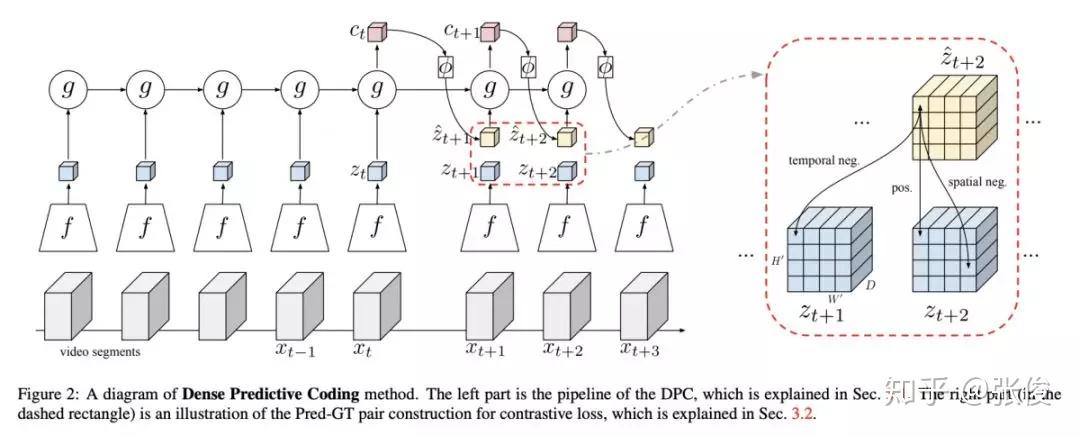

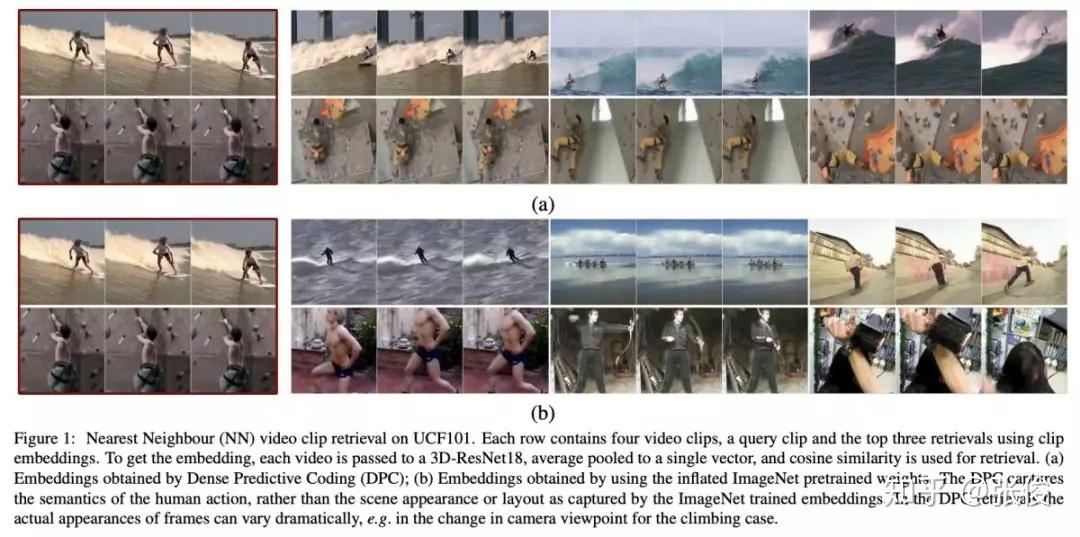

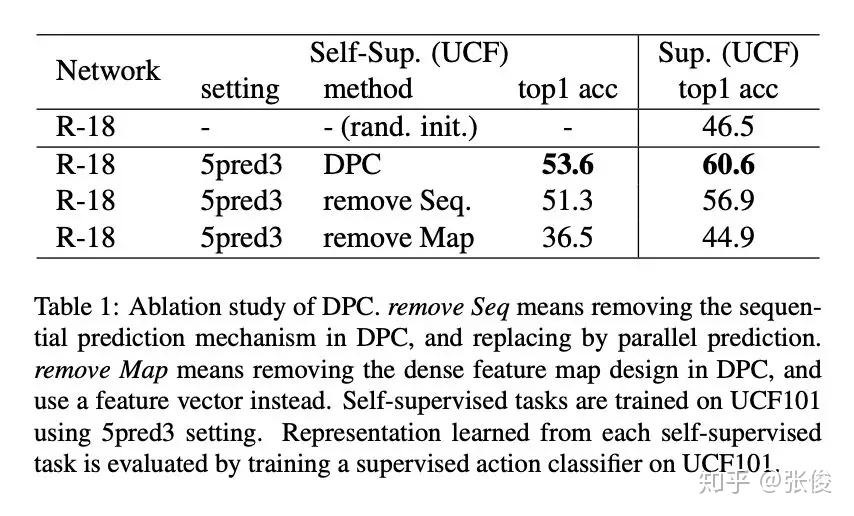

近期来自 VGG 的高质量工作,因为没有在主会议发表所以没有引起大范围关注,但保持了一贯低调又实用的风格。本文提出了一种新型的自监督学习(self-supervised learning)方法 Dense Predictive Coding,学习视频的时空表征,在动作识别任务(UCF101 和 HMDB51 数据集)上获得了 state-of-the-art 的正确率,并且用无需标注的自监督学习方法在视频动作识别上达到了 ImageNet 预训练的正确率。

自监督学习是利用无标注的数据设计代理任务(proxy task),使网络从中学到有意义的数据表征。本文设计的代理任务是预测未来几秒的视频的特征,并且用对比损失(contrastive loss)使得预测的特征和实际的特征相似度高,却不必要完全相等。因为在像素级别(pixel-level)预测未来的帧容易受到大量随机干扰如光照强度、相机移动的影响,而在特征级别(feature-level)做回归(regression)则忽视了未来高层特征的不可预测性(如视频的未来发展存在多种可能)。

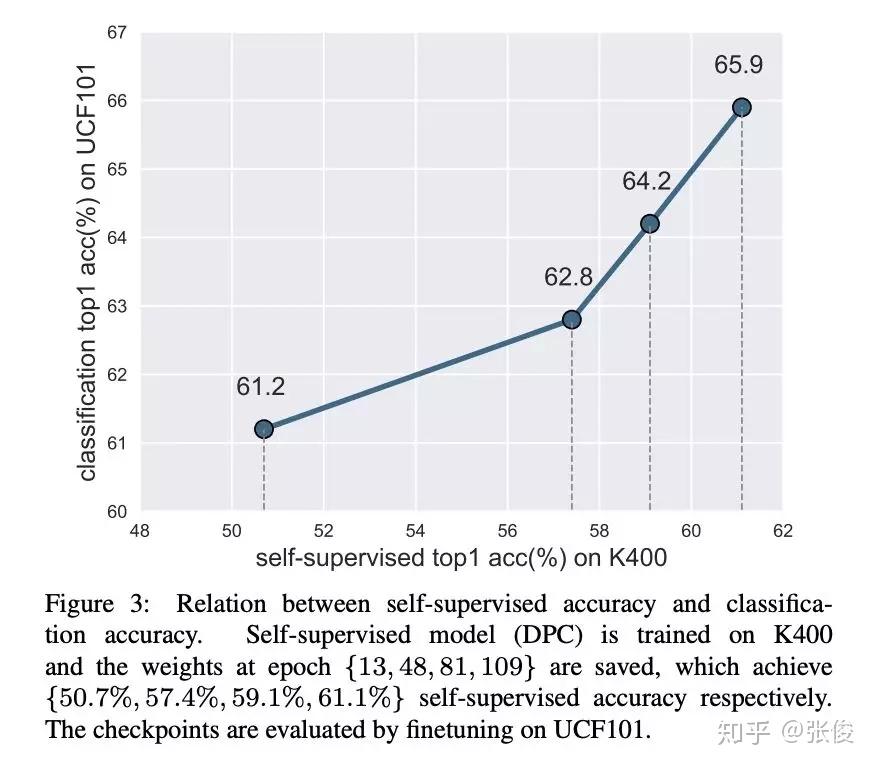

文中的设计促使网络学习高层语义特征,避免了网络拘泥于学习低层特征。作者在不带标注的 Kinetics400 上训练了自监督任务(Dense Predictive Coding),然后在 UCF101 和 HMDB51 上测试了网络所学权重在动作识别上的正确率。

Dense Predictive Coding 在 UCF101 数据集上获得了 75.7% 的 top1 正确率,超过了使用带标注的 ImageNet 预训练权重所获得的 73.0% 正确率。该研究结果证明了大规模自监督学习在视频分类上的有效性。

论文链接:https://www.paperweekly.site/papers/3222

源码链接:https://github.com/TengdaHan/DPC

@ziyuL 推荐

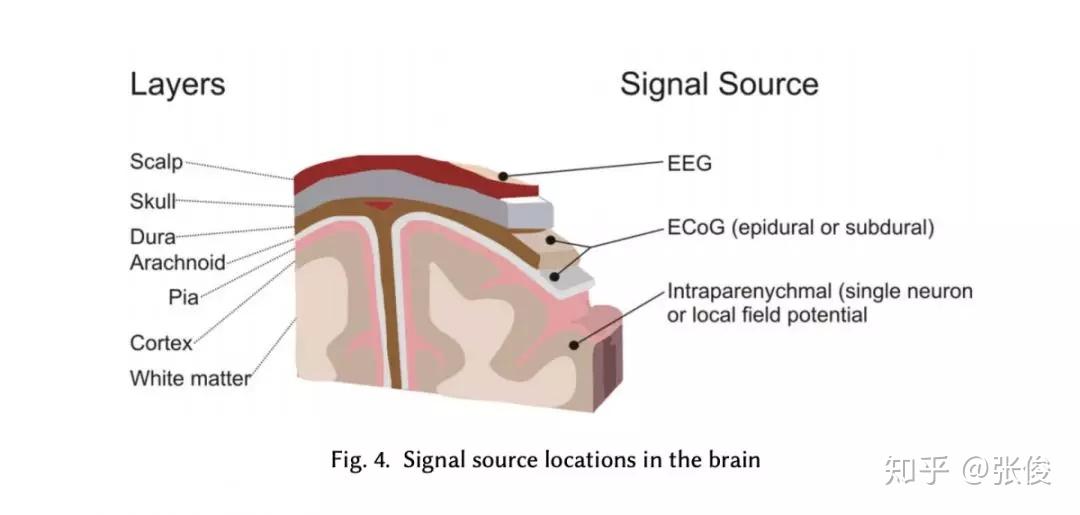

#Brain Computer Interface

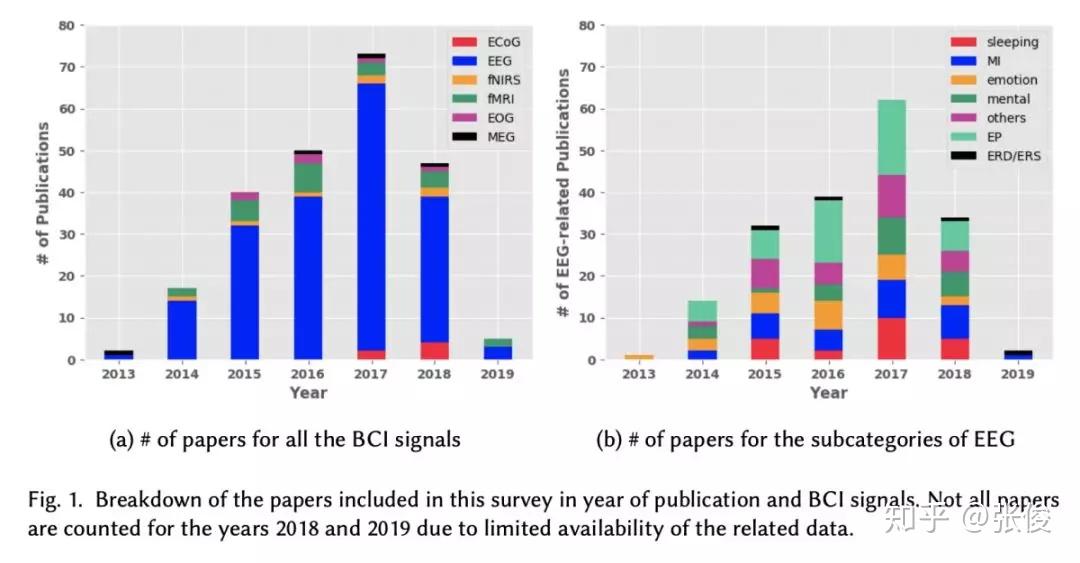

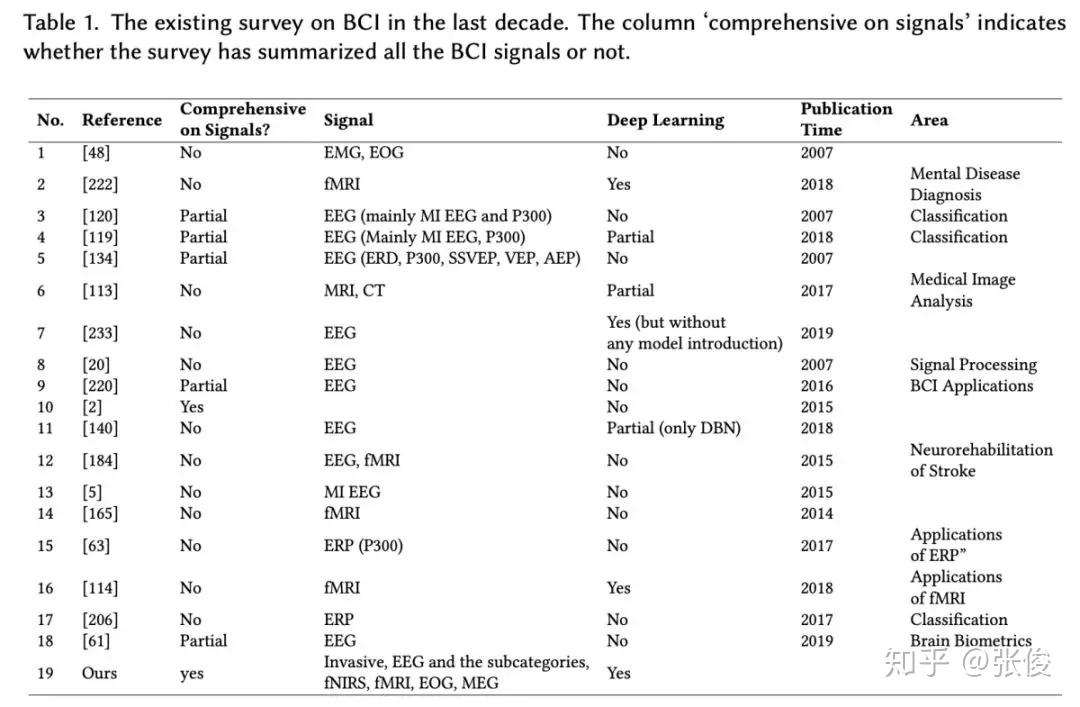

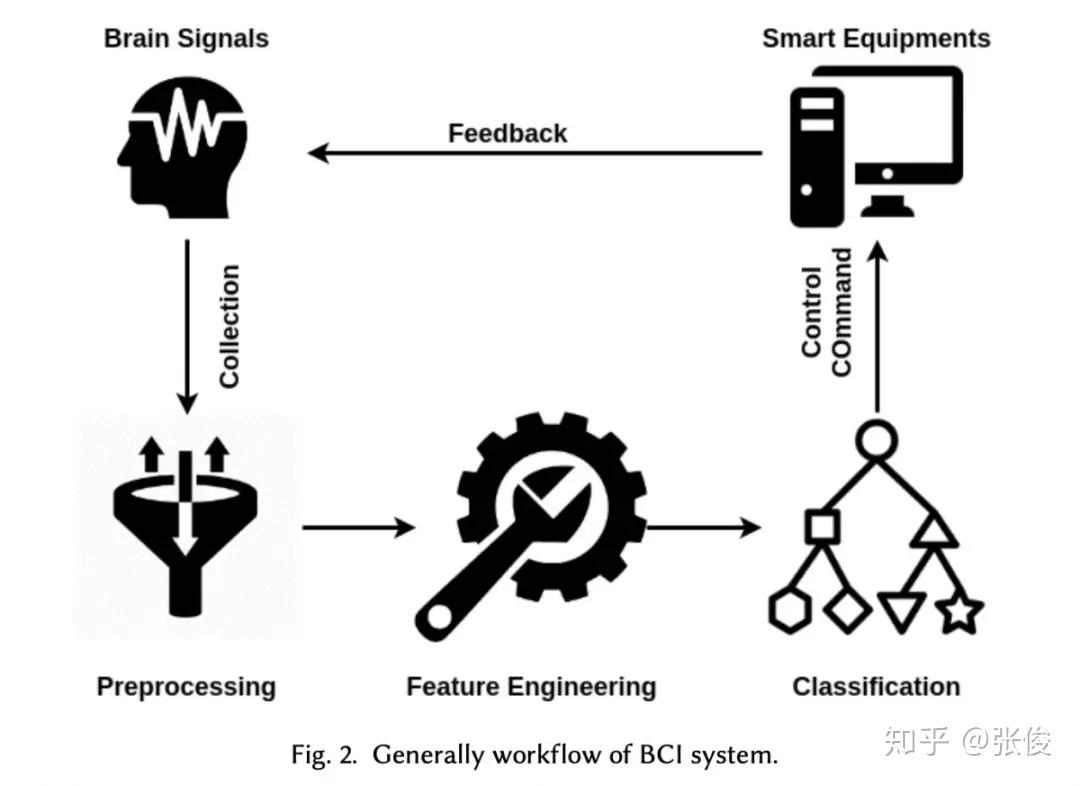

本文是一篇基于深度学习的脑机接口综述,总结了最近几年 250 余篇前沿研究,根据脑电信号将 BCI 分成了 7 大类,十余个小类,并对每一类的特性和适合的深度学习模型进行了详细的介绍。

另外,总结了脑机接口的应用场景,一共 8 大类 15 个小类,例如睡眠检测,脑部疾病诊断,智能家居等等。最后列出了算法和应用方面的一些挑战,并给出了一些思考和初步的探索(包括作者发表在 KDD,UbiComp, AAAI, IJCAI 等顶级会议的工作)。

论文链接:https://www.paperweekly.site/papers/3020

@jhy1993 推荐

#Intent Recommendation

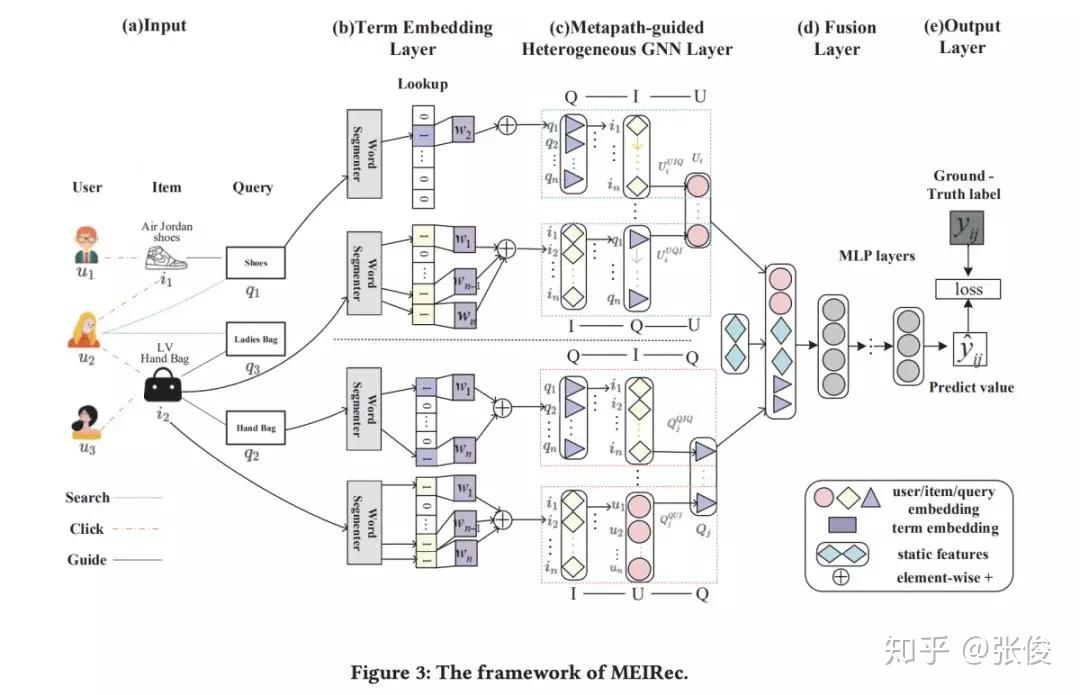

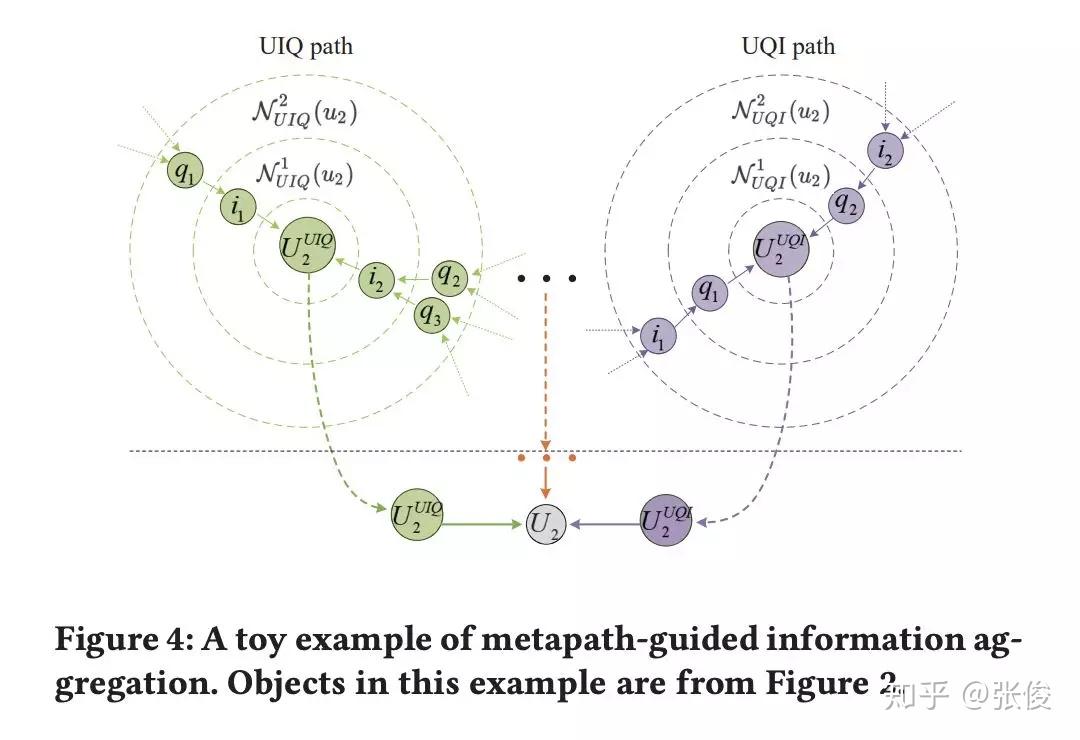

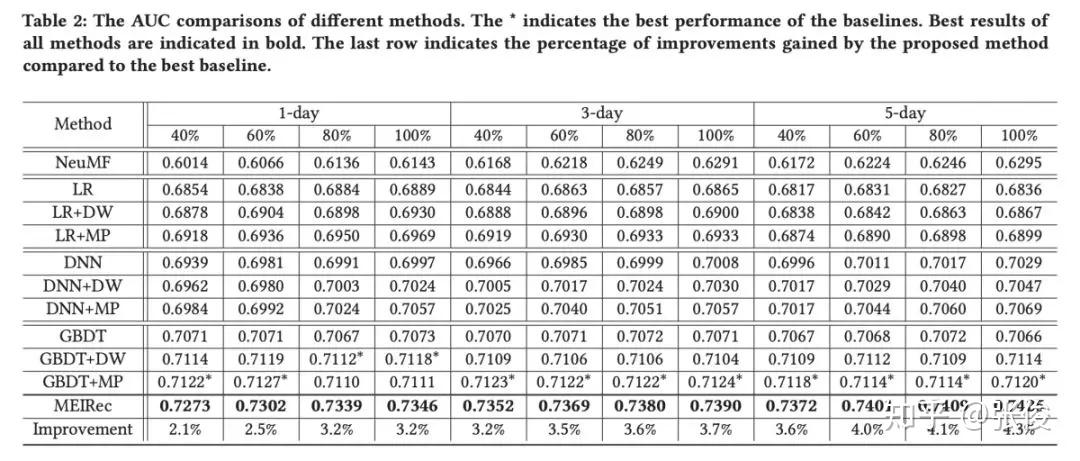

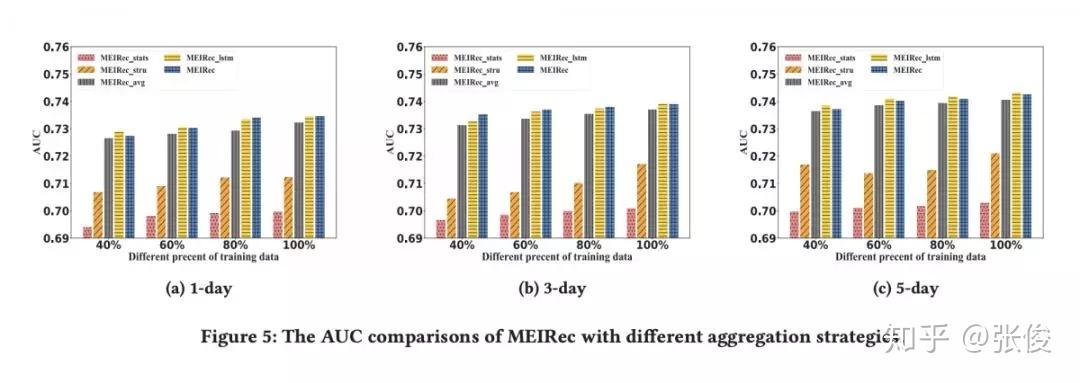

本文是北京邮电大学和阿里巴巴发表于 KDD 2019 的工作。针对手机淘宝的用户意图推荐,本文设计了基于异质图神经网络的意图推荐模型 MEIRec。

传统商品推荐为用户推荐商品,而意图推荐则关注于预测用户的意图。本文将意图推荐的业务场景建模为异质图(包含多种类型节点和关系的图),然后设计了 metapath-guided heterogeneous Graph Neural Network 来学习该业务场景下多种不同目标的表示。同时,本文也提出一种 term embedding mechanism 来降低大规模异质图场景下的参数量。最后,在淘宝真实场景下的 AB test 证明了 MEIRec 算法的优越性。

论文链接:https://www.paperweekly.site/papers/3208

源码链接:https://github.com/googlebaba/KDD2019-MEIRec

@bugman 推荐

#Text Generation

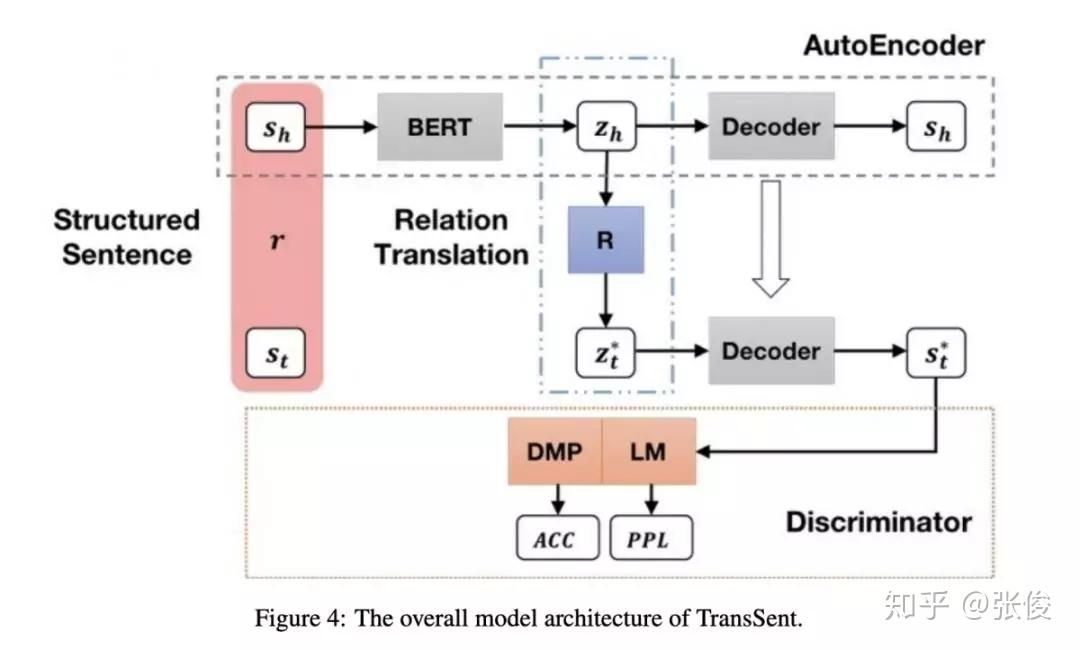

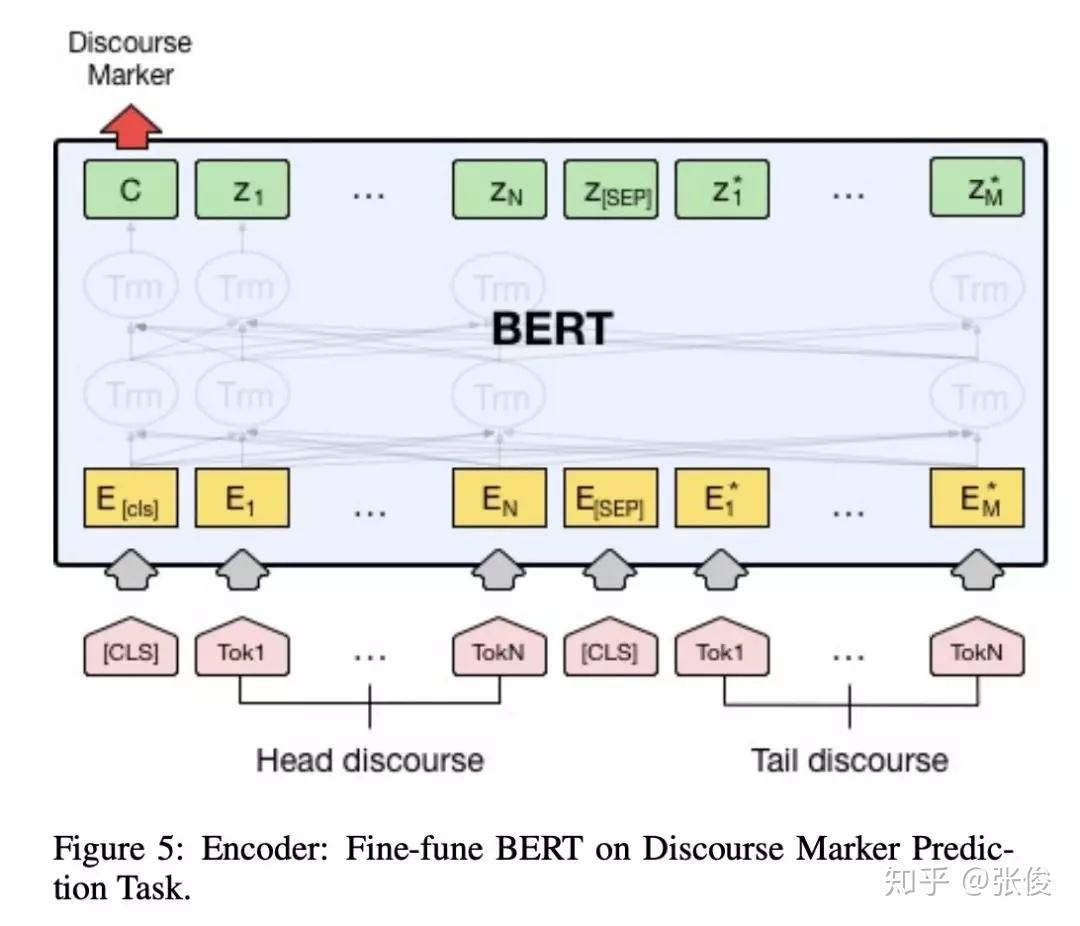

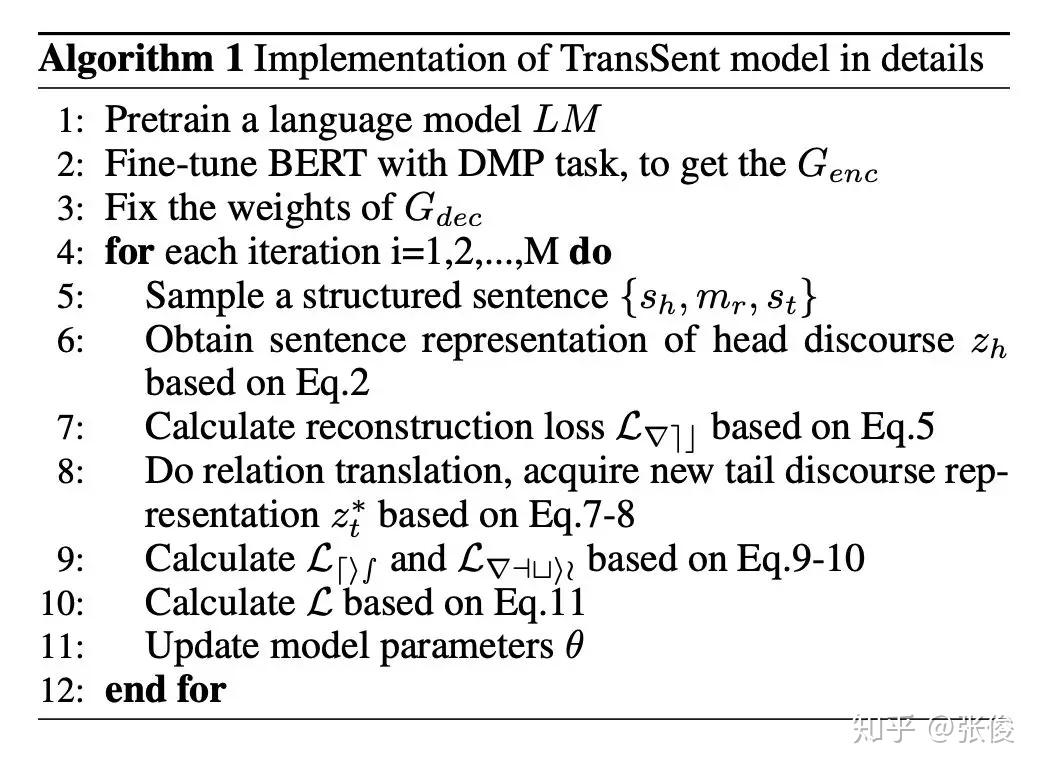

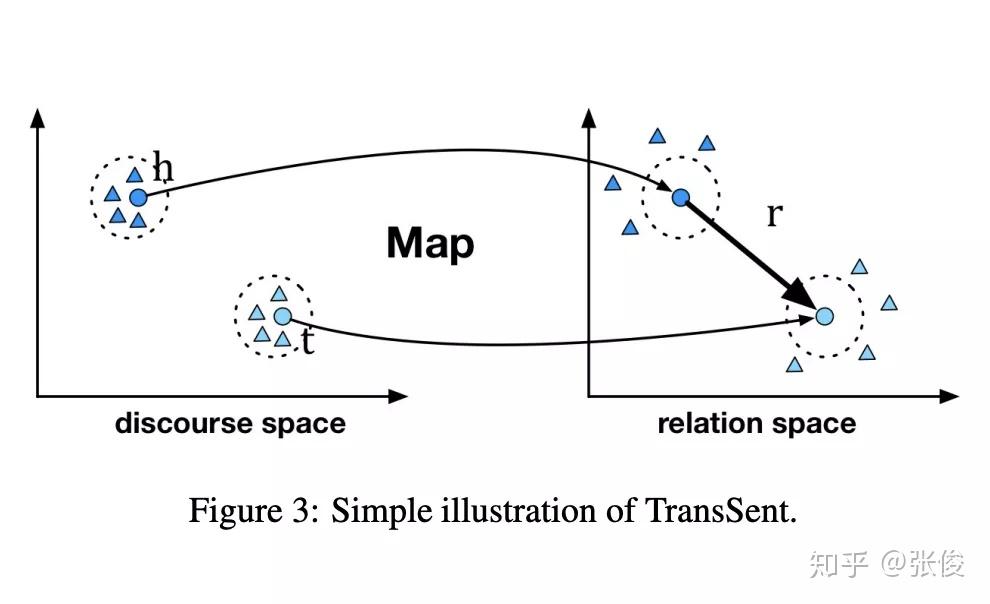

本文来自中科院,论文将知识图谱的 Trans 思想引入到句子表示空间,提出了一个新的任务 Sentence Transfer,为了解决这个任务构建了三个数据集。人会在写作的时候使用连词(discourse marker,比如 and, but, if…)来衔接子句(discourses),连词用来显式地表达前后子句之间的语义关系。

因此作者认为在 embedding space 中,子句之间可以利用连词(表示的关系)进行迁移/翻译。在学习出句子之间的 Trans 模型后,可以用来分阶段生成结构化长句:首先生成首子句,然后选择一种关系,再 Trans 生成尾子句。这样的生成方式可以和现有的问答等任务结合。作者还给出了一个数据集上的实验结果。总体来说本文给出了一个新的生成的思路,值得发掘。

论文链接:https://www.paperweekly.site/papers/3200

数据集链接:https://github.com/1024er/TransSent_dataset

@lijin 推荐

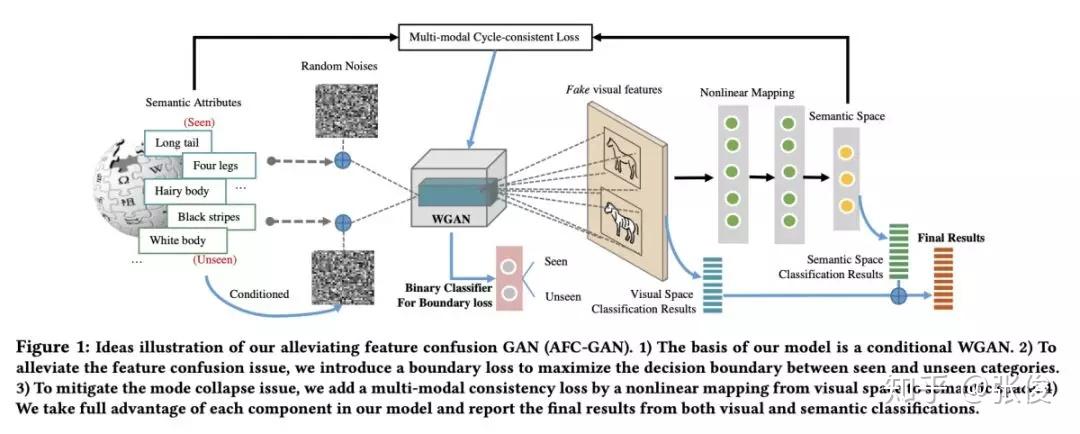

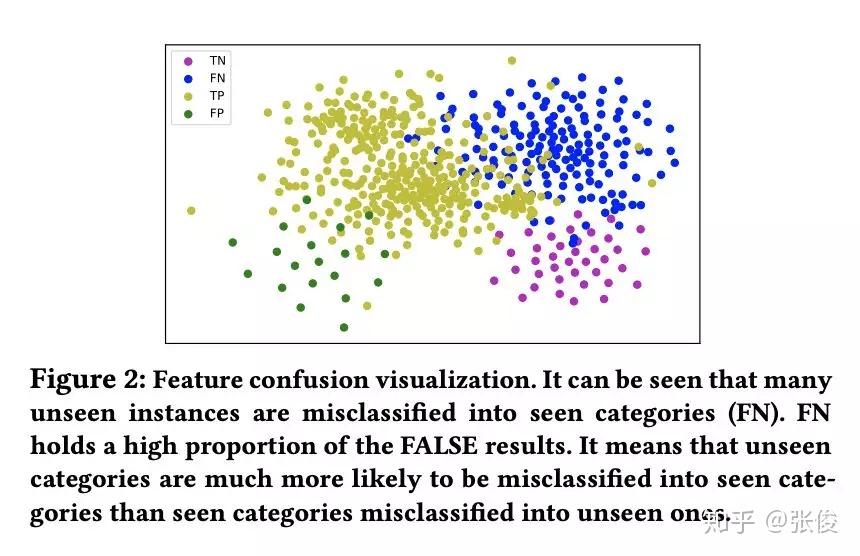

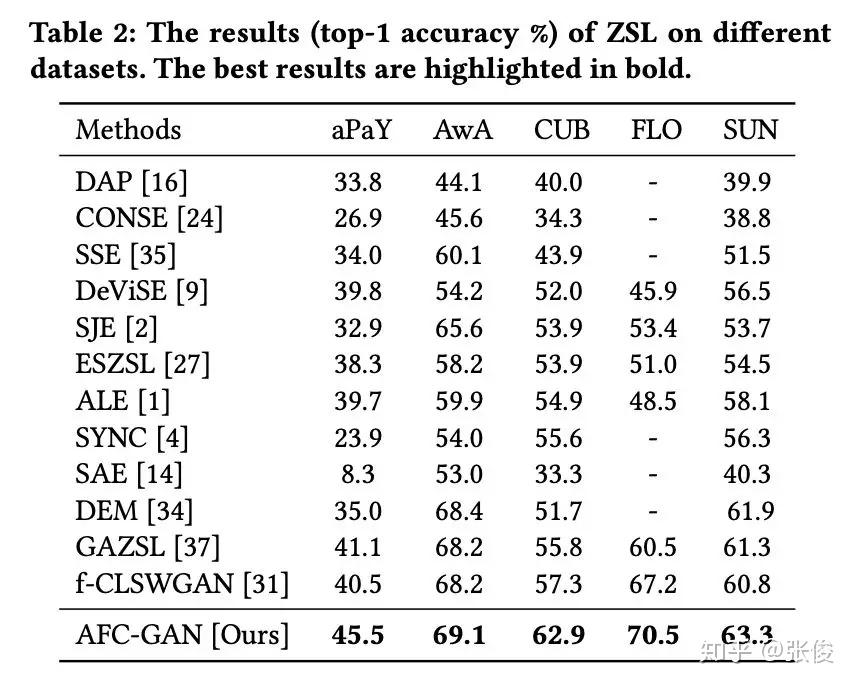

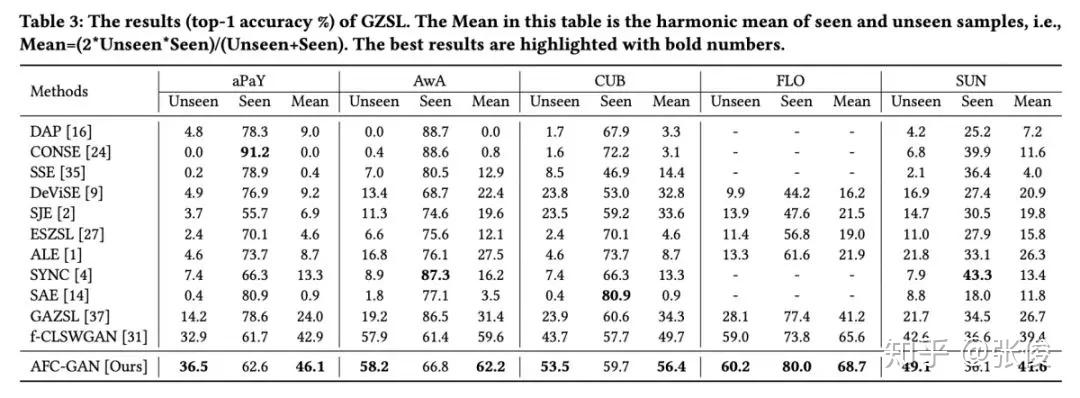

#Zero-shot Learning本文是电子科技大学和昆士兰大学发表于 ACM MM 2019 的工作。论文首次提出了生成式零样本学习中的特征混淆(feature confusion)问题,并提出了一种简单可行的解决特征混淆的方法。此外,作者还首次提出了一个特征混淆的度量指标。零样本学习结果在公开数据集上达到目前 SOTA 水平。

论文链接:https://www.paperweekly.site/papers/3210

源码链接:https://github.com/lijin118/AFC-GAN

@jhy1993 推荐

#Text Classification

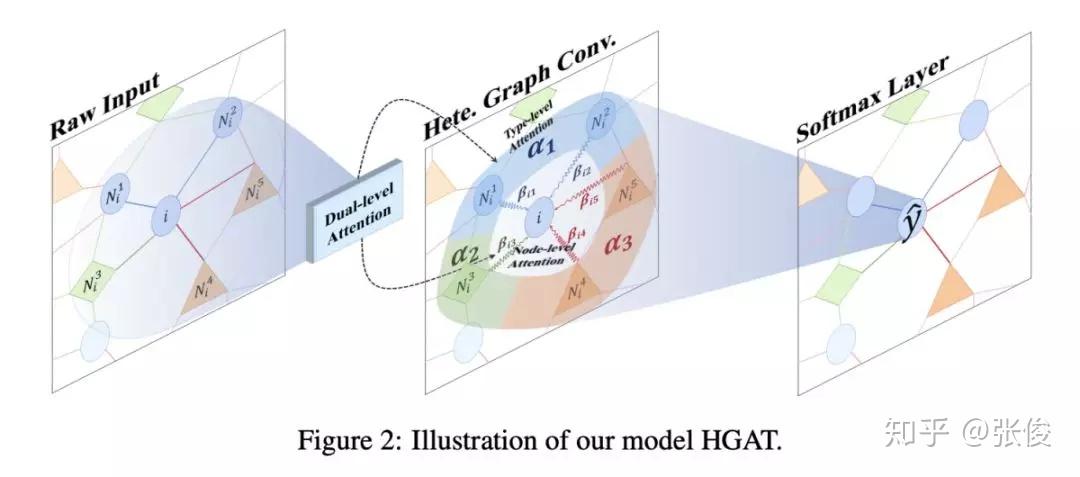

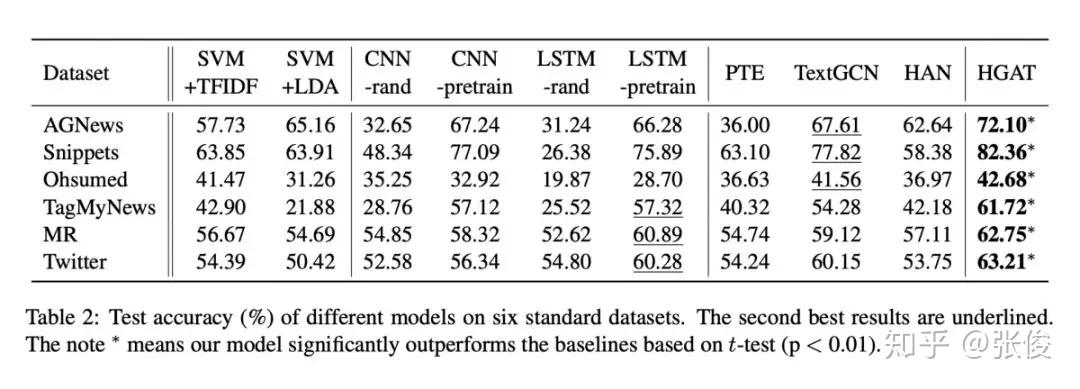

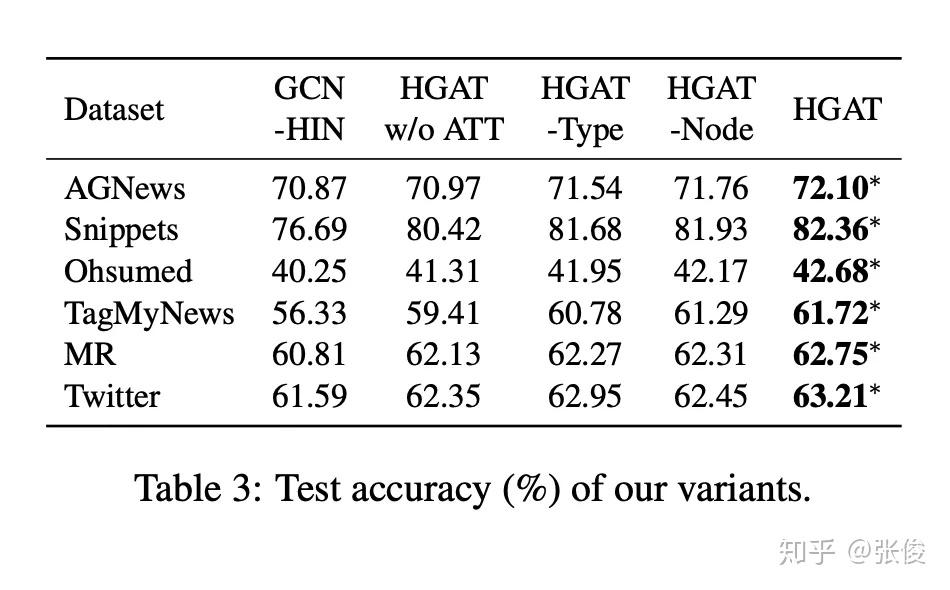

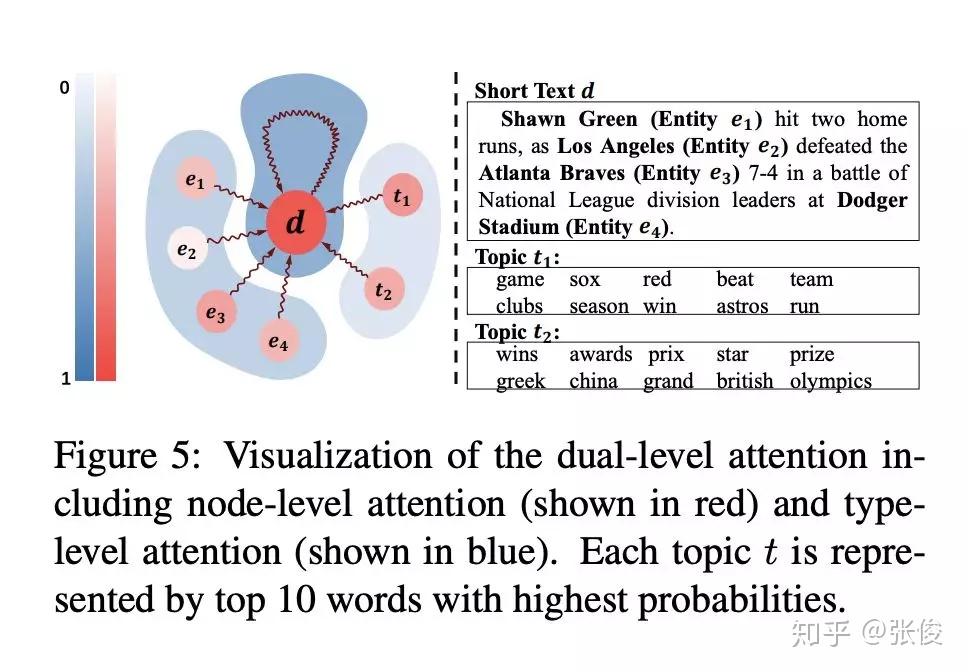

本文是北京邮电大学和南洋理工发表于 EMNLP 2019 的工作,文章创新性地将短文本分类问题建模为异质图(多种类型的节点和边)并提出一种端到端的异质图神经网络。短文本分类往往会遇到稀疏性问题(文本过短,无法提供足够的信息)。本文通过构图可以可以的丰富短文本之间的联系,进而较好的解决稀疏性问题。

另外,本文创新地提出一种异质图神经网络 HGAT。HGAT 分别从节点级别和类型级别聚合信息来更新节点表示。最后本文在 6 个数据集上做了大量的实验来验证 HGAT 的优越性。

论文链接:https://www.paperweekly.site/papers/3211

@yuyu2223 推荐

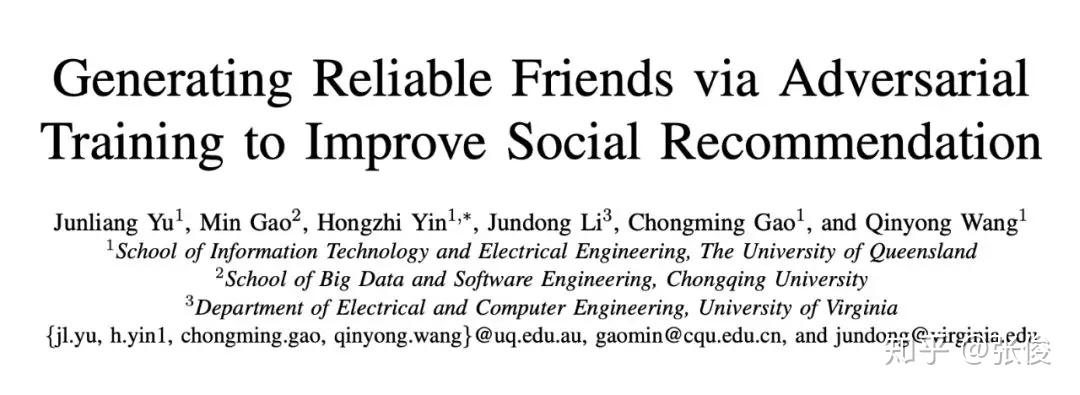

#Social Recommendation

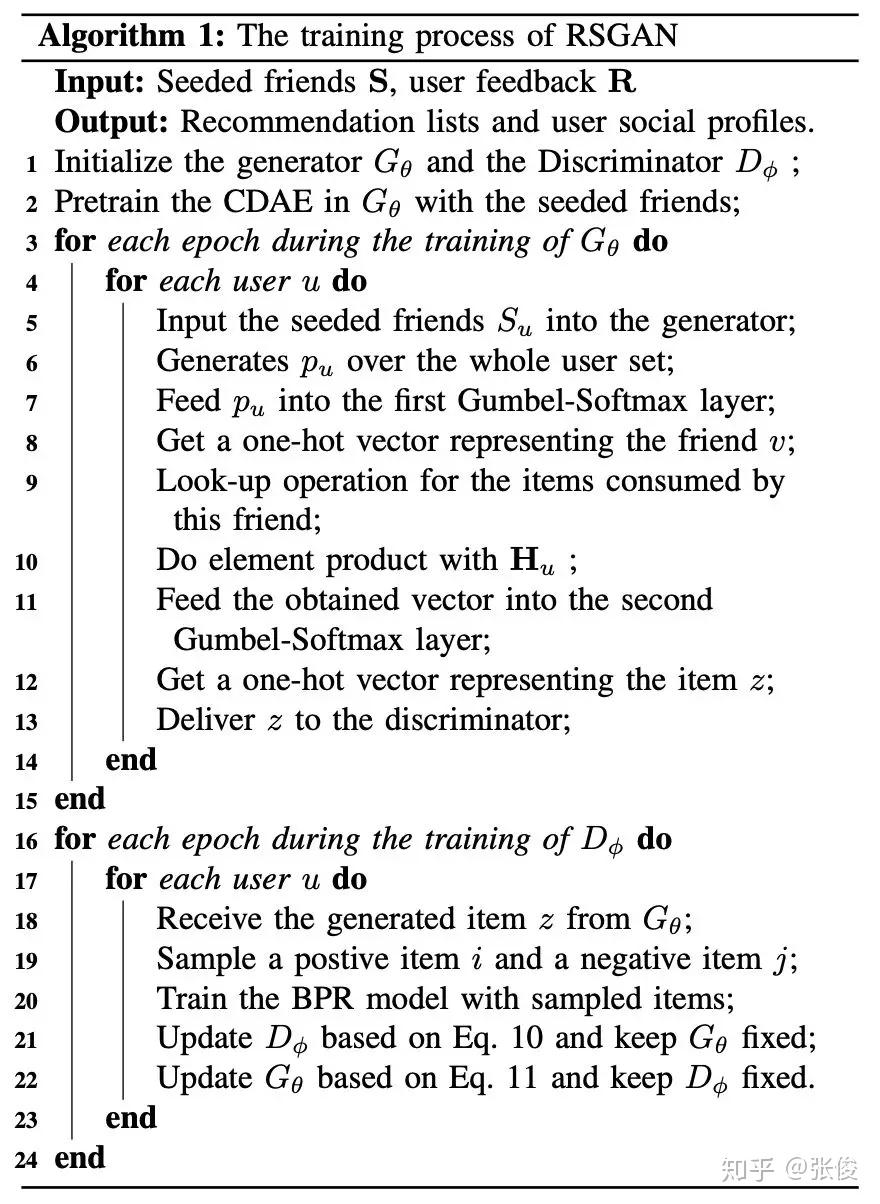

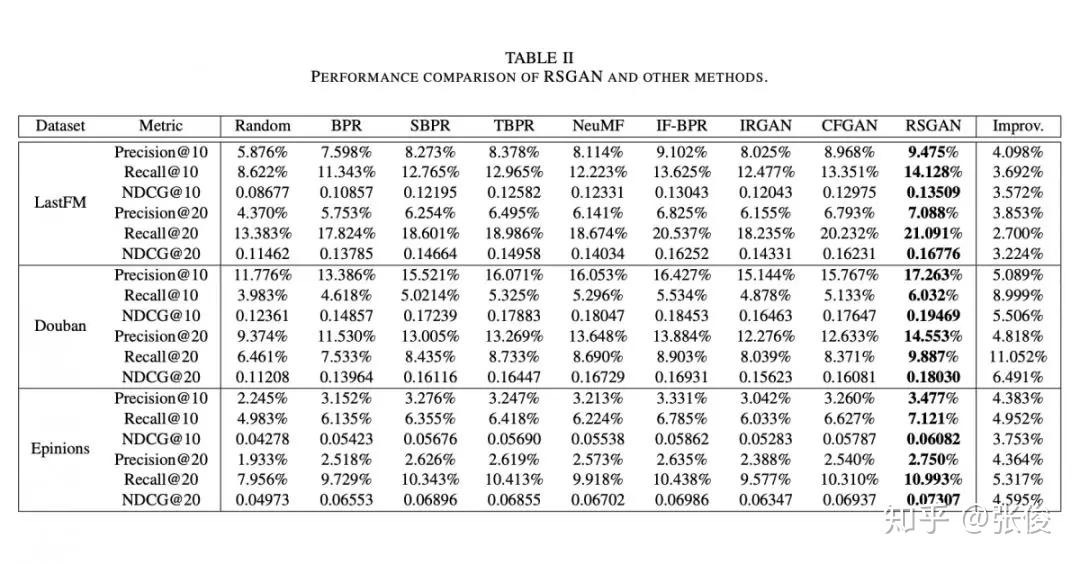

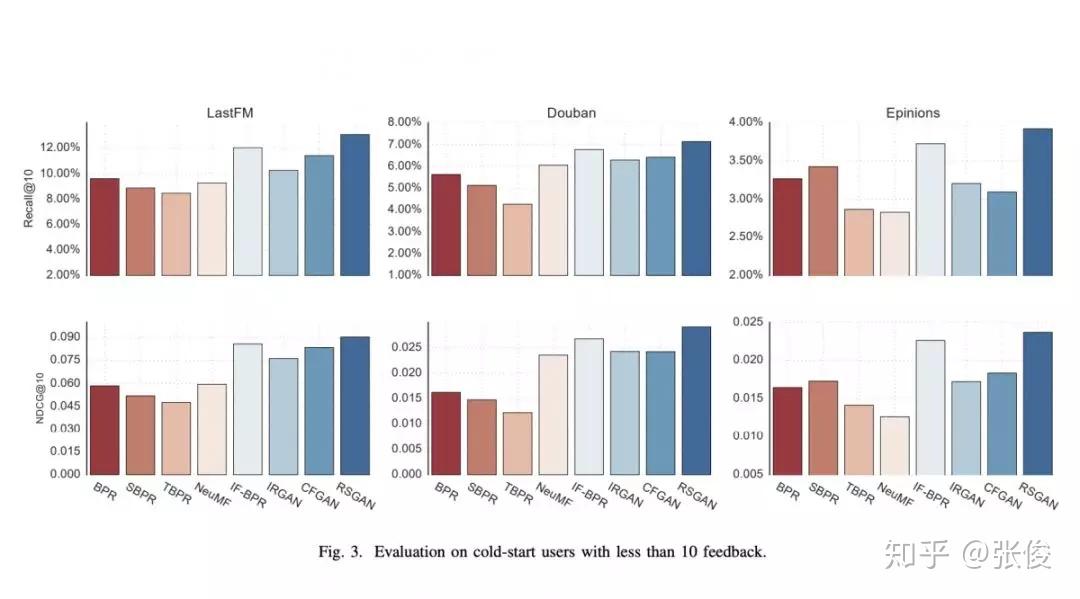

本文为发表在 ICDM 2019 的工作。论文提出了一种基于生成对抗训练框架的 social recommendation 模型,指出了现有社会化推荐模型中的关系缺失、噪声问题,并利用对抗训练改善了这些问题,提高了社会化推荐的效果。此外,以往基于 Policy Gradient 的离散 GAN 在训练时存在 reward 函数设计困难,收敛难等问题,本文利用重参数技巧,对模型进行了 End-to-End 的训练,绕开了 reward 函数,取得了很好的效果。

论文链接:https://www.paperweekly.site/papers/3201

源码链接:http://github.com/Coder-Yu/RecQ

@icaruss 推荐

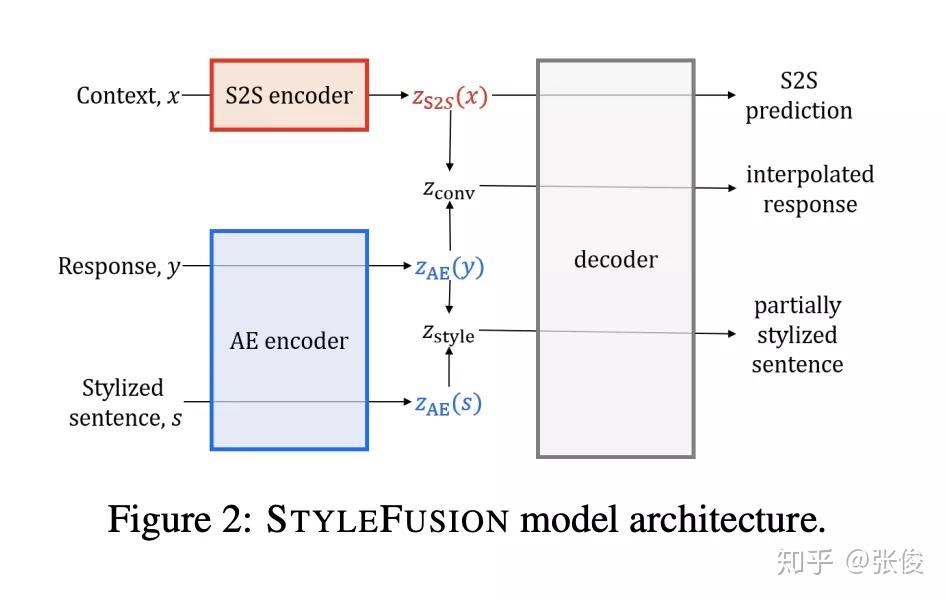

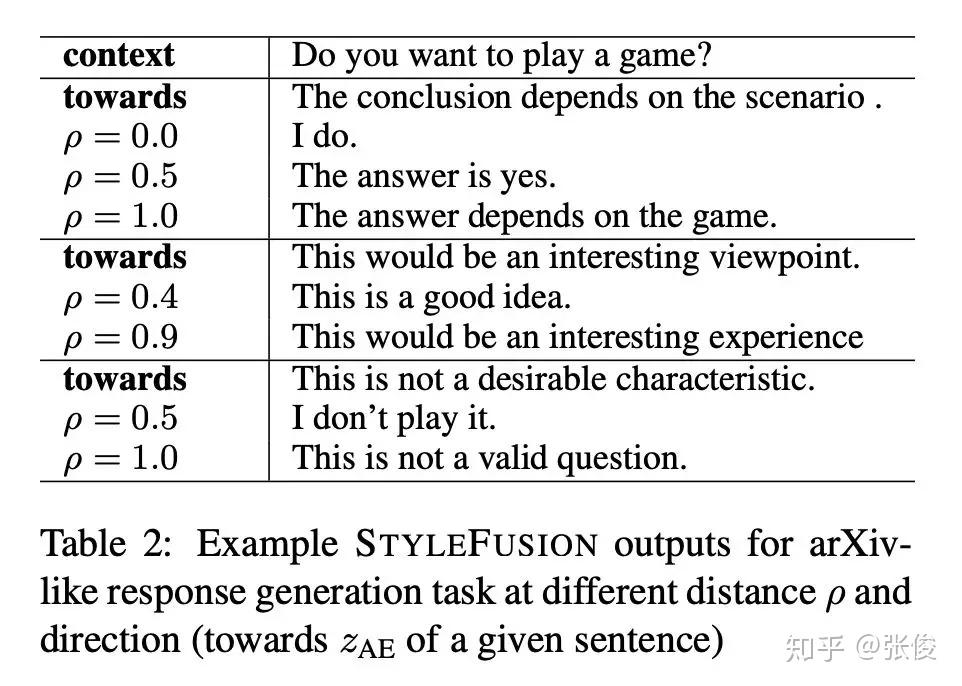

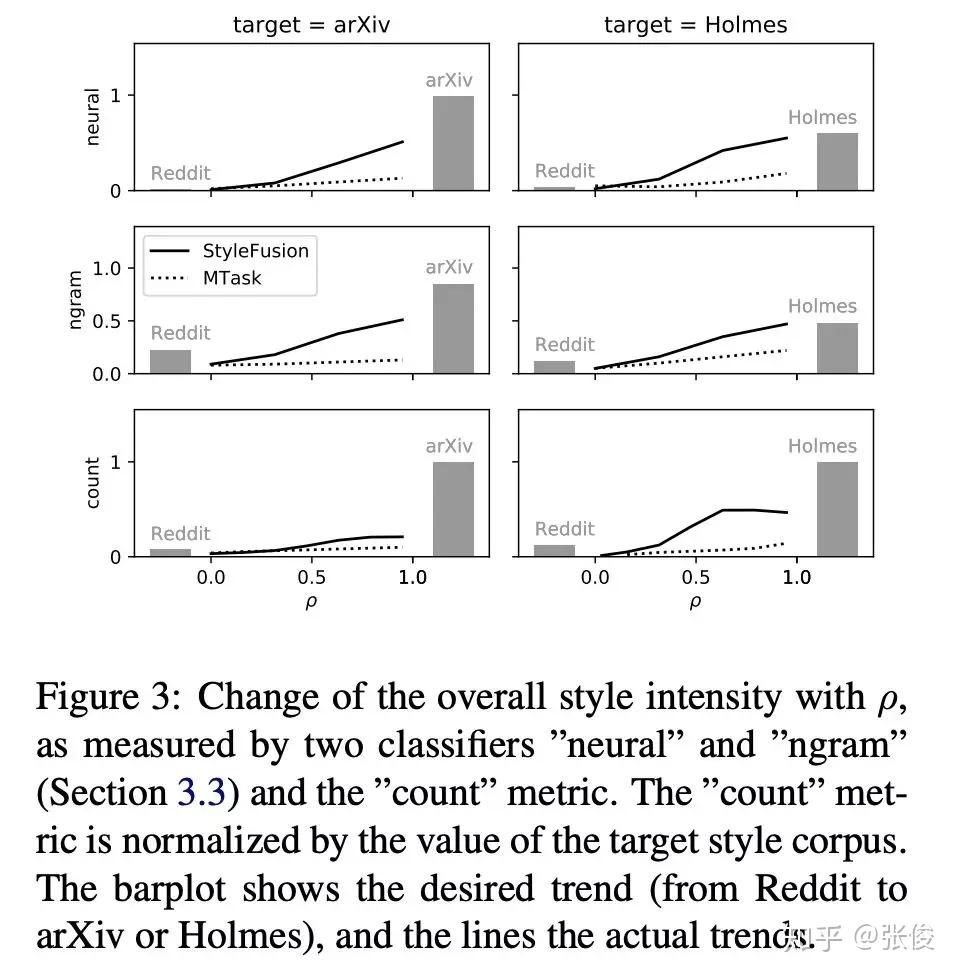

#Response Generation

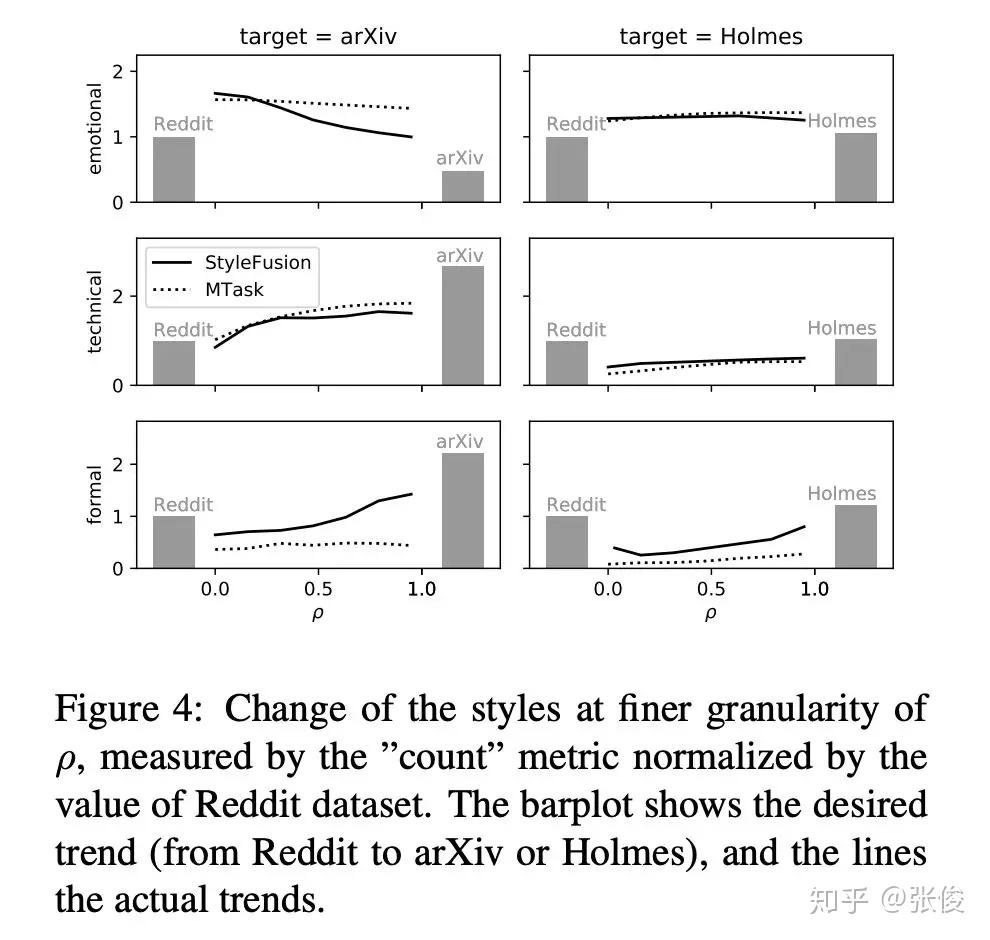

本文是微软发表于 EMNLP 2019 的工作,这是 SpaceFusion (Jointly optimizing diversity and relevance in neural response generation, NAACL 2019) 的后续之作。SpaceFusion 尝试将对话系统中的 source 和 target 映射到同一隐空间上,从而转换生成对话的问题成为生成隐空间向量的问题。本文(StyleFusion)进一步将额外的风格化文本的特征迁移到生成回复中,从而达到对话个性化和风格化的效果。在若干标准数据集上取得了很好的效果。

论文链接:https://www.paperweekly.site/papers/3206

源码链接:https://github.com/golsun/StyleFusion

@刘佳玮 推荐

#Graph Neural Networks

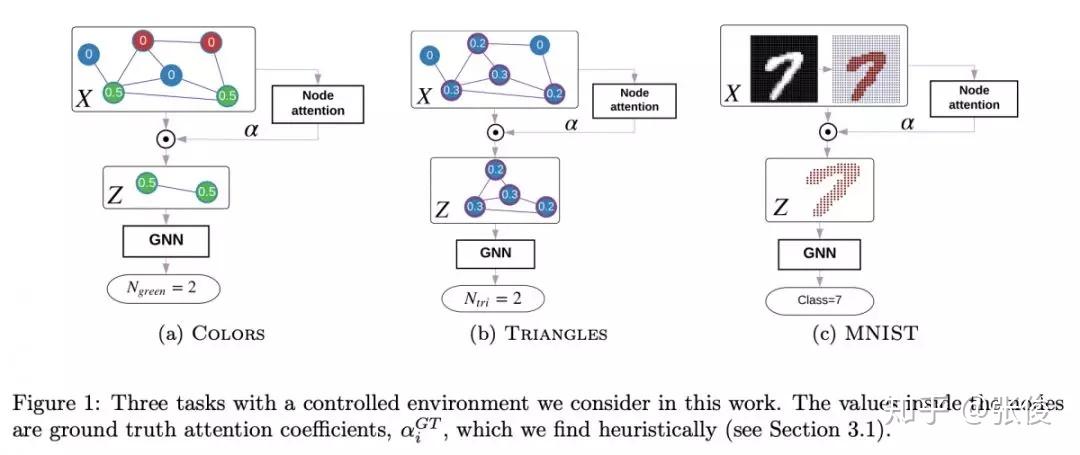

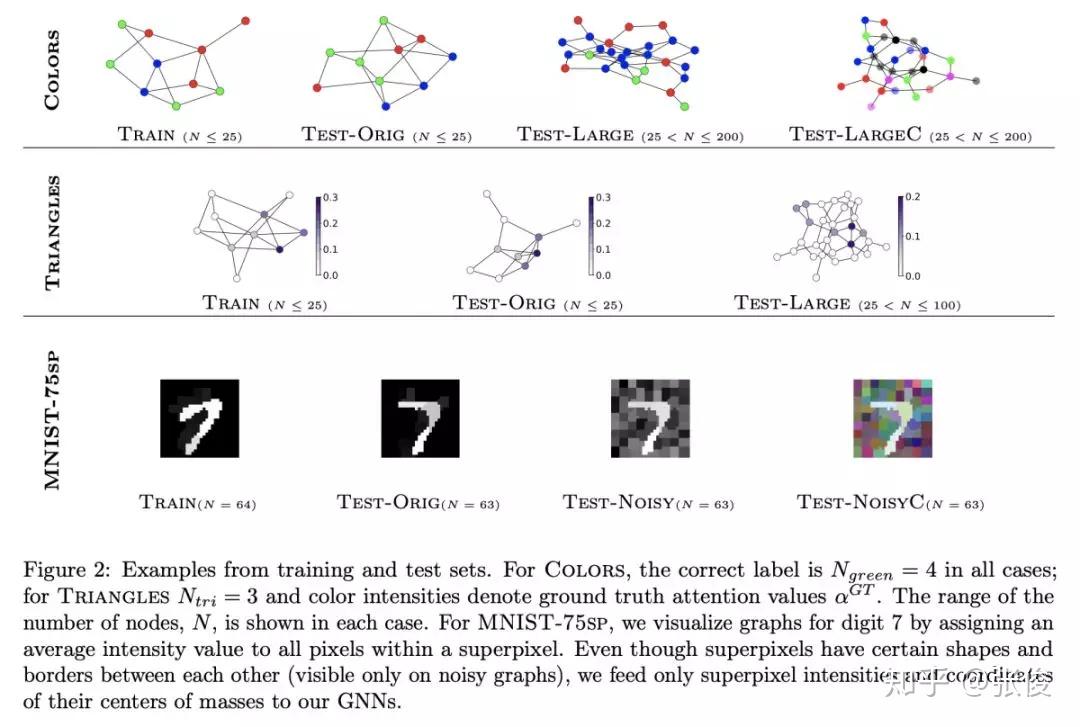

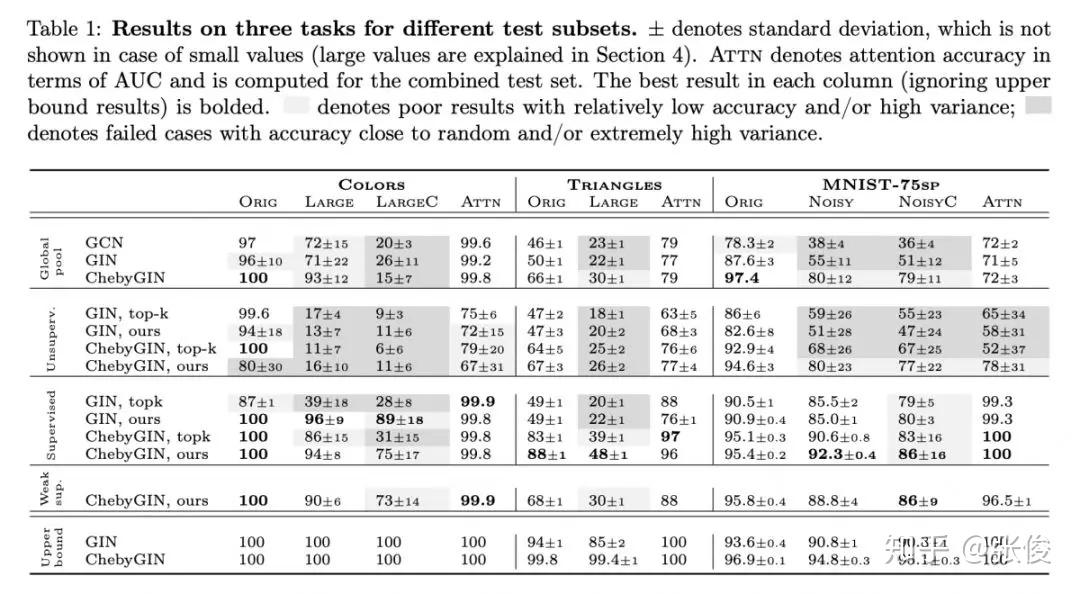

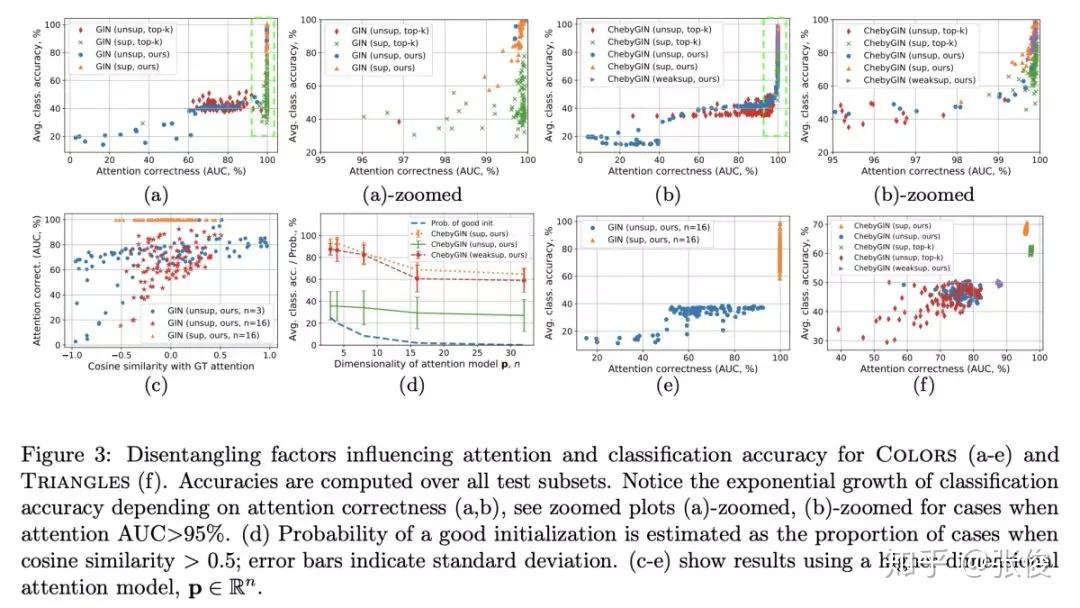

本文是圭尔夫大学发表于 NeurIPS 2019 的工作。本文的目标是更好地理解图神经网络(GNN)中节点的注意力,并确定影响其有效性的因素。本文特别关注将注意力 GNN 泛化到更大,更复杂或更嘈杂的图的能力。受图同构网络工作的启发,本文设计了简单的图推理任务,使本文能够在受控环境中研究注意力机制。本文发现在典型条件下,注意力的影响可以忽略甚至是有害的,但在某些条件下,它在一些分类任务中提供超过 60% 的特殊性能提升。在实践中满足这些条件是具有挑战性的,并且通常需要对注意力机制进行监督训练。本文提出了一种替代方法,并以弱监督的方式训练注意力,以接近监督模型的性能,并且与无监督模型相比,改进了几个合成数据集和真实数据集的结果。

论文链接:https://www.paperweekly.site/papers/3220

源码链接:https://github.com/bknyaz/graph_attention_pool

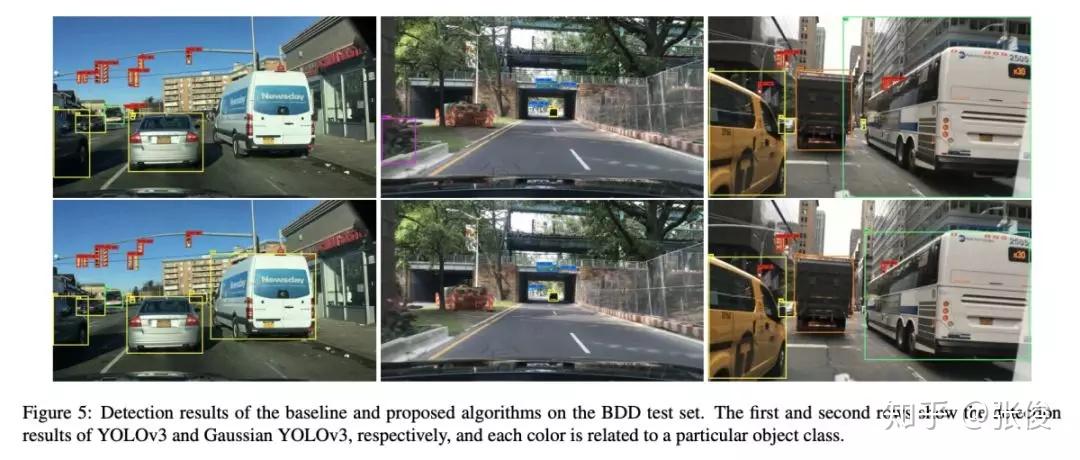

@muxin 推荐

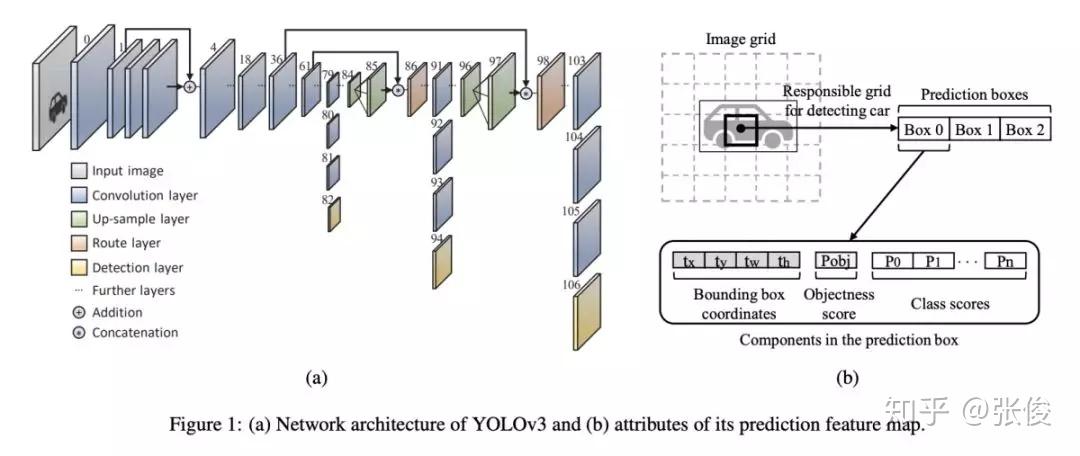

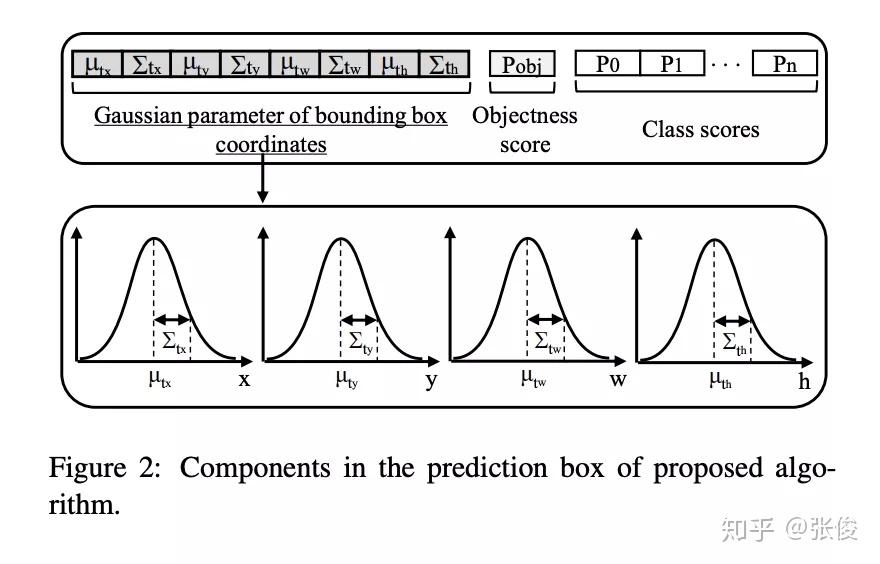

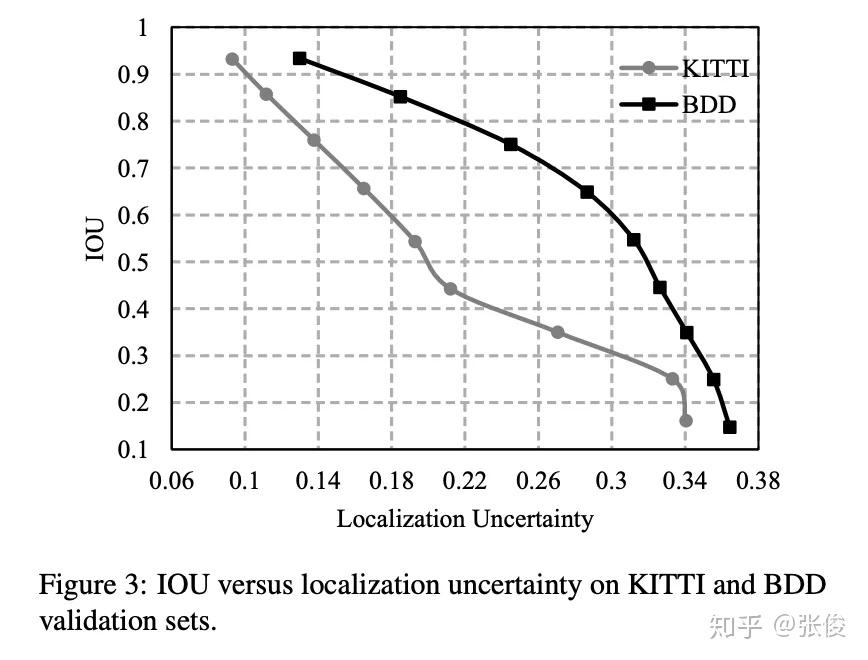

#Object Detection

本文是首尔大学和首尔科技大学发表于 ICCV 2019 的工作。作者提出了一种改进的 YOLOv3 模型,对于我们改进模型有很好的启示作用。文章清晰明了,便于理解。

论文链接:https://www.paperweekly.site/papers/3197

#投 稿 通 道#

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢? 答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学习心得或技术干货。我们的目的只有一个,让知识真正流动起来。

来稿标准:

• 稿件确系个人原创作品,来稿需注明作者个人信息(姓名+学校/工作单位+学历/职位+研究方向)

• 如果文章并非首发,请在投稿时提醒并附上所有已发布链接

• PaperWeekly 默认每篇文章都是首发,均会添加“原创”标志

投稿方式:

• 方法一:在PaperWeekly知乎专栏页面点击“投稿”,即可递交文章

• 方法二:发送邮件至:hr@paperweekly.site ,所有文章配图,请单独在附件中发送

• 请留下即时联系方式(微信或手机),以便我们在编辑发布时和作者沟通

关于PaperWeekly

PaperWeekly 是一个推荐、解读、讨论、报道人工智能前沿论文成果的学术平台。如果你研究或从事 AI 领域,欢迎在公众号后台点击「交流群」,小助手将把你带入 PaperWeekly 的交流群里。

加入社区:http://paperweek.ly

微信公众号:PaperWeekly

新浪微博:@PaperWeekly

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!