文章主题:1. jingyihiter 2. 推荐 3. 未知

@jingyihiter 推荐

#Neural Sequence Generation

论文链接:https://www.paperweekly.site/papers/2867

源码链接:https://github.com/ZNLP/sb-nmt

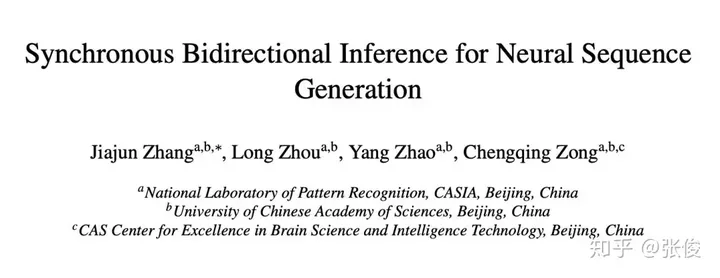

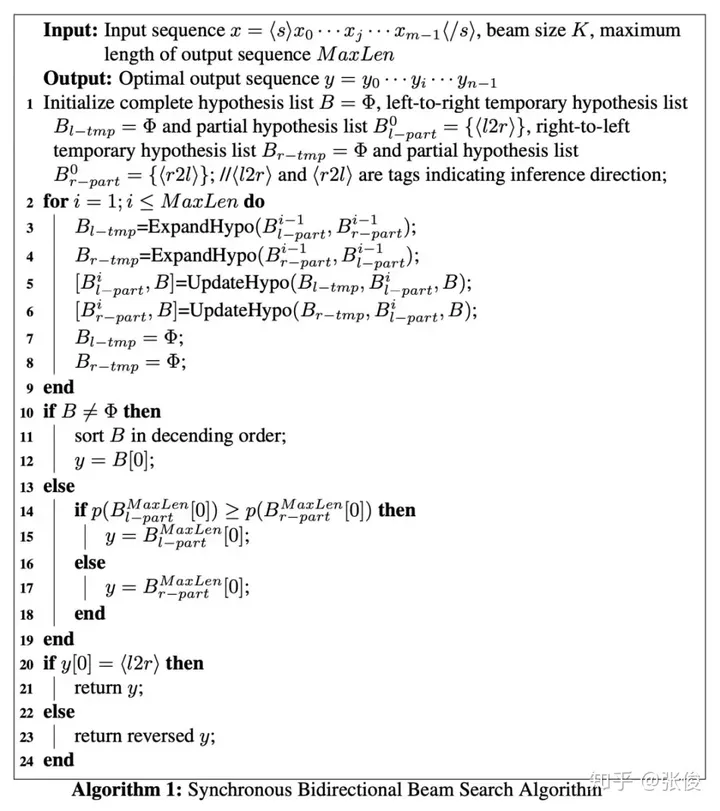

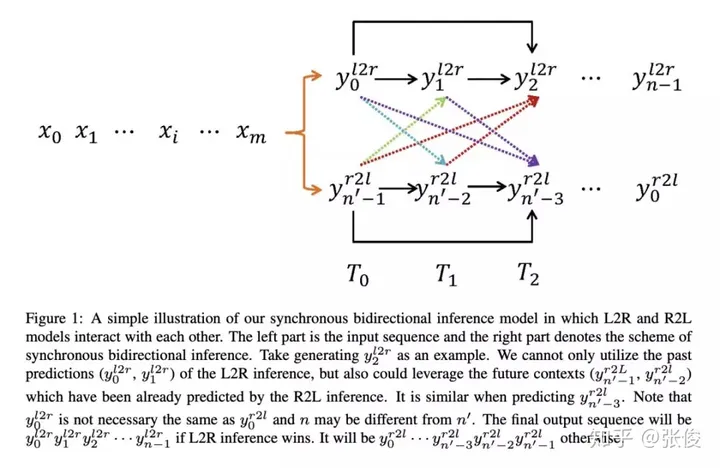

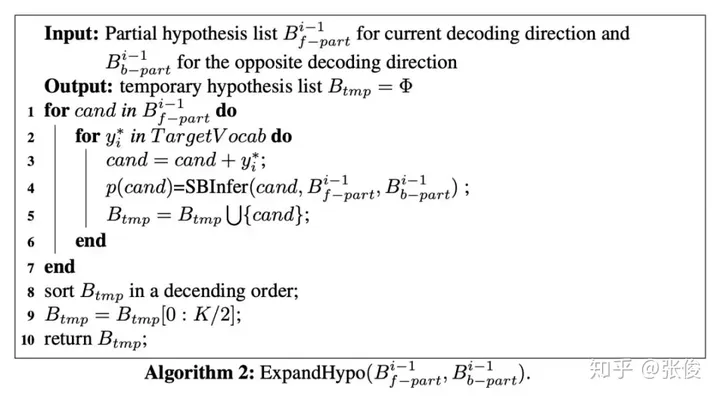

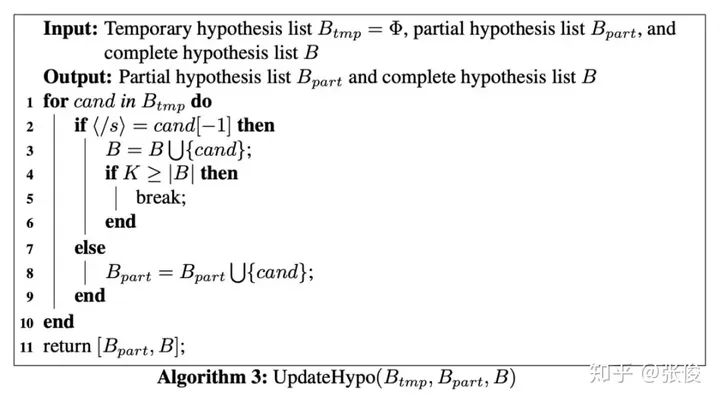

这篇文章是由自动化所的张家俊老师在2019年的TACL会议上发表的,主要探讨了在序列生成任务的解码过程中如何实现双向解码。为了解决这个问题,作者提出了一种新颖的beam search算法,并结合了改进版的transformer模型,也就是BIFT模型,这一方法在机器翻译和文本摘要任务中都展现出了显著的优势。文章中还提供了详尽的实验数据以及相应的开源实现代码。

@paperweekly 推荐

#Abstractive Summarization

论文链接:https://www.paperweekly.site/papers/2901

源码链接:https://github.com/ctr4si/MMN

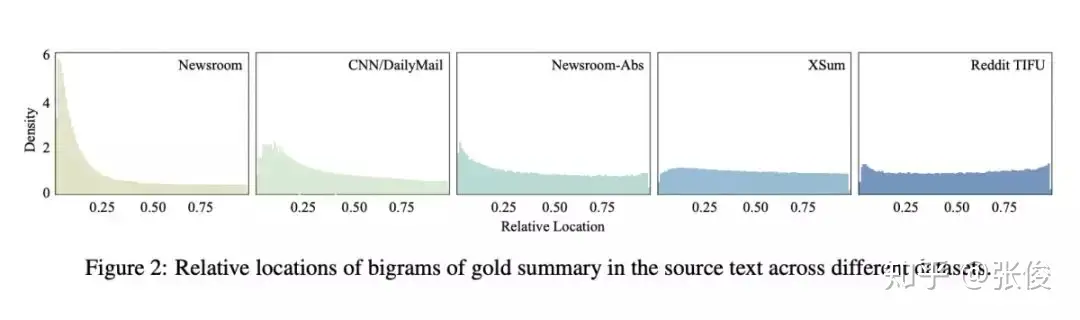

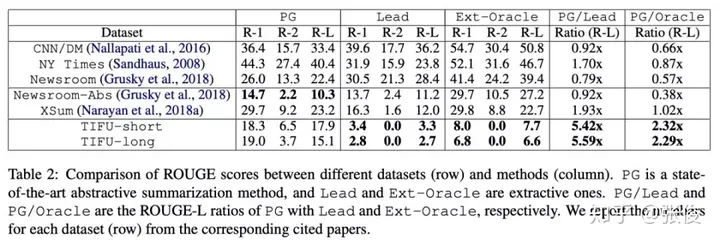

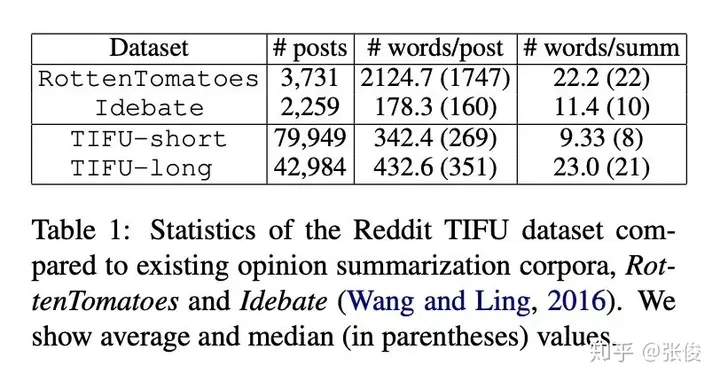

这篇文章源自于NAACL-HLT 2019会议,提出了一种名为多级存储网络(MMN)的生成式摘要模型。这种模型采用了多级卷积存储器来替代传统的基于循环神经网络(RNN)的编码器。通过运用卷积手段,MMN能够有效地控制多级句子、段落以及整篇文本中的信息表示程度。

这篇文章还分享了一个庞大的抽象摘要数据集——Reddit TIFU,该数据集包含了来自Reddit的120,000个帖子。通过基于AMT的定量评估和用户研究,我们的模型在Reddit TIFU以及新闻类生成式摘要数据集上,都展现出了超越目前最先进抽象概括方法的优势。

@stevewyl 推荐

#Natural Language Understanding

论文链接:https://www.paperweekly.site/papers/2809

源码链接:https://github.com/namisan/mt-dnn

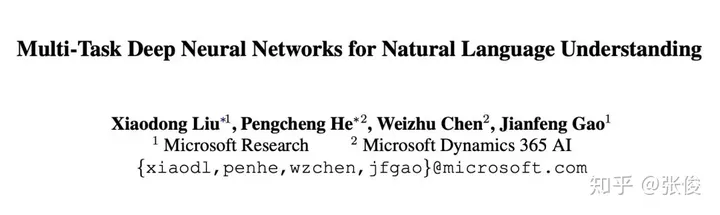

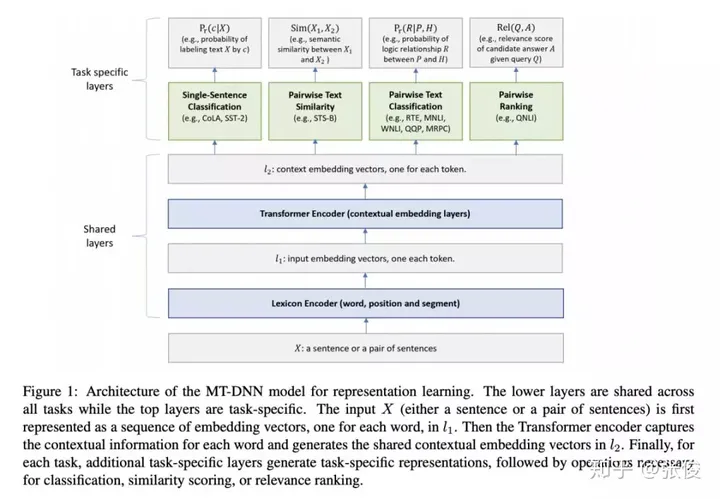

这篇文章由微软的研究团队撰写,主要探讨了如何将多任务学习(MTL)和语言模型相结合,从而在自然语言理解(NLU)领域提升GLUE测试的性能。该研究采用了一种基于多任务学习框架和特征共享层硬连接的方法,取代了原有的MT-DNN模型中的特征表示层,选择了当前非常流行的BERT模型。然而,与BERT模型的不同之处在于,它在多个任务上进行了微调。

这篇文章是对基于BERT的模型进行的一次成功尝试,其后续研究方向可以关注任务间的关联性。BERT与MTL的融合或将成为未来研究的重点。然而,该研究尚存在不足,如缺乏显著的创新,以及MTL使用的便捷性有待提高,从而进一步提升其性能。

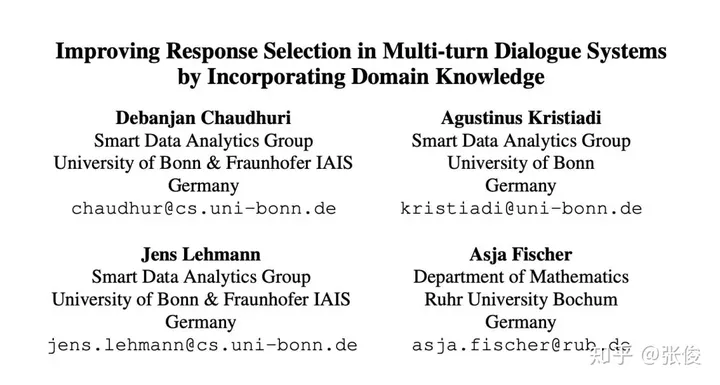

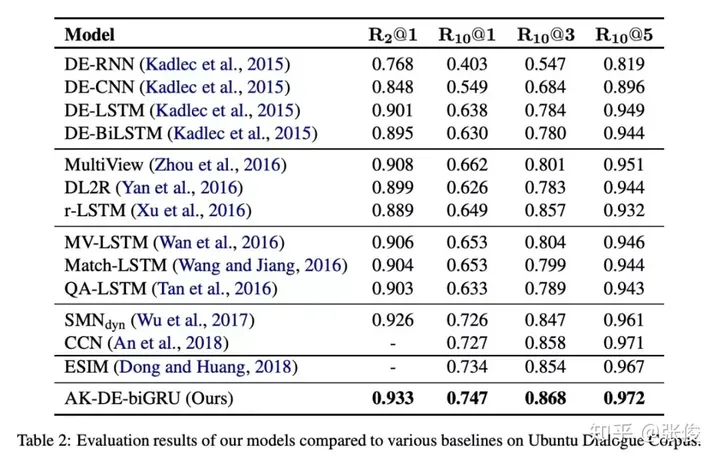

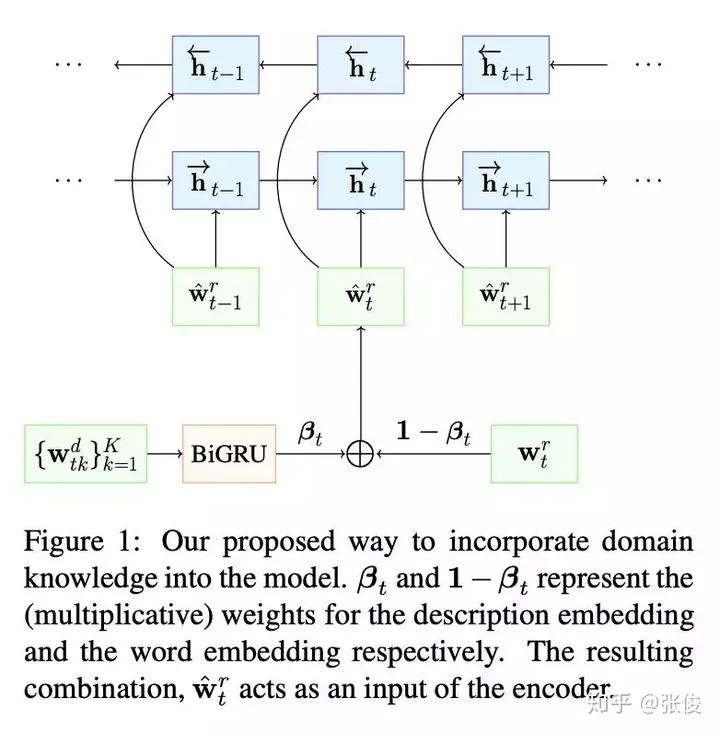

@Hutommy 推荐

#Dialogue Systems

论文链接:https://www.paperweekly.site/papers/2838

源码链接:https://github.com/SmartDataAnalytics/AK-DE-biGRU

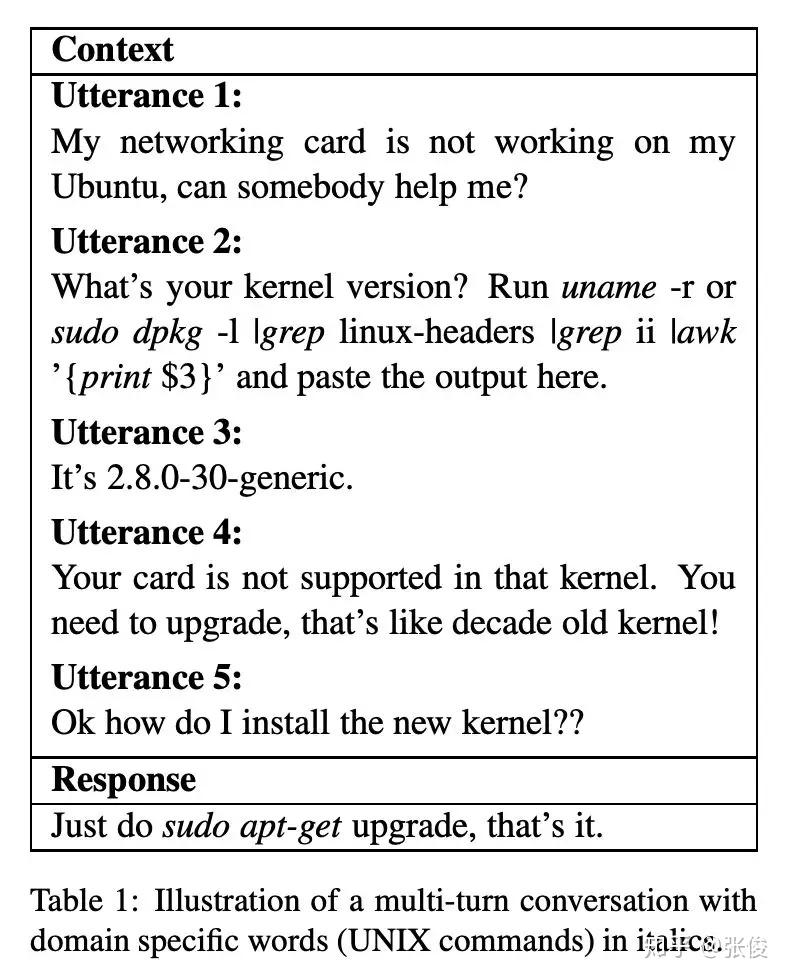

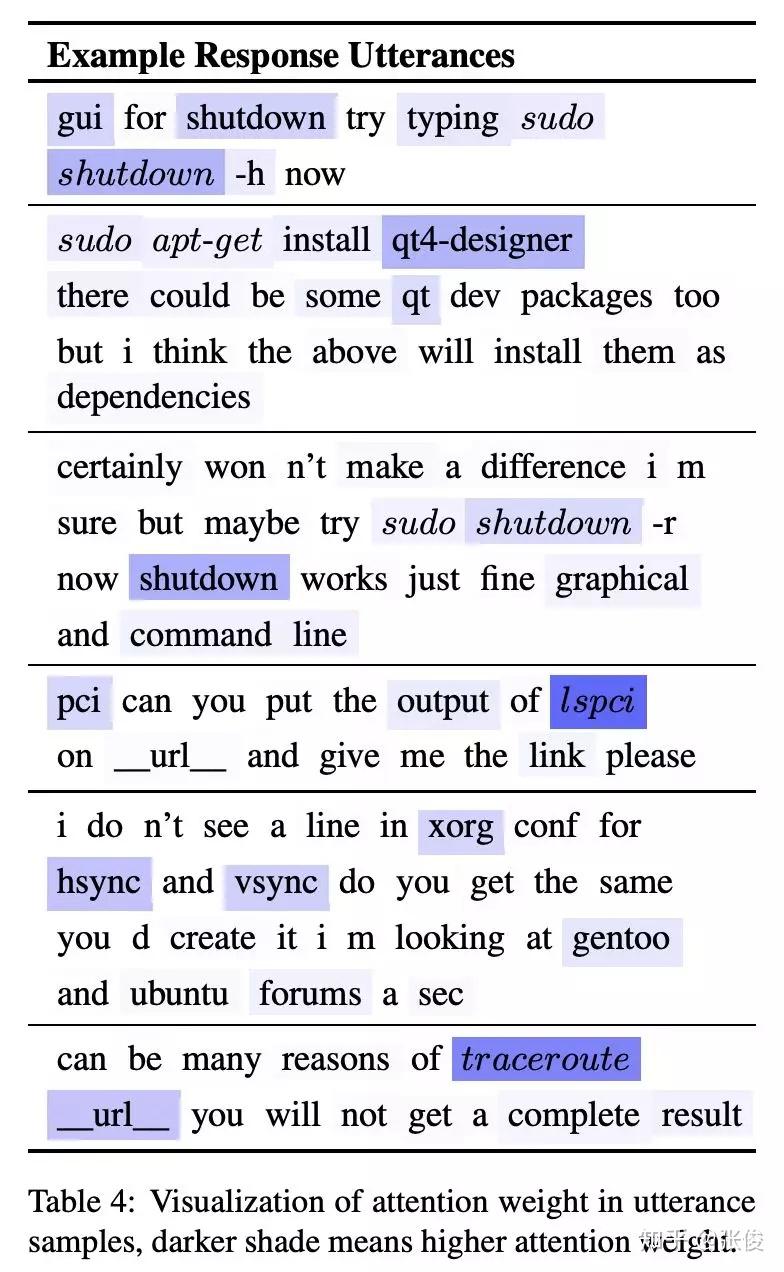

这篇文章是由波恩大学和波鸿鲁尔大学在CoNLL 2018会议上发表的,主要探讨了对话系统的分类问题。文章深入浅出地阐述了RNN、BiRNN以及GRU等核心概念,并在此基础上引入了一种外部知识增强机制,旨在提升处理低频词汇的能力。此外,该研究还结合了领域特定的关键词描述编码,从而在多轮对话中发挥了重要作用。

@chunhualiu 推荐

#Story Ending Generation

论文链接:https://www.paperweekly.site/papers/2775

源码链接:https://github.com/JianGuanTHU/StoryEndGen

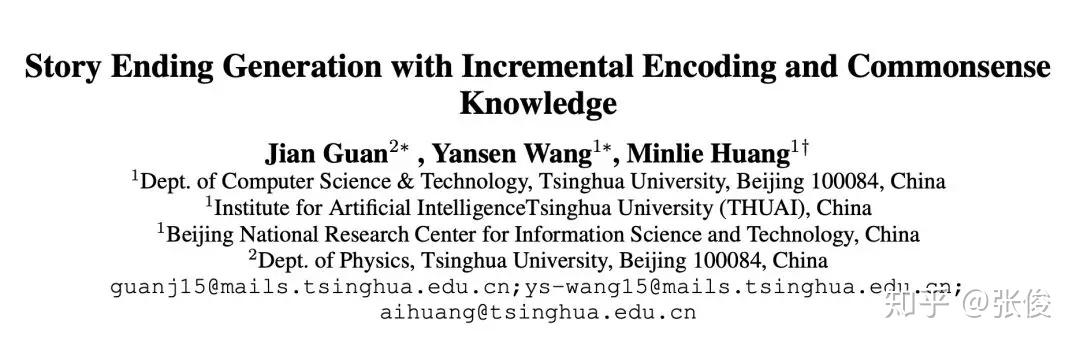

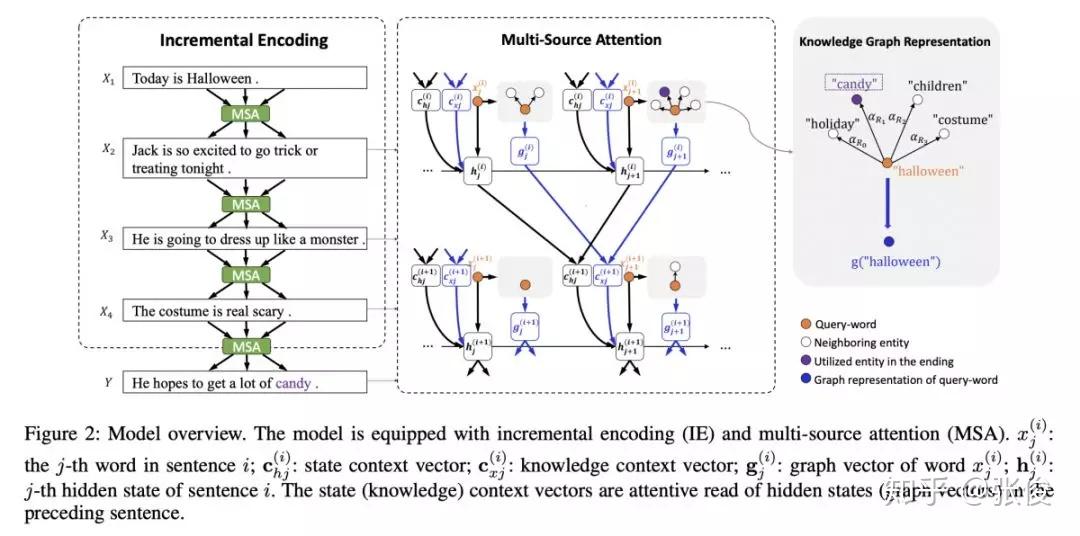

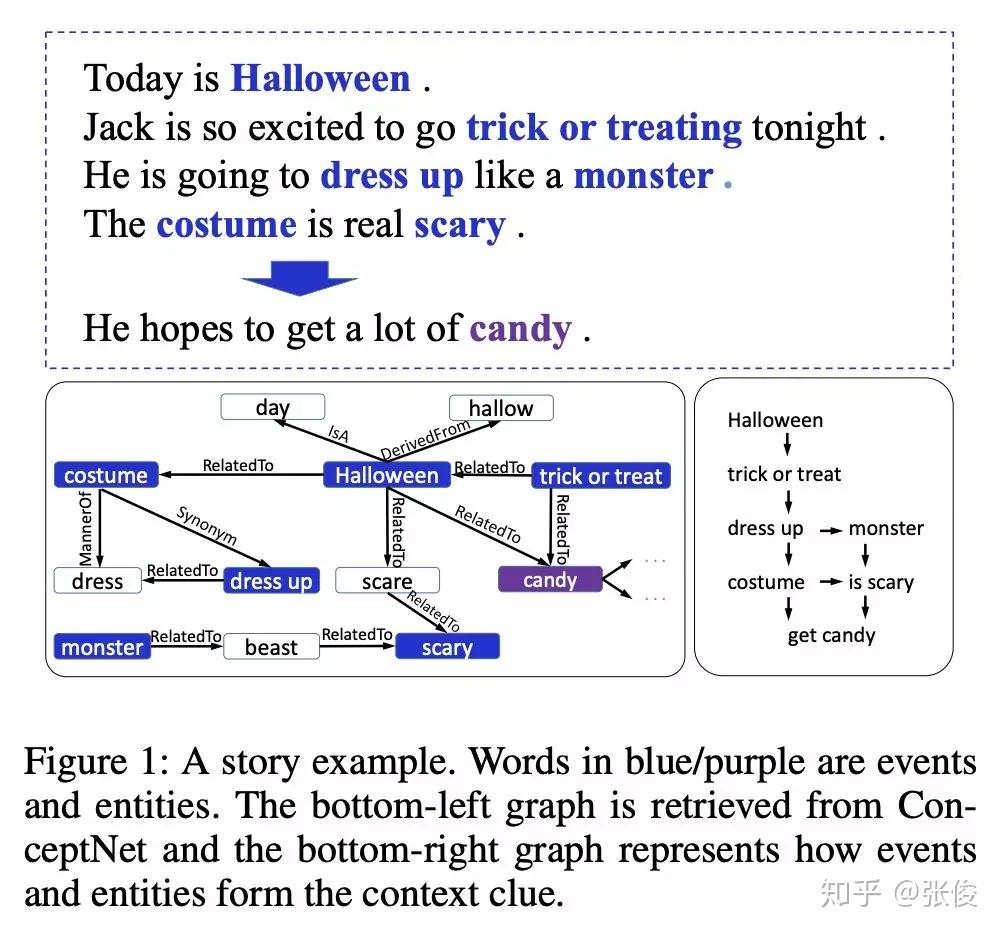

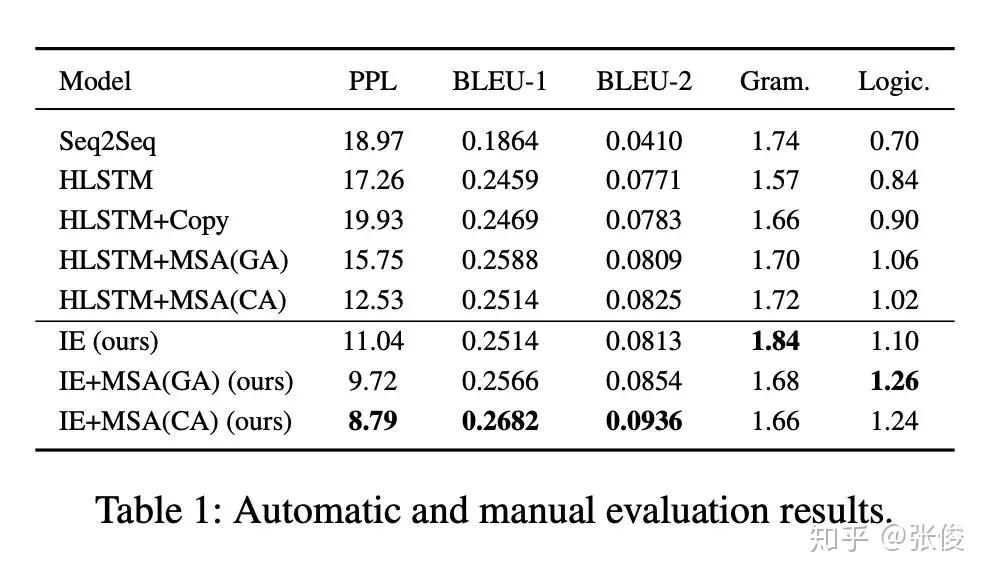

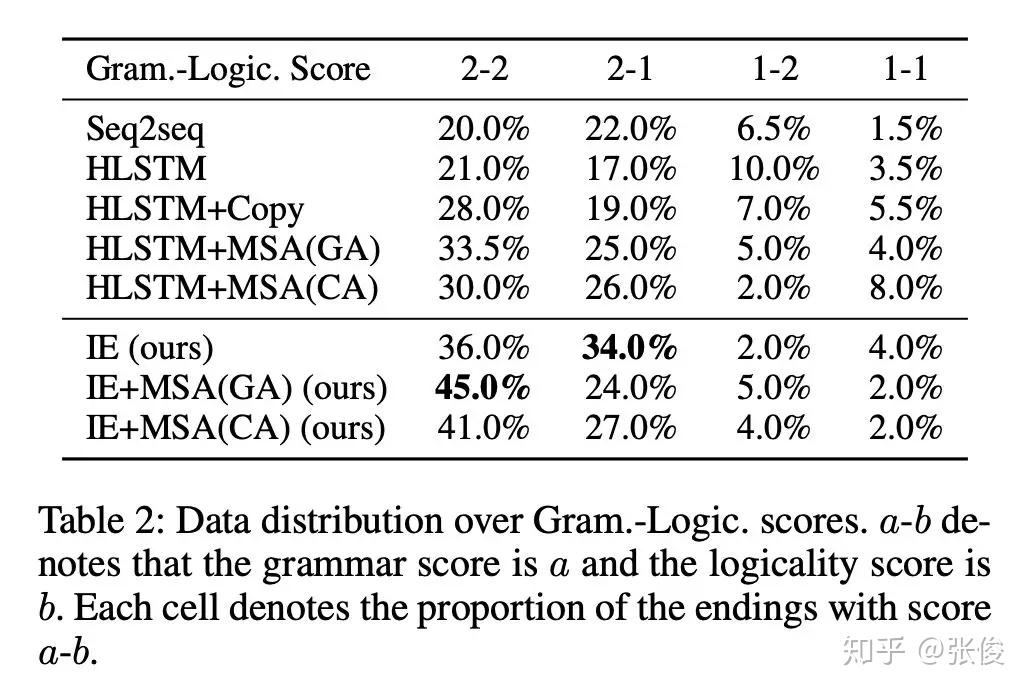

本文是清华大学黄民烈老师组发表于 AAAI 2019 的工作,论文提供了一种如何利用常识知识做故事结尾生成的新思路。作者提出利用增量编码的方式来对 RocStories 数据集中的 context 进行编码,并且将从 ConceptNet 中检索得到的知识进行编码,利用 multi-source attention 的方式融合到 context 的编码过程中。

@paperweekly 推荐

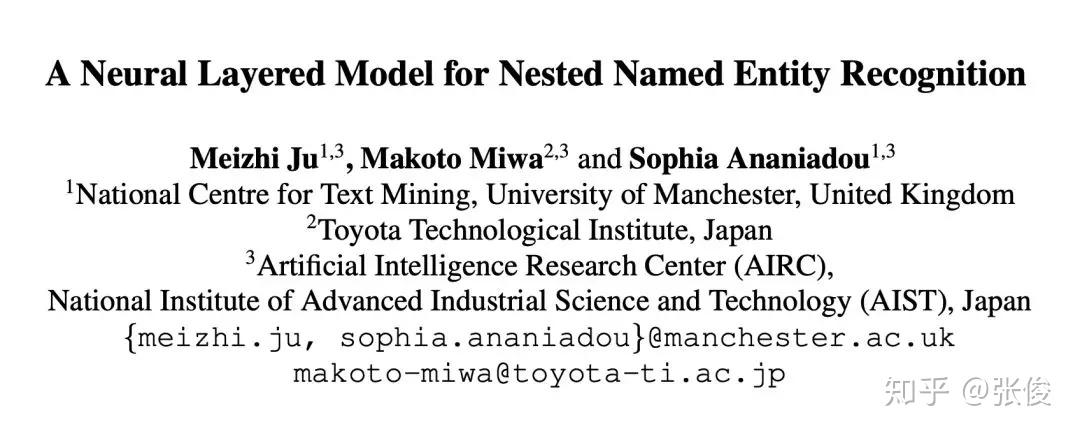

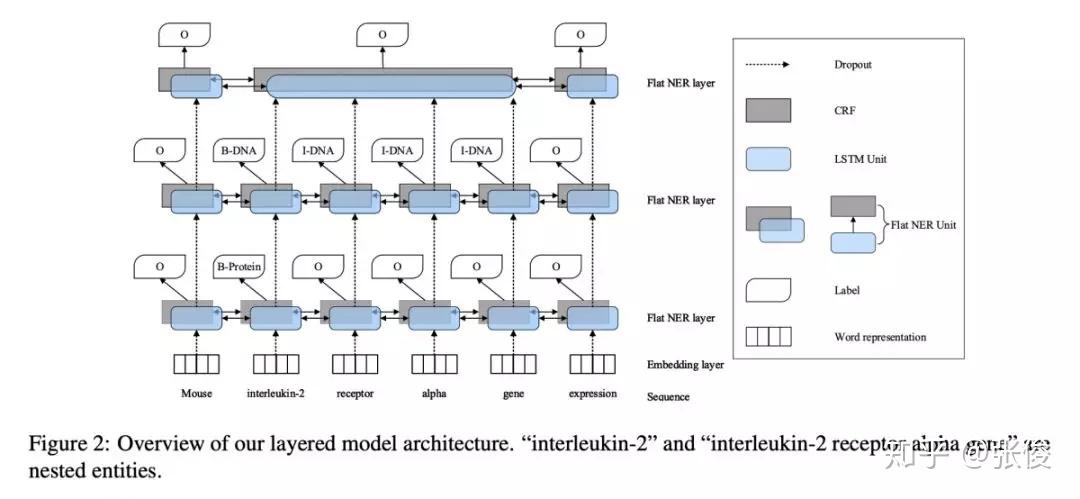

#Named Entity Recognition

论文链接:https://www.paperweekly.site/papers/2696

源码链接:https://github.com/meizhiju/layered-bilstm-crf

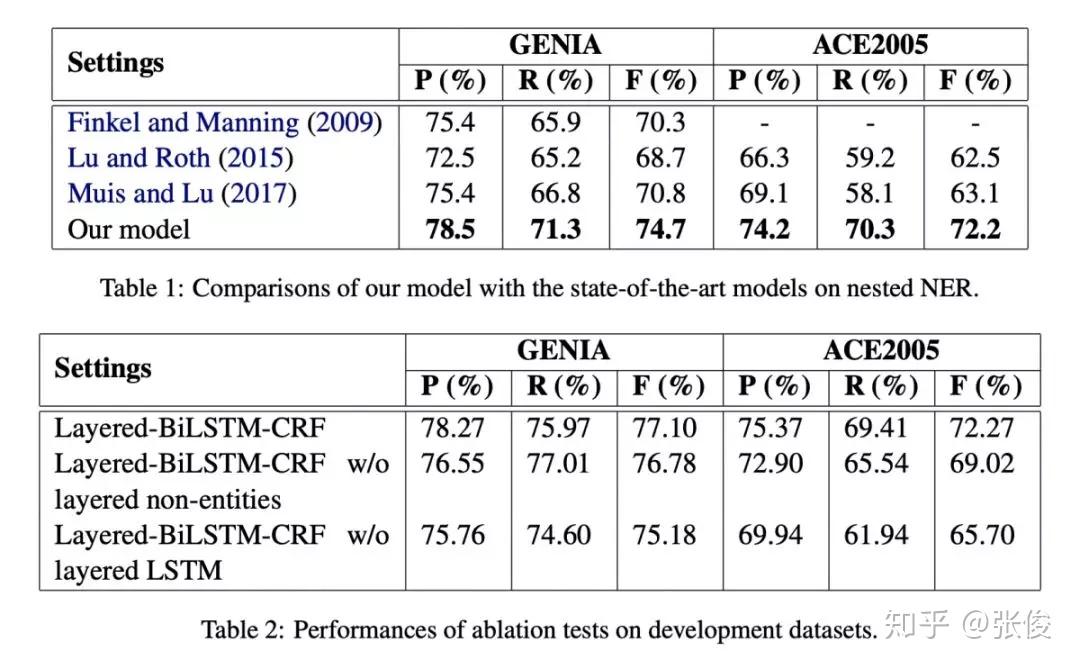

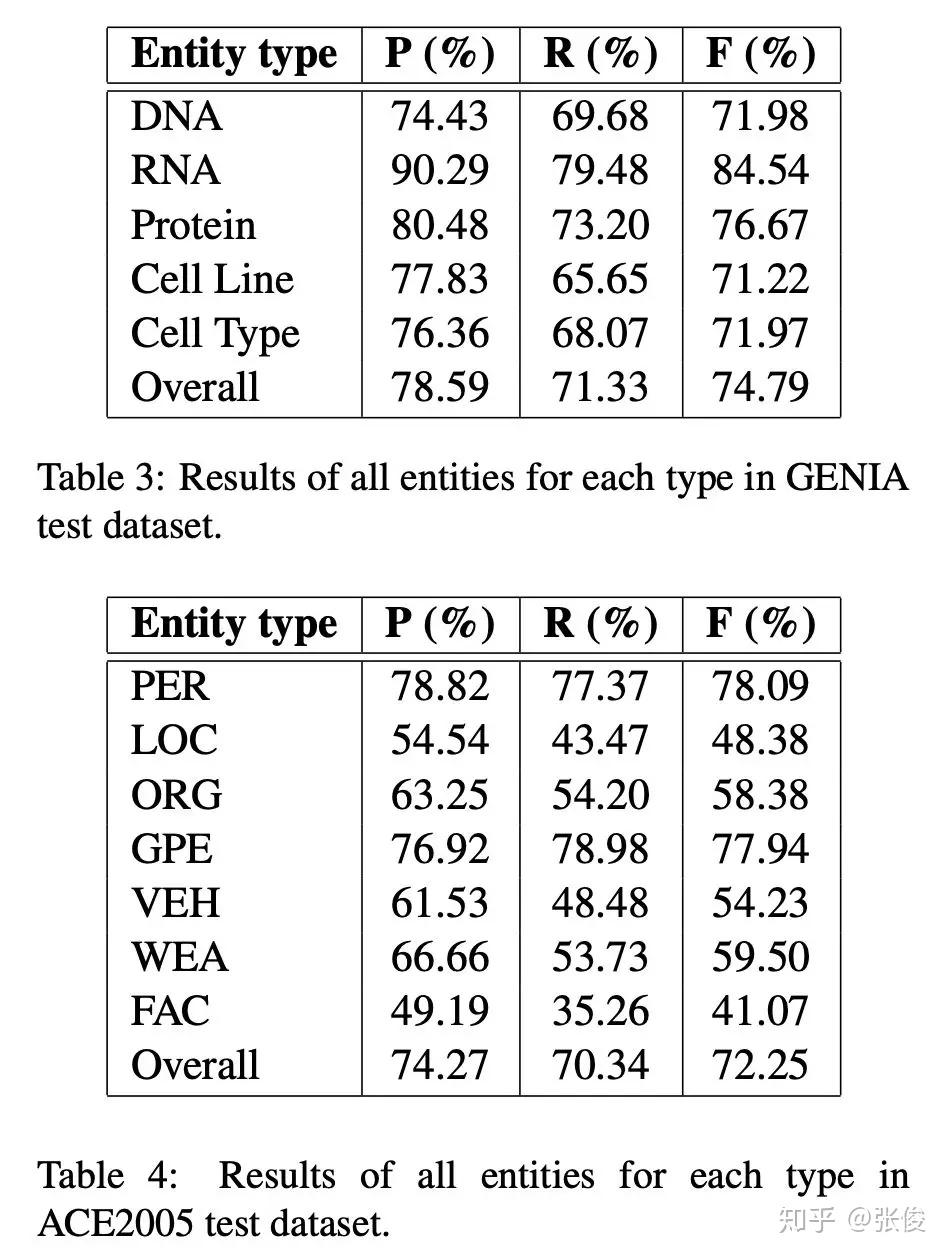

本文是曼彻斯特大学和丰田工业大学发表于 NAACL 2018 的工作,论文提出了一种由 flat NER layers 动态连续堆叠而成的神经网络模型,每个 flat NER layer 含有一个 BiLSTM 和 CRF 分别进行输入编码和标签预测,整体模型为 Layered-BiLSTM-CRF。

当前 flat layer 将已被识别为实体的 token 经过 LSTM 处理的新表示合并起来,传递给下一个 flat layer,从而使得模型能以从内到外的方式,充分利用内部实体编码信息识别出外部实体,直到没有更外部的实体被识别出来。

@xiaolu 推荐

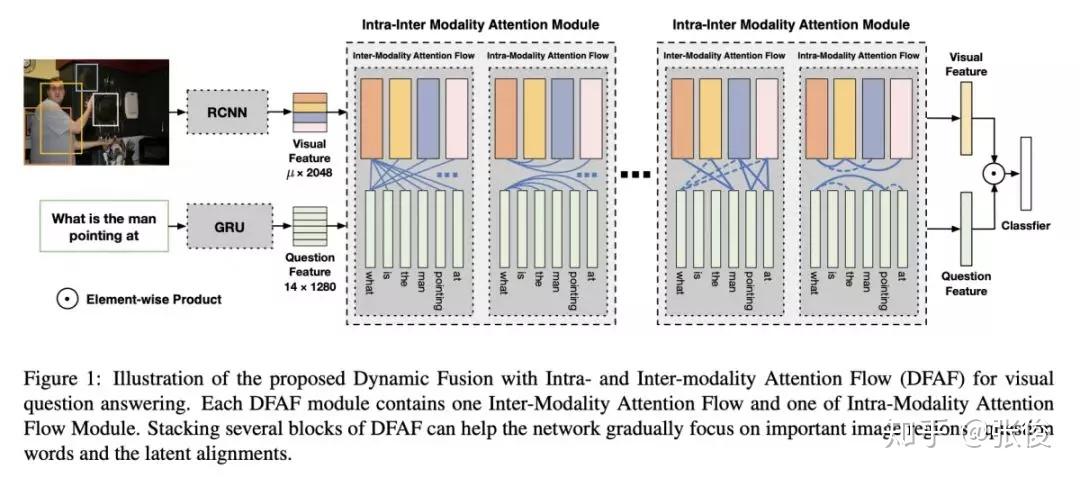

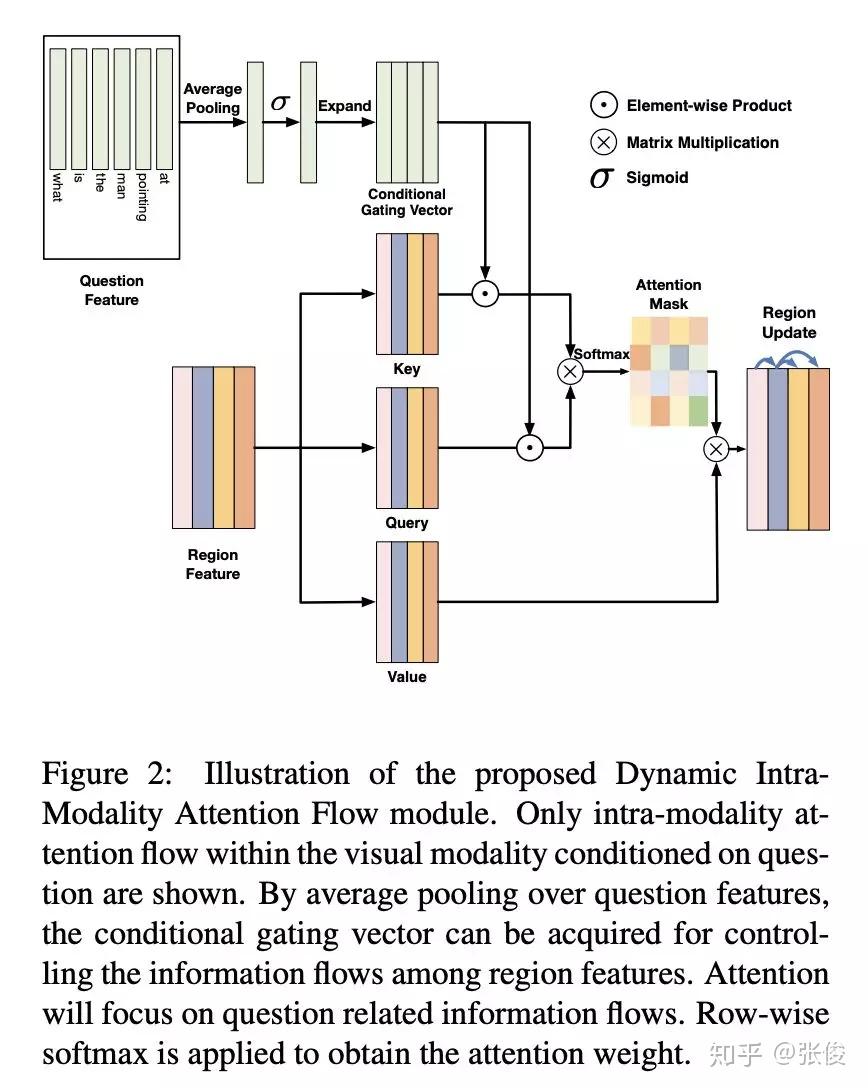

#Visual Question Answering

论文链接:https://www.paperweekly.site/papers/2859

源码链接:https://github.com/bupt-cist/DFAF-for-VQA.pytorch

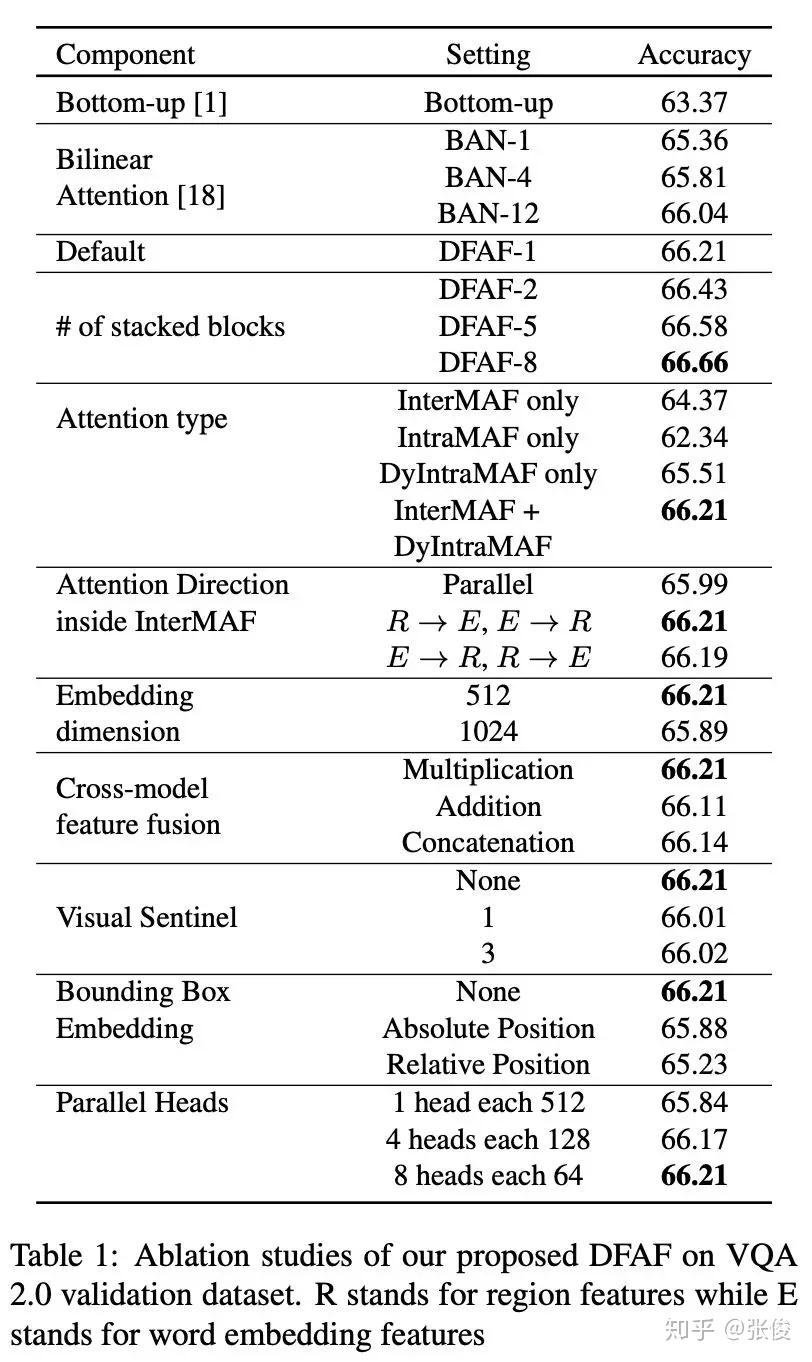

本文是一篇来自港中文、清华大学等机构的最新 VQA 论文,被 CVPR 2019 接收为口头报告。Github 上已经有人复现了该工作。

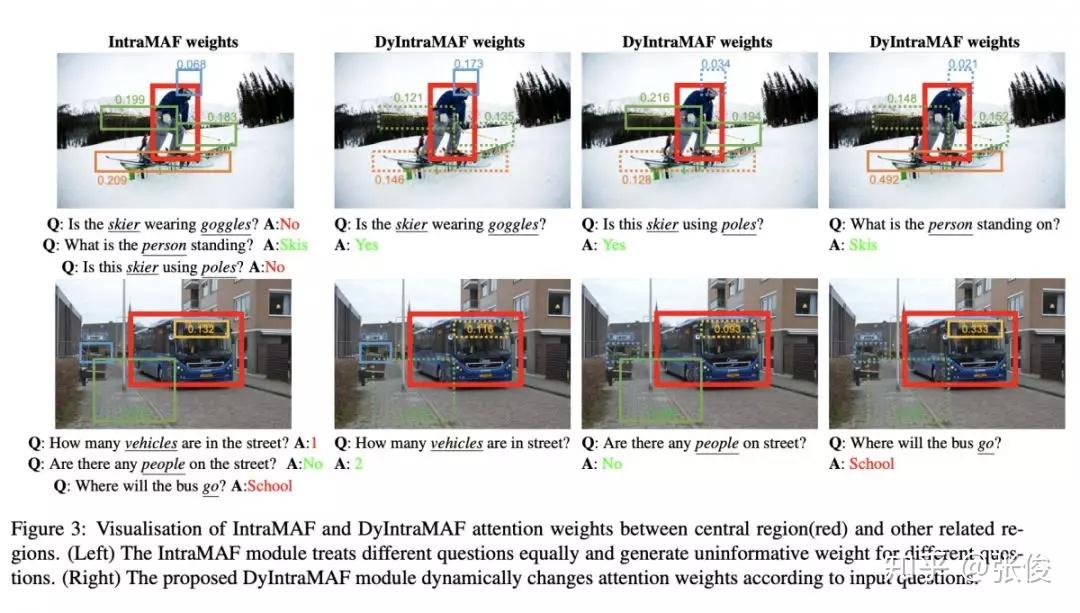

学习多模态之间的高效特征融合是视觉问答问题的核心,本文提出了一种动态融合多模态特征的新方法,通过模态内(intra-modality )和模态间(inter-modality)的信息流,交替地在视觉和语言模态之间传递动态信息。它可以稳健地捕获语言和视觉域之间的高层次语义交互,从而显著提高视觉问答的性能。

本文还发现,基于其它模态的约束,一种模态内的注意力可以动态调节目标模态的注意力。本文模型在 VQA2.0 数据集上实现了当前最好的效果。

@vimjian 推荐

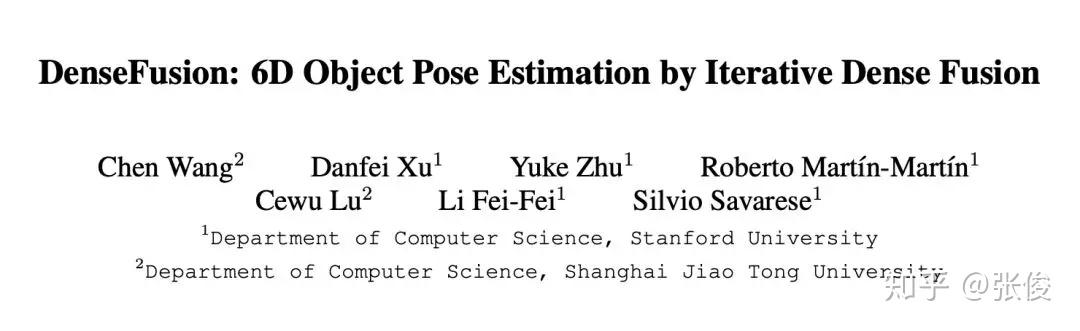

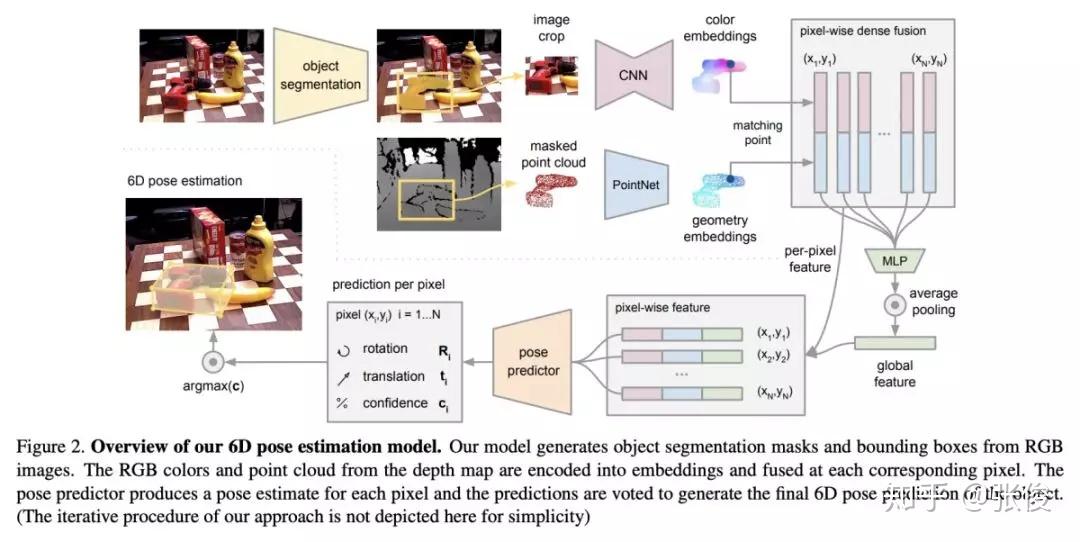

#6D Object Pose Estimation

论文链接:https://www.paperweekly.site/papers/2862

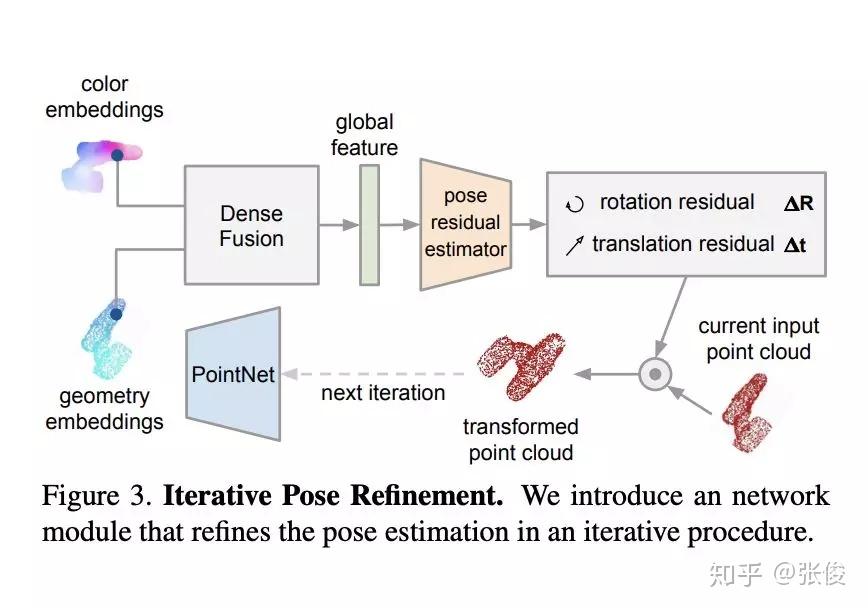

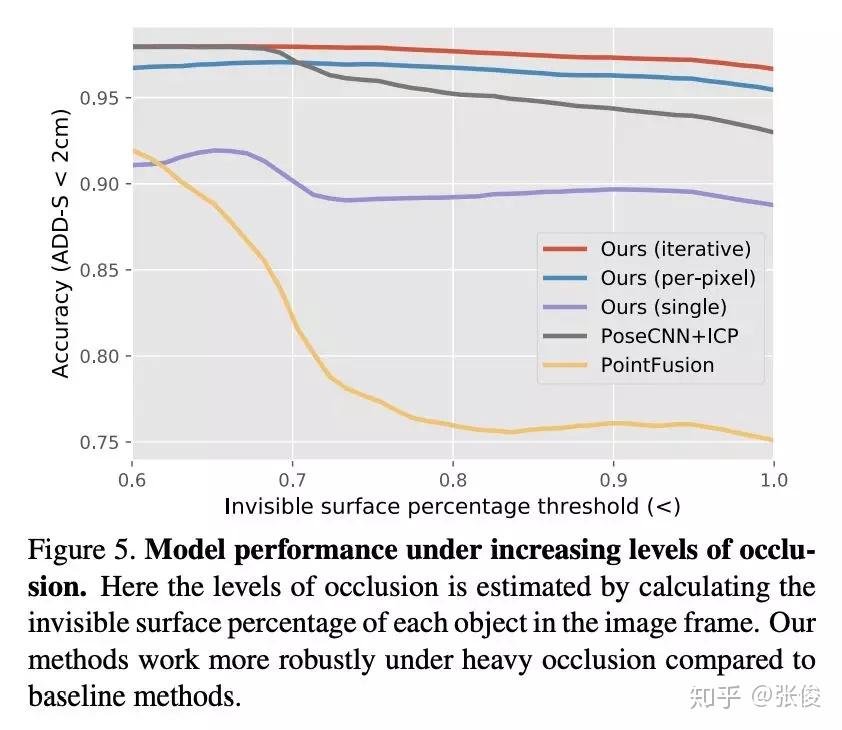

源码链接:https://github.com/j96w/DenseFusion

本文是斯坦福和上海交大发表于 CVPR 2019 的工作,论文提出了一种可单独处理两个数据源的异质架构—DenseFusion。实验表明,DenseFusion 在 YCB-Video 和 LineMOD 两个数据集上的表现都优于当前最先进的方法。此外,研究者还将该方法应用于真实的机器人上,使其可以根据估计的姿态来抓取和操纵目标。

@Flawless1202 推荐

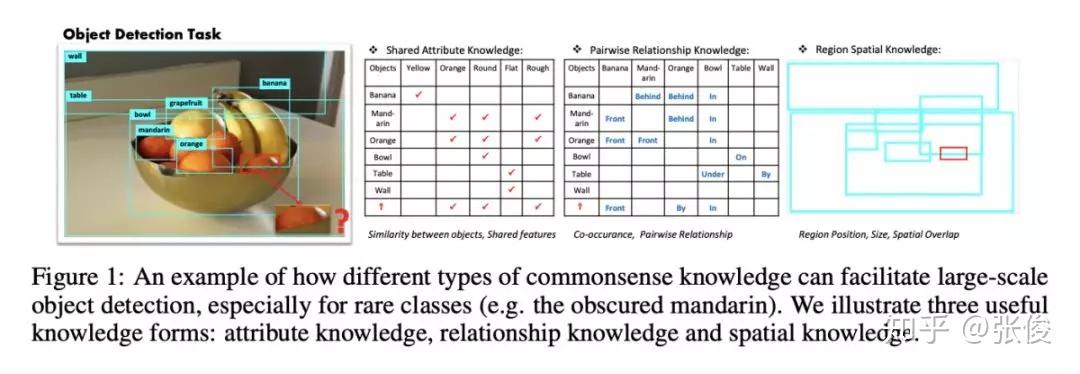

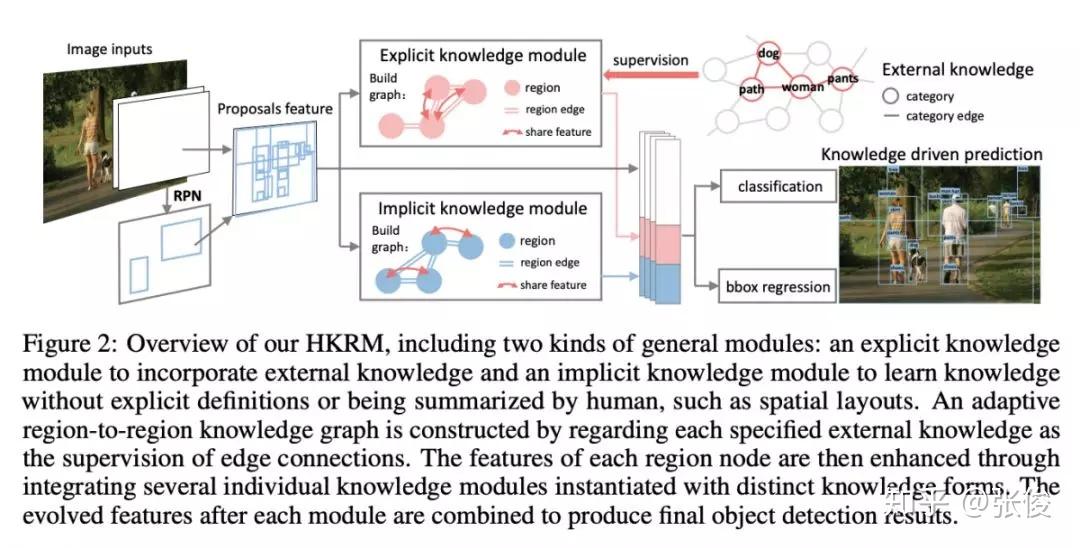

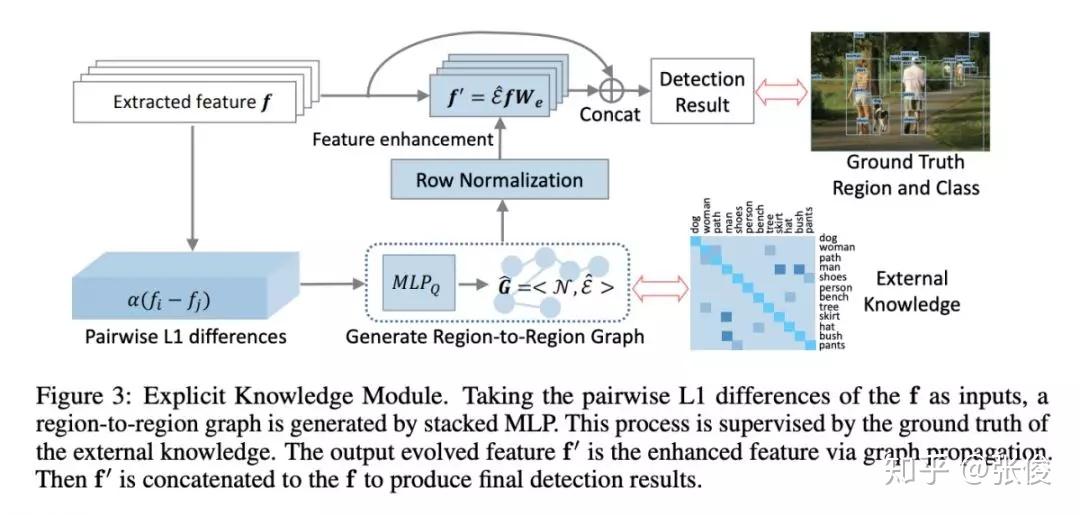

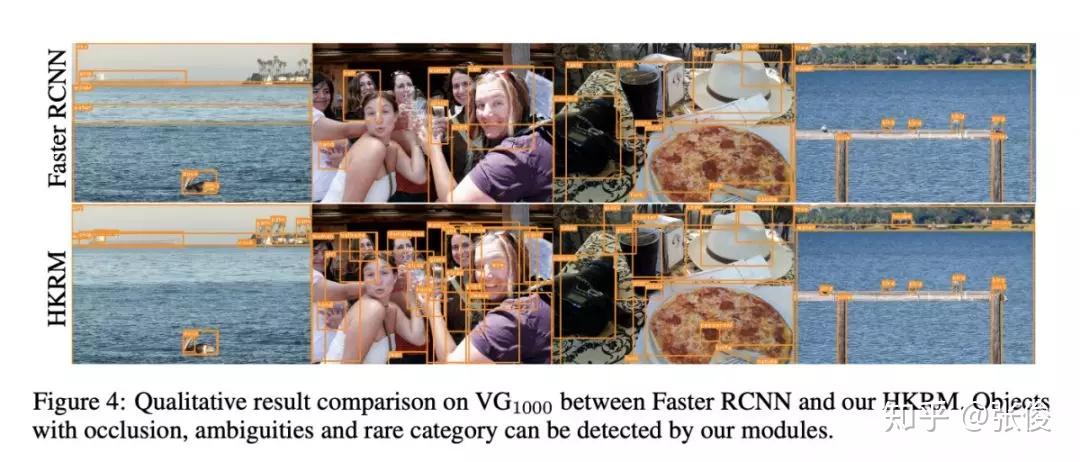

#Object Detection

论文链接:https://www.paperweekly.site/papers/2820

源码链接:https://github.com/chanyn/HKRM

本文是中山大学和华为诺亚方舟实验室发表于 NeurIPS 2018 的工作,论文提出了大规模目标检测的新思路,通过显性知识和隐性知识模块,将先验信息融合到神经网络中以丰富特征,取得了 SOTA 的效果。

@paperweekly 推荐

#Pose Transfer

论文链接:https://www.paperweekly.site/papers/2836

源码链接:https://github.com/AliaksandrSiarohin/monkey-net

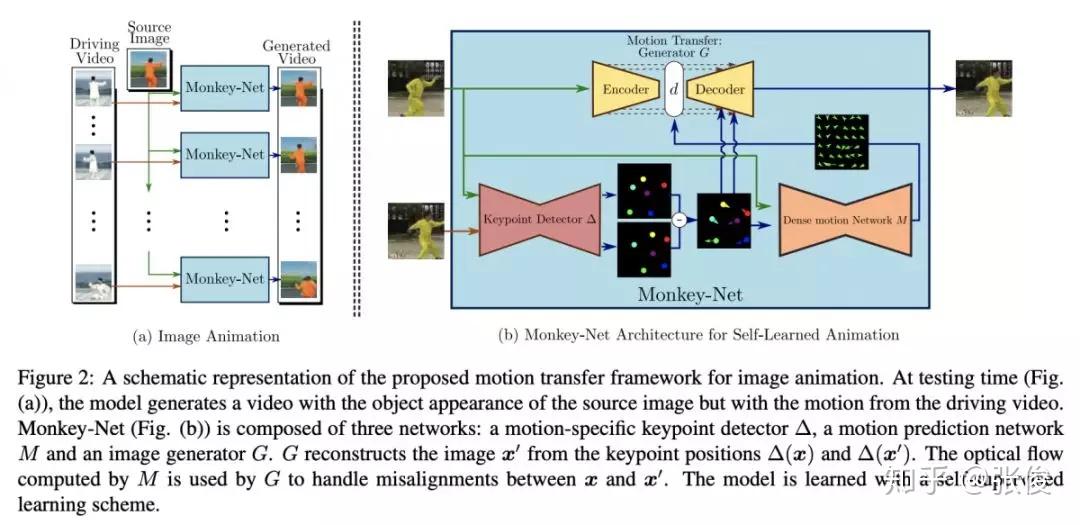

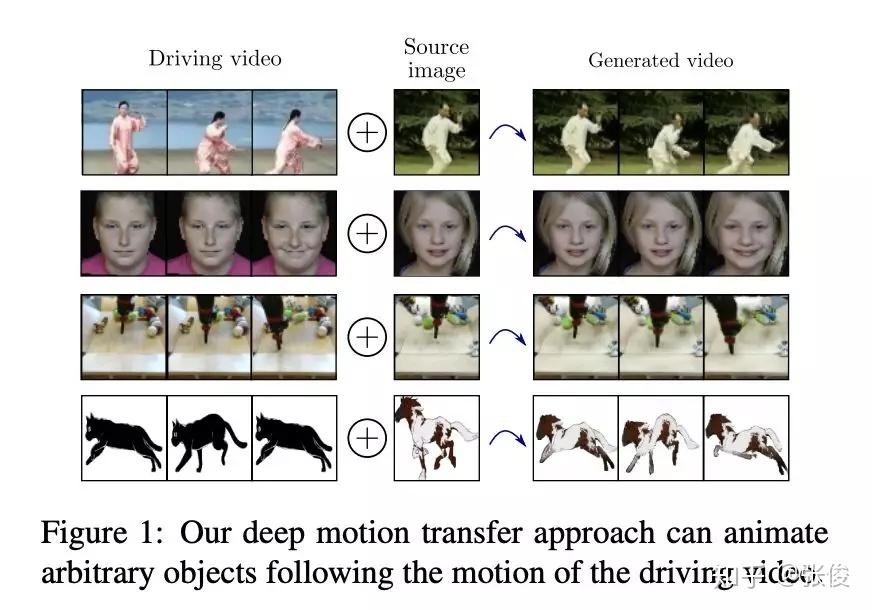

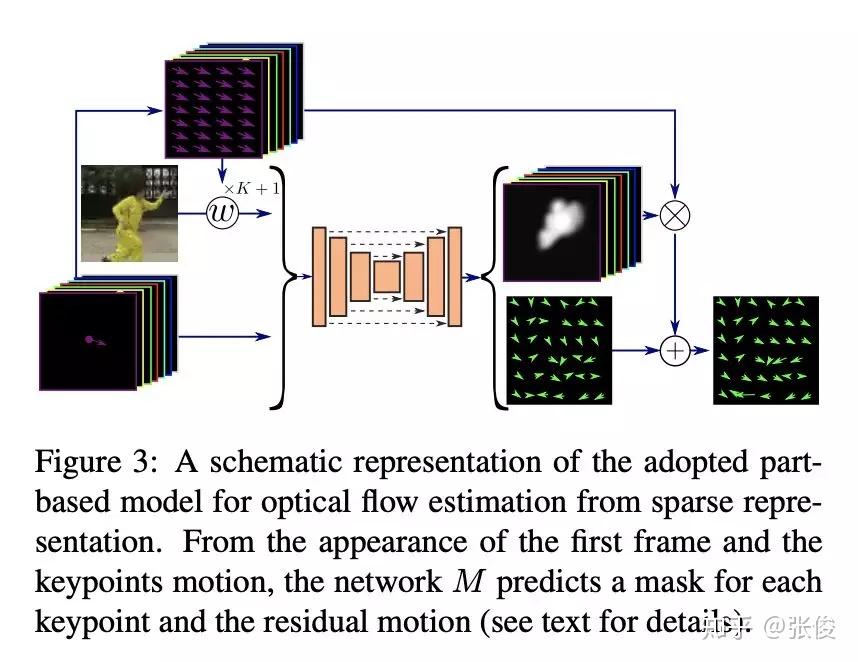

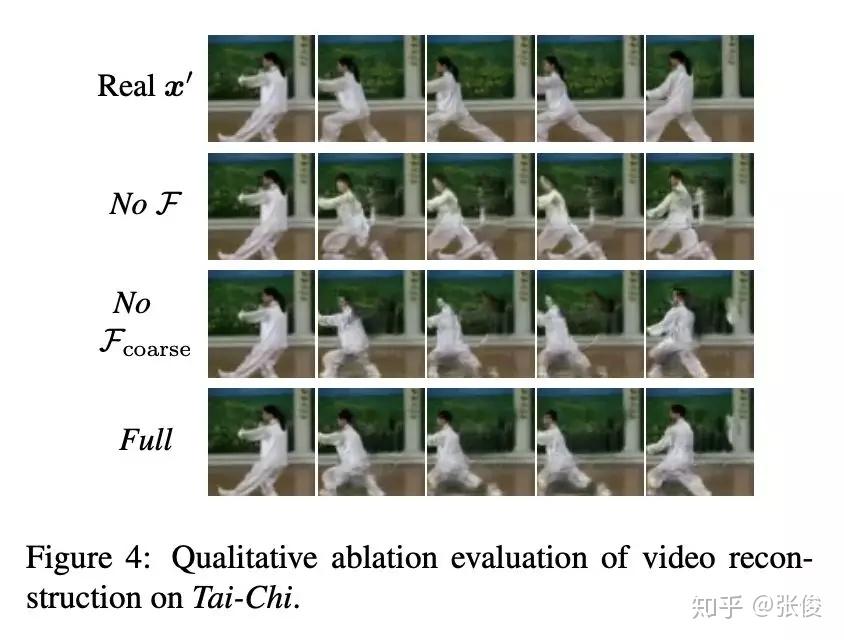

本文来自特伦托大学和Snap,论文研究的问题是将视频中的物体动作迁移到一张图片上,然后基于这张图片和指定动作生成一个新视频。

作者通过一个深度框架够将外形和运动信息解耦,该框架由三个模块组成:1)关键点检测器,可以无监督训练提取对象关键点;2)深度运动预测网络,可从稀疏关键点生成密集的热图(heatmaps),从而更好地编码运动信息;3)运动迁移网络,该网络基于运动热图和从输入图像提取的外形信息去合成输出帧。

@BelieveOP5 推荐

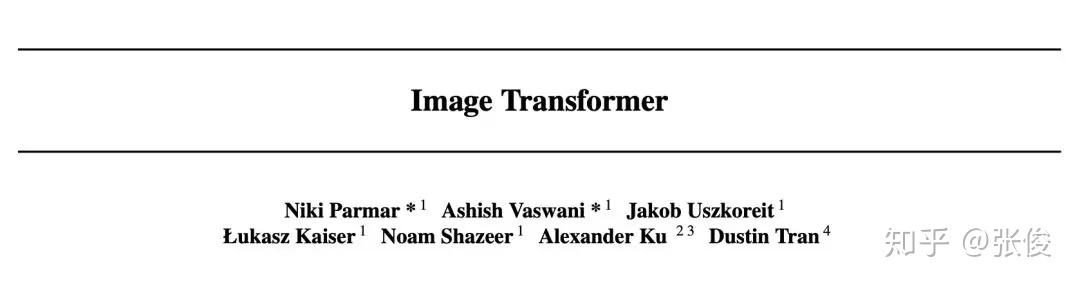

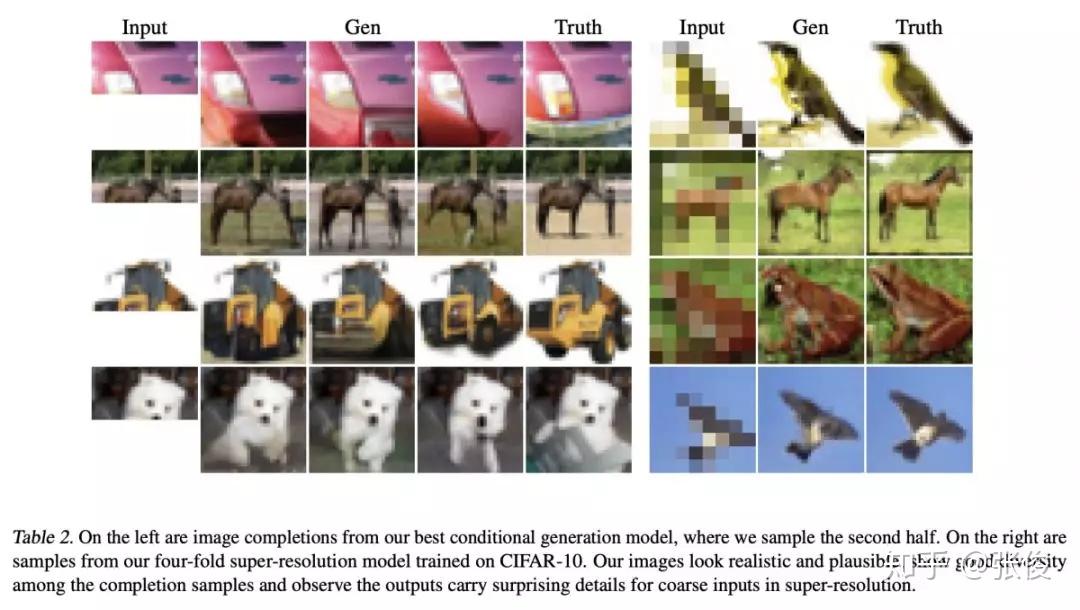

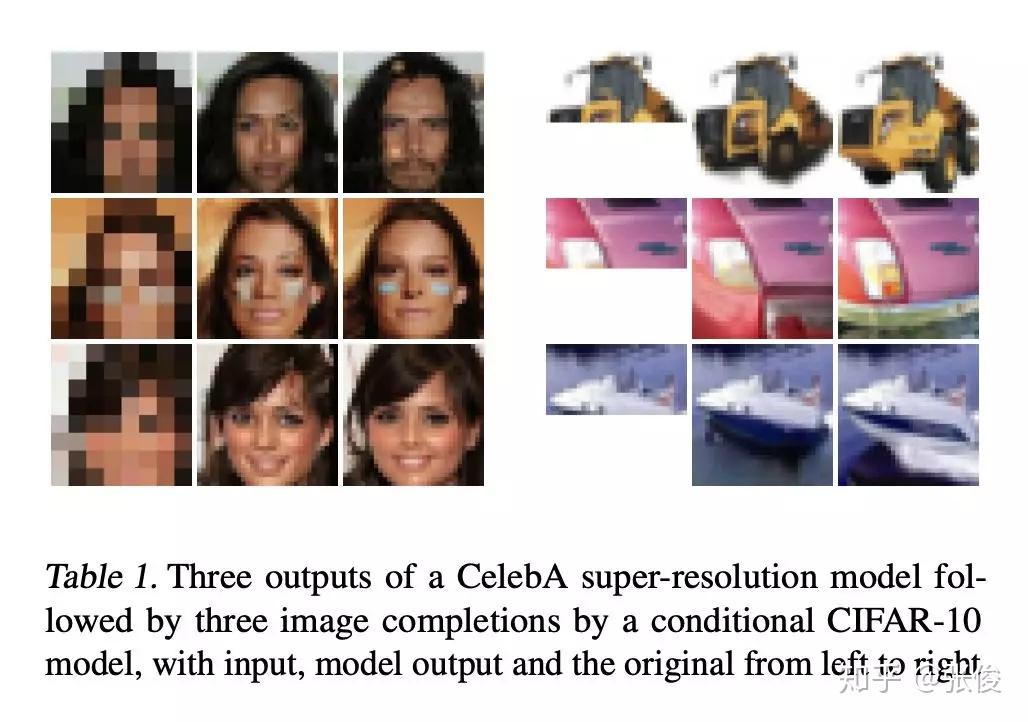

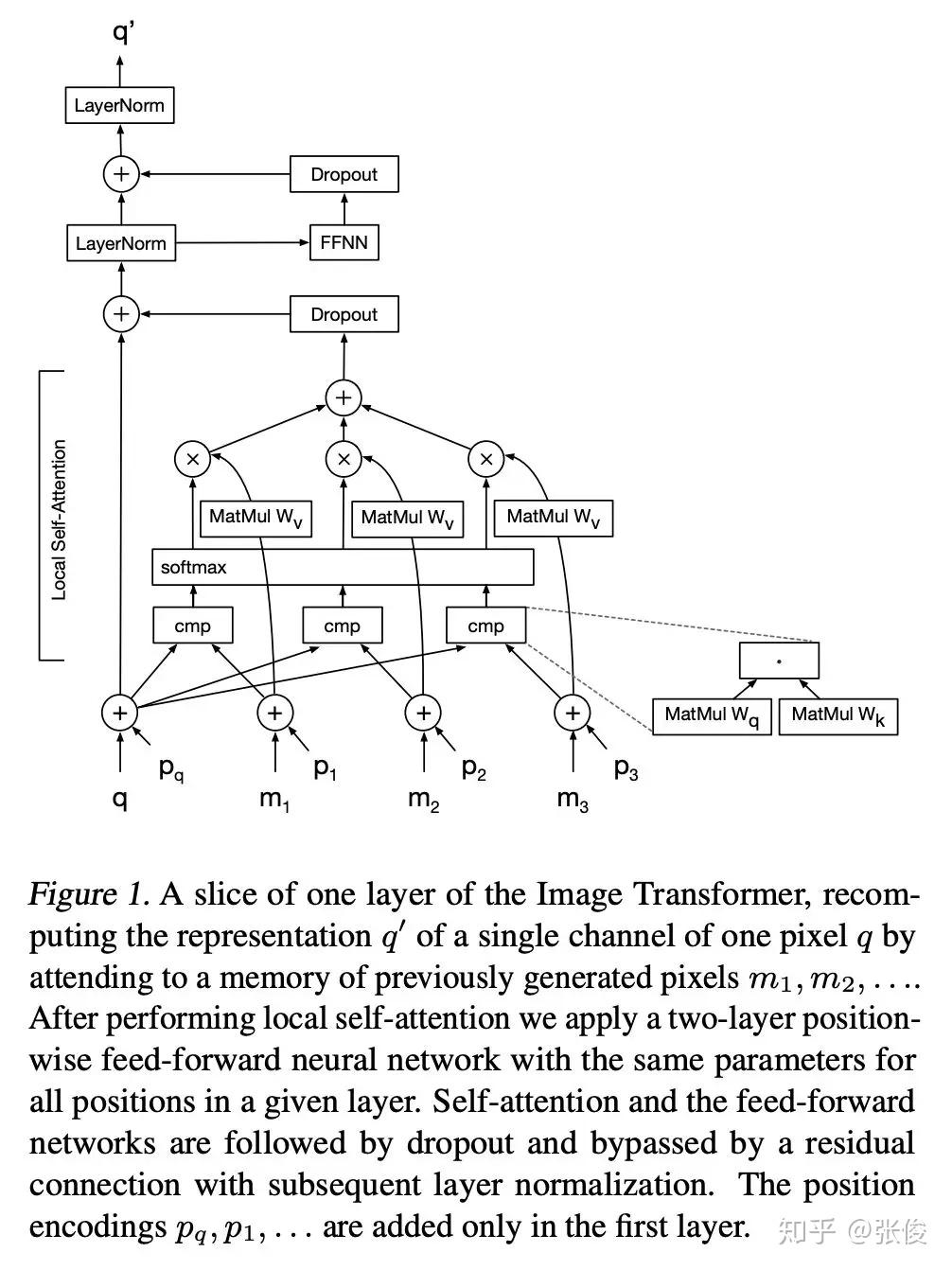

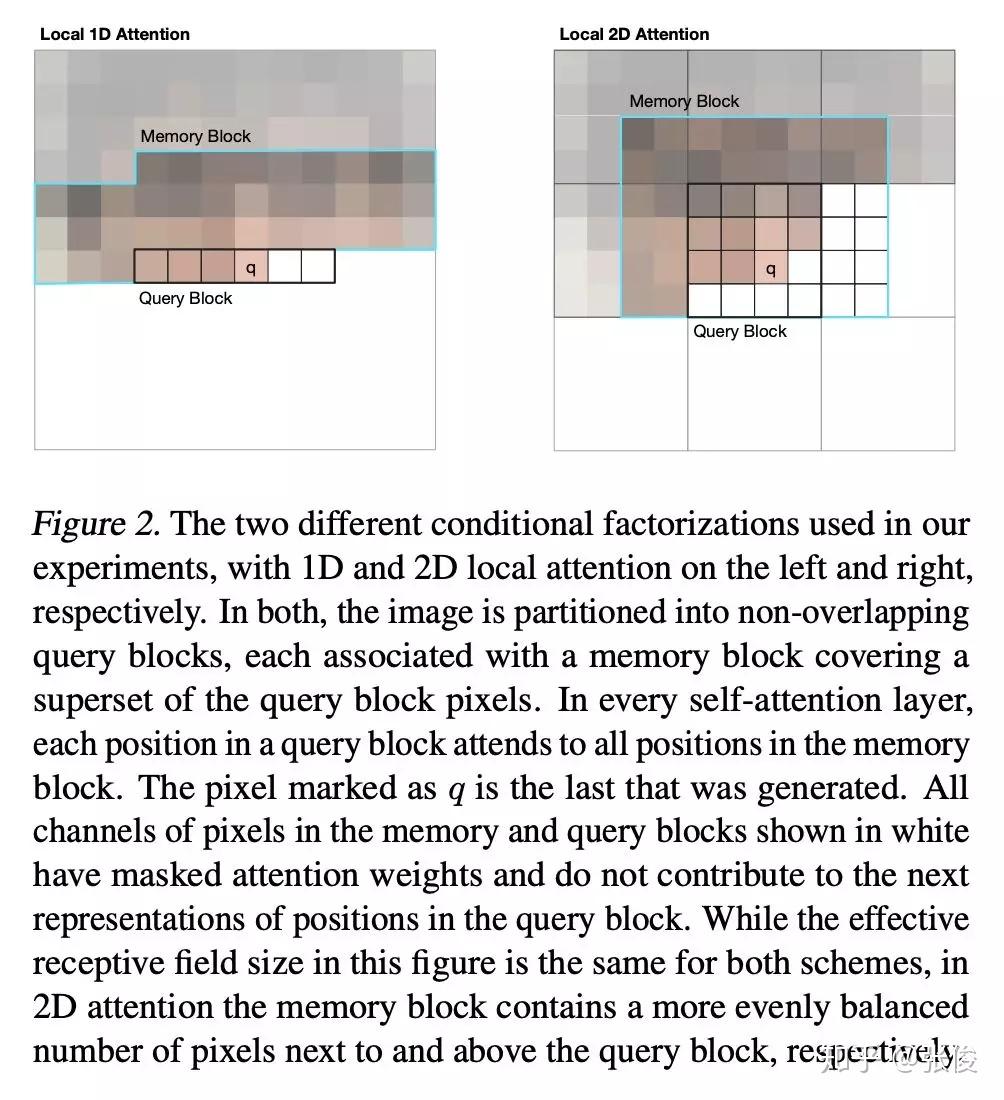

#Image Generation

论文链接:https://www.paperweekly.site/papers/2842

源码链接:https://github.com/tensorflow/tensor2tensor

本文是 Google AI 发表于 PMLR 2018 的工作,论文将图像超分辨和 Self-Attention 机制结合起来,提出了一种将 Self-Attention 机制应用在图像生成领域上的新方法,值得一看。

@alichen 推荐

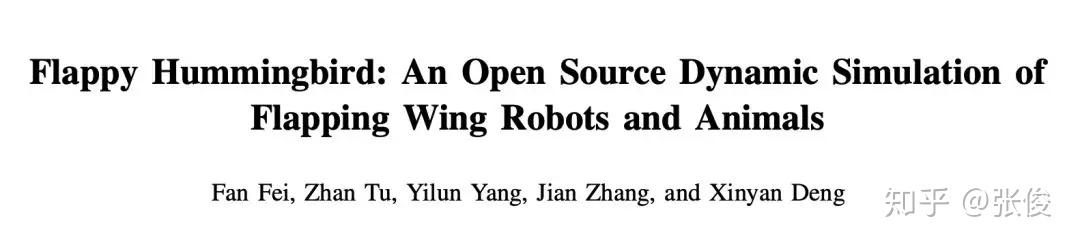

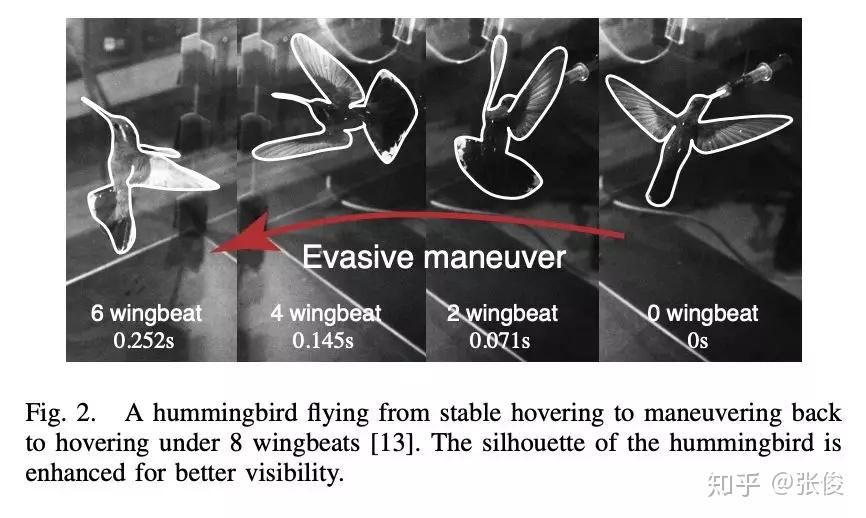

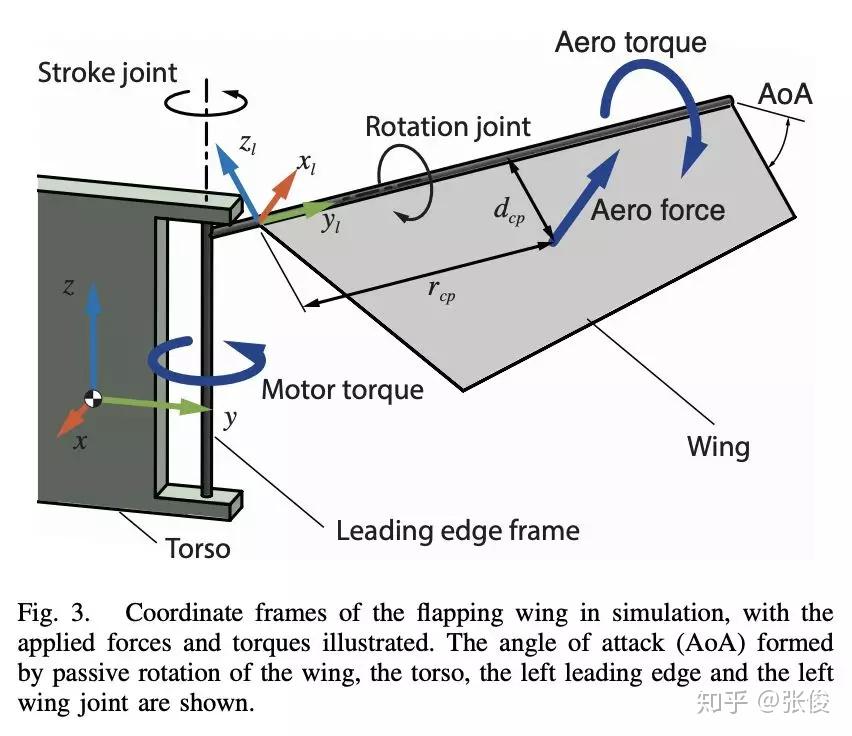

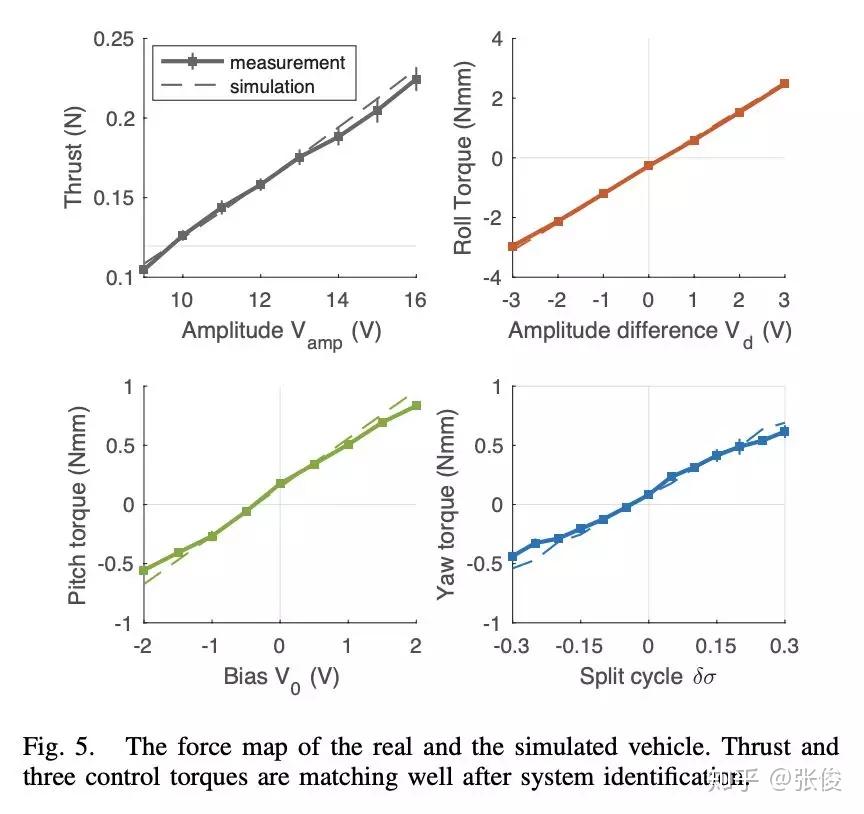

#Robotics

论文链接:https://www.paperweekly.site/papers/2860

源码链接:https://github.com/purdue-biorobotics/flappy

本文是普渡大学发表于 ICRA 2019 的工作。这篇文章提出了 Flapping Wing Micro Air Vehicles (FWMAVs) 开源仿真平台,并比较了仿真和实验测得的 force map,开环控制响应及闭环控制响应,发现仿真结果和实验结果非常相近。

和其他机器人仿真相比(例如 legged robots, ground vehicles),FWMAVs 仿真需要考虑在高频的 flapping motion 下,周围空气动力学的不稳定性,对系统进行建模难度更大。这个平台可用于机器人设计、控制与优化的研究,并与和 OpenAI Gym 环境完全兼容,利于今后强化学习和飞行控制相结合的研究。

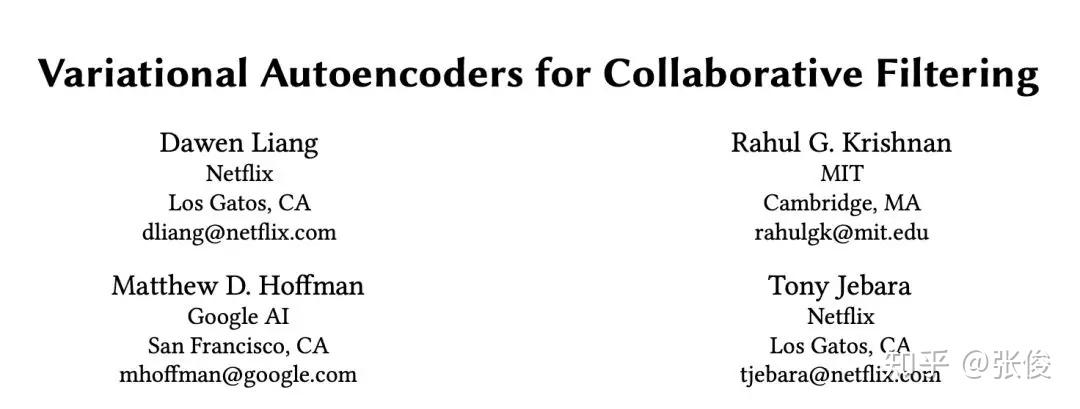

@paperweekly 推荐

#Collaborative Filtering

论文链接:https://www.paperweekly.site/papers/2606

源码链接:https://github.com/dawenl/vae_cf

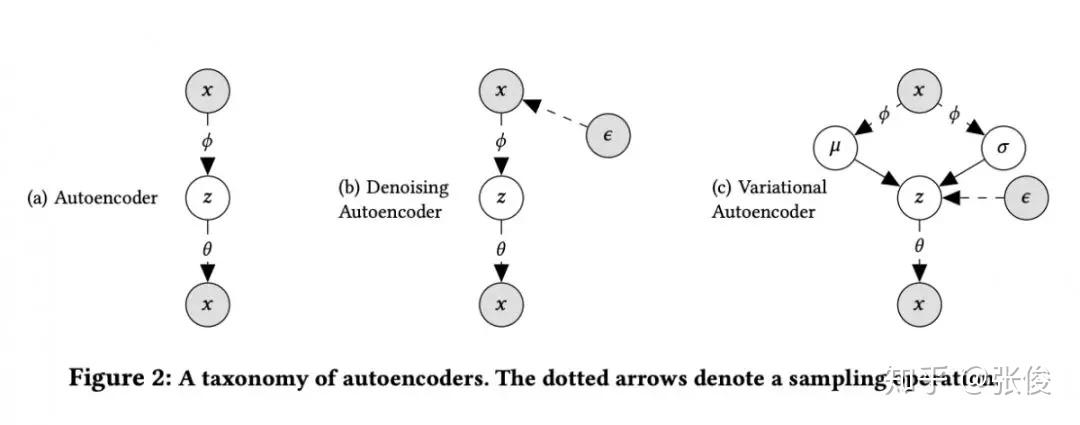

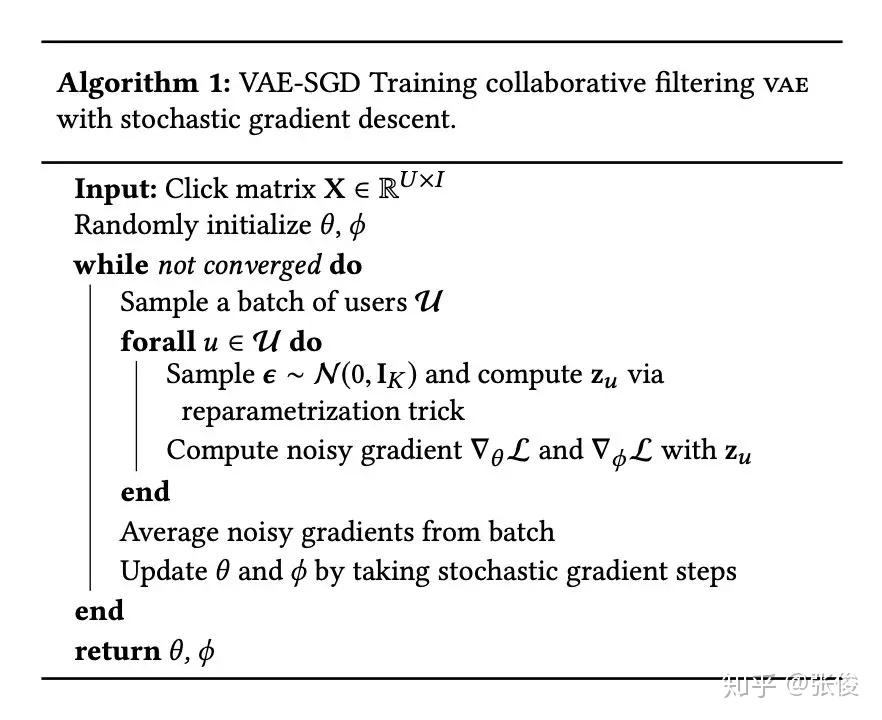

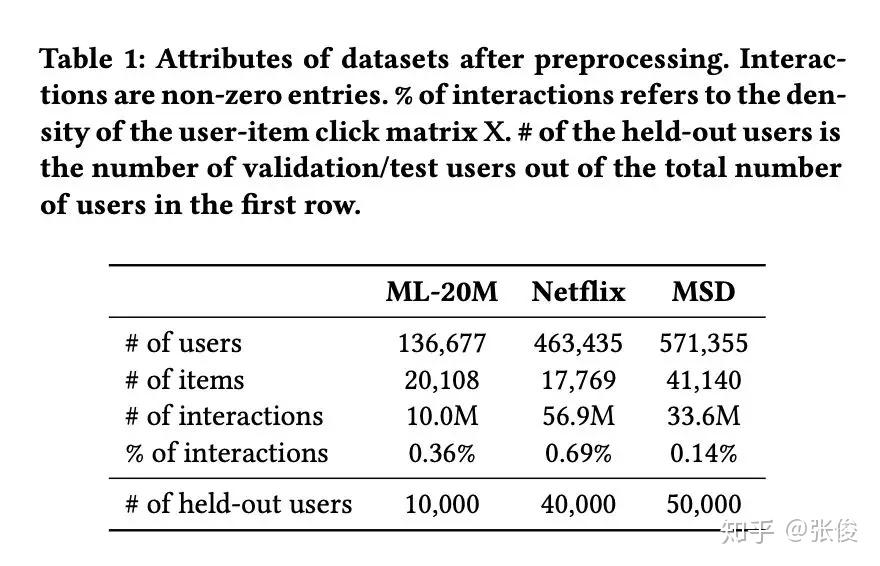

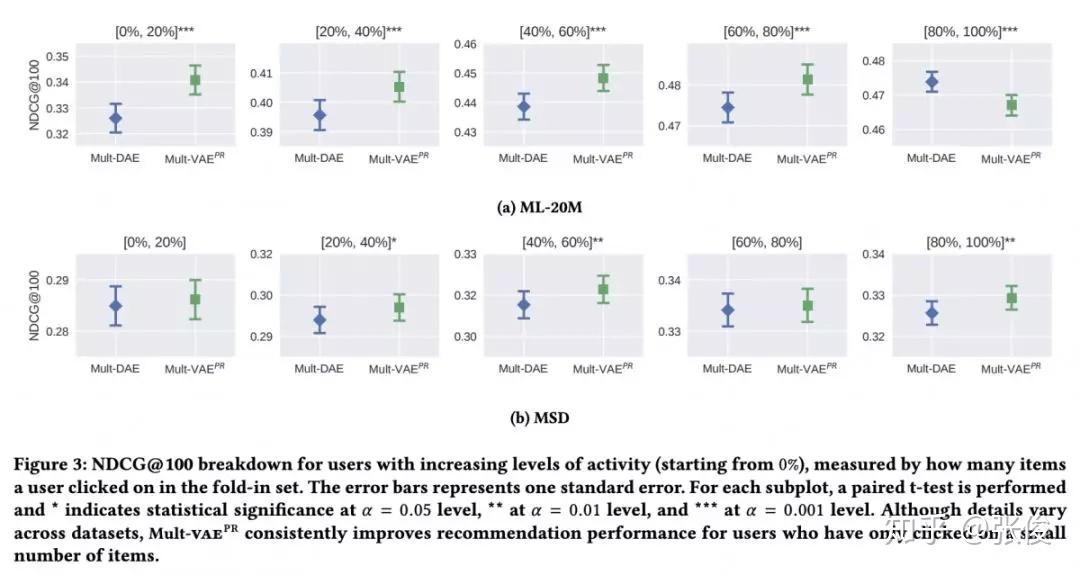

本文是 Netflix、MIT 和 Google AI 发表于 WWW 2018 的工作,论文将变分自编码器(VAE)扩展到协同过滤以进行隐式反馈,通过非线性概率模型克服线性因子模型的局限。其次,作者引入了具有多项式似然(multinomial likelihood)的生成模型,并使用贝叶斯推断进行参数估计。

作者基于 VAE 提出了一个生成模型 VAE_CF,并针对 VAE 的正则参数和概率模型选取做了适当调整,使其在当前推荐任务中取得最佳结果。

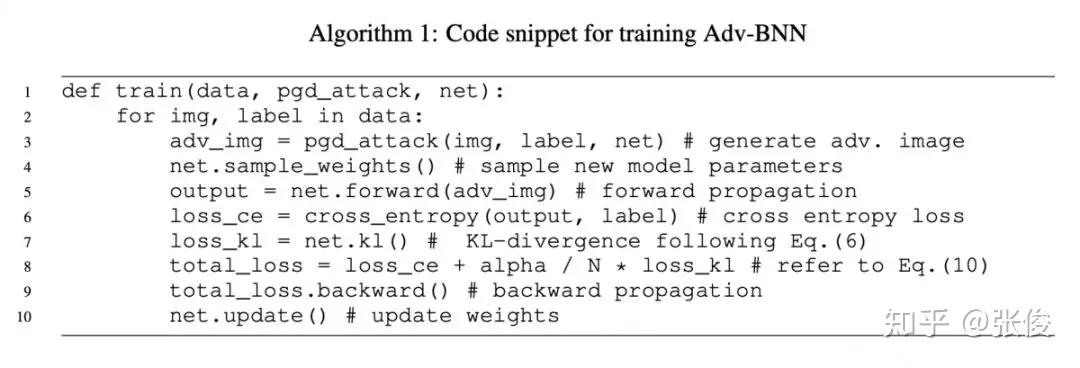

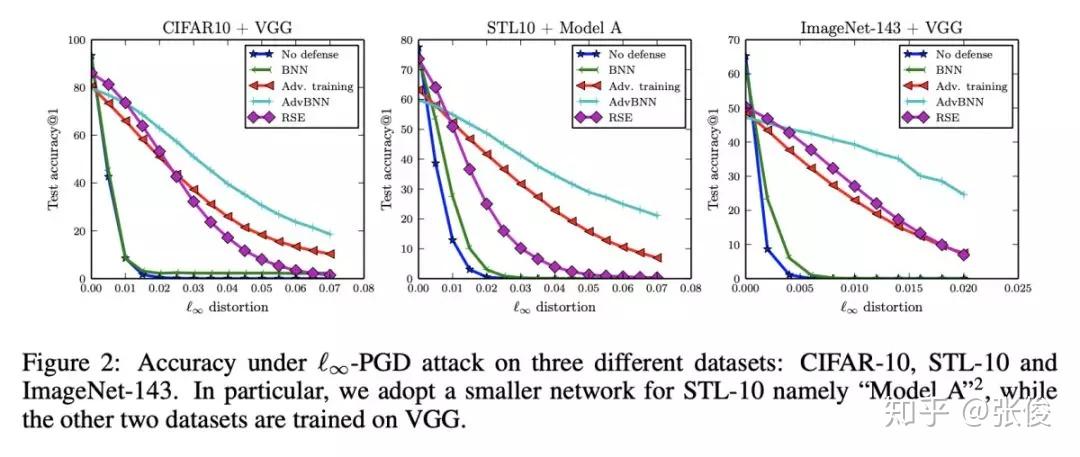

@zhangjun 推荐

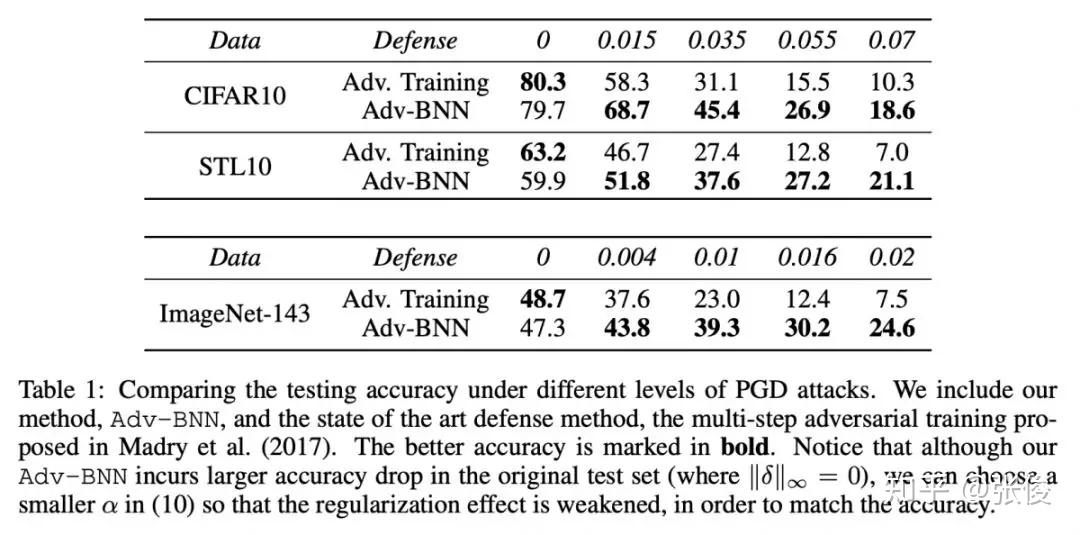

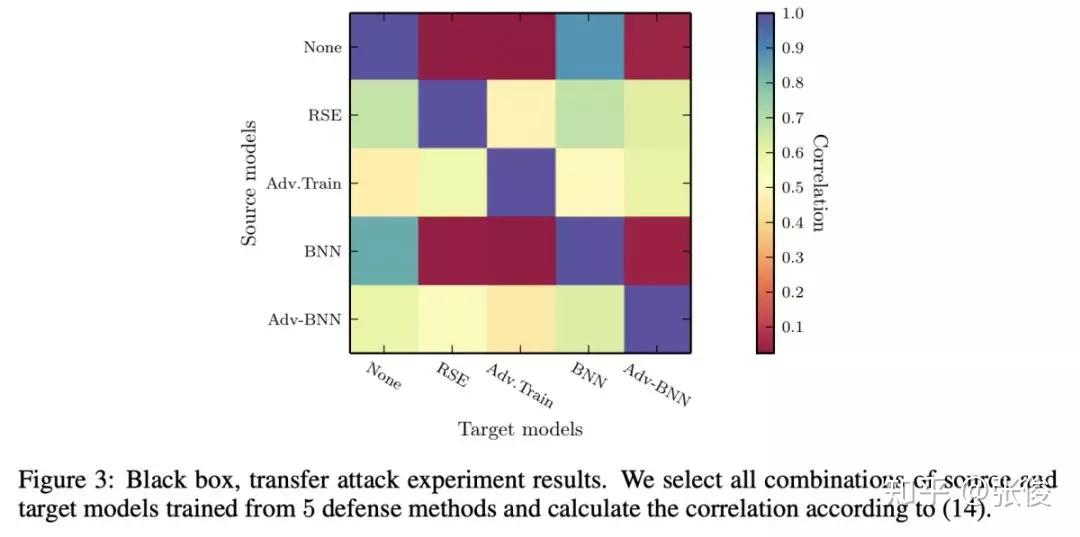

#Bayesian Neural Network

论文链接:https://www.paperweekly.site/papers/2758

源码链接:https://github.com/xuanqing94/BayesianDefense

本文是 UCLA 和 UC Davis 发表于 ICLR 2019 的工作,论文提出了一种新的对抗防御方法,结合了贝叶斯神经网络(BNN)和对抗训练的优势,获得了不错的效果。其中,BNN 将每个权重参数视作一个随机变量,在预测时相当于一个无限个数的集成模型,实验证明只依靠 BNN 并不能做好防御,结合对抗训练才会提升模型的防御能力。

点评:本文没有提出原创的方法,而是结合两种现有的方法进行了组合测试,取得了不错的效果。

@RememberMe 推荐

#Financial Time Series

论文链接:https://www.paperweekly.site/papers/2889

源码链接:https://github.com/omerbsezer/SparkDeepMlpGADow30

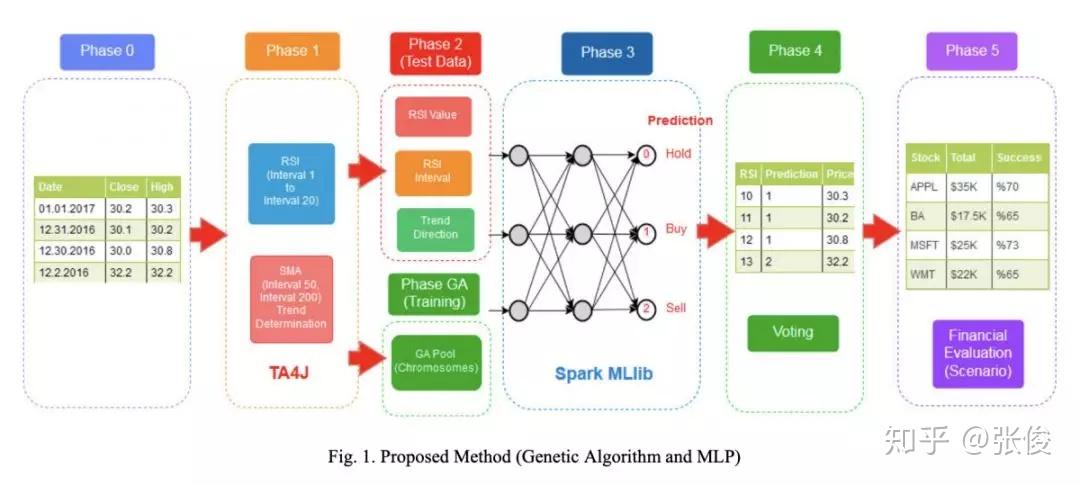

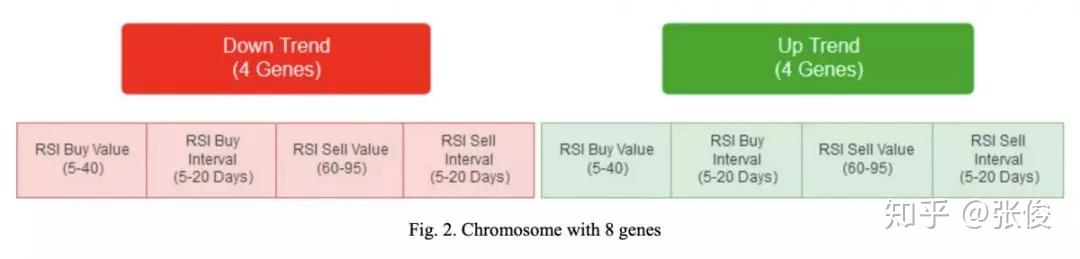

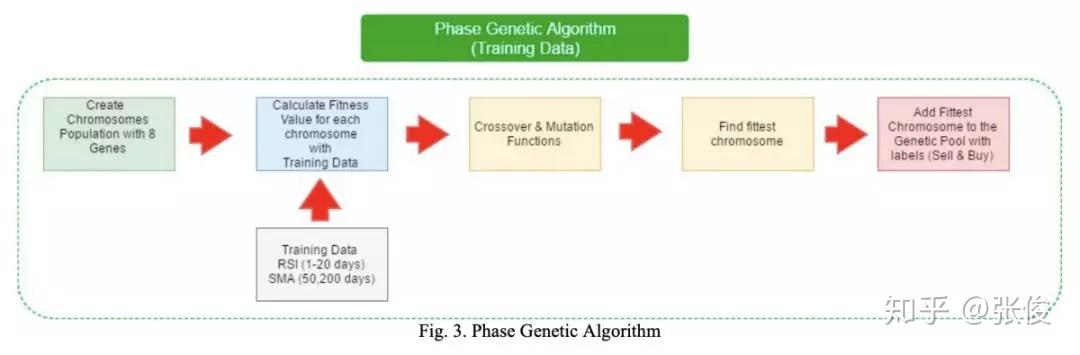

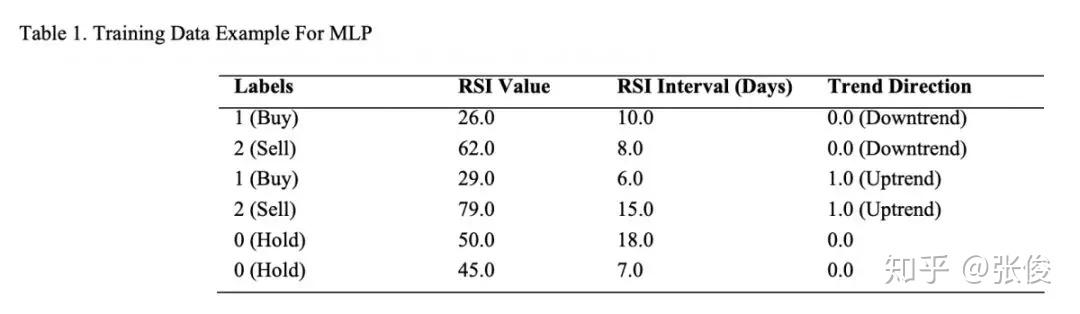

本文提出了一种确定股票价格时间序列中最佳 buy, sell, hold 时间点的股票交易模型,作者结合了两种已有方法 GA+DMLP (Genetic Algorithm and Deep Multi Layer Perceptron)。

具体思路:已有 1)技术分析指标(technical analysis indicator)作为深度网络模型的输入特征来做时间序列预测;2)用于技术分析指标寻优的进化算法。本文结合二者,将进化算法优化后的技术分析指标作为深度网络的输入特征,从而尝试使深度网络从进化算法的优化中学习判断最佳的进出点。

@chlr1995 推荐

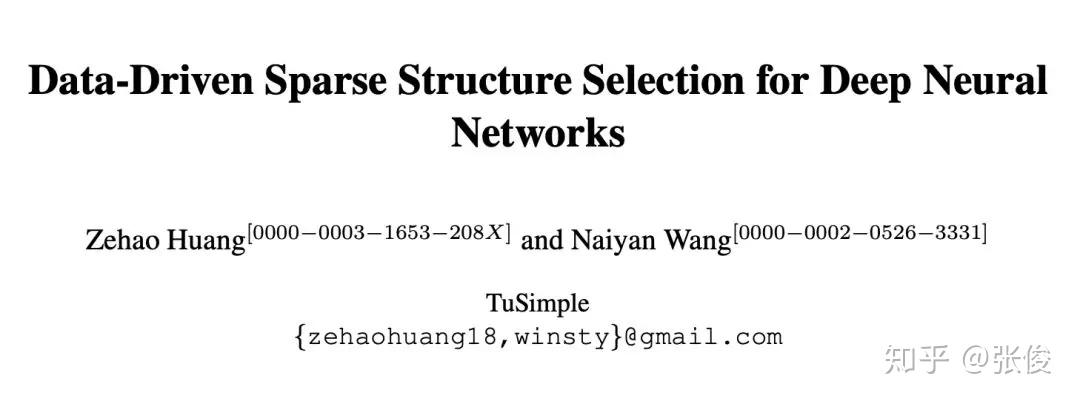

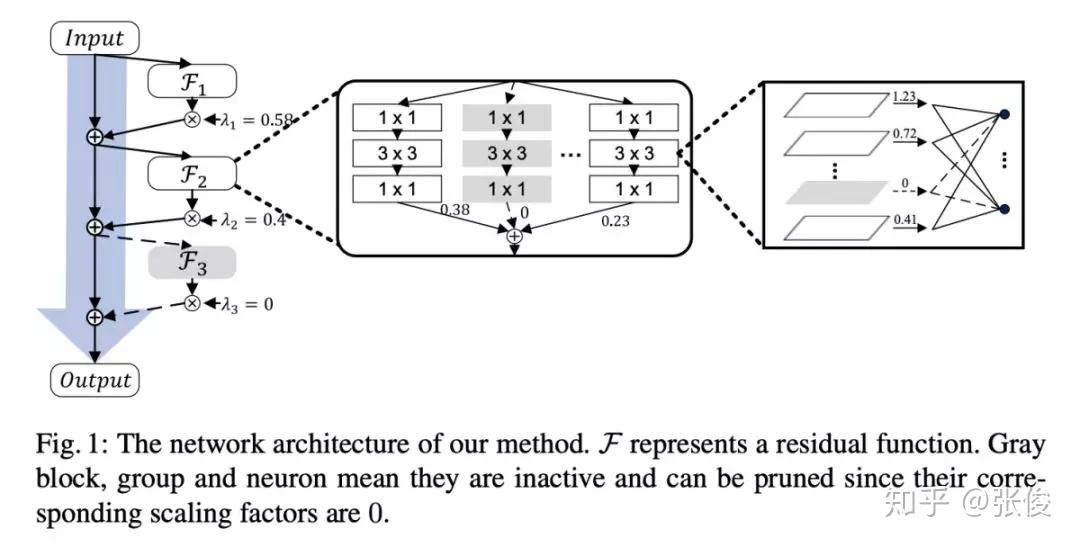

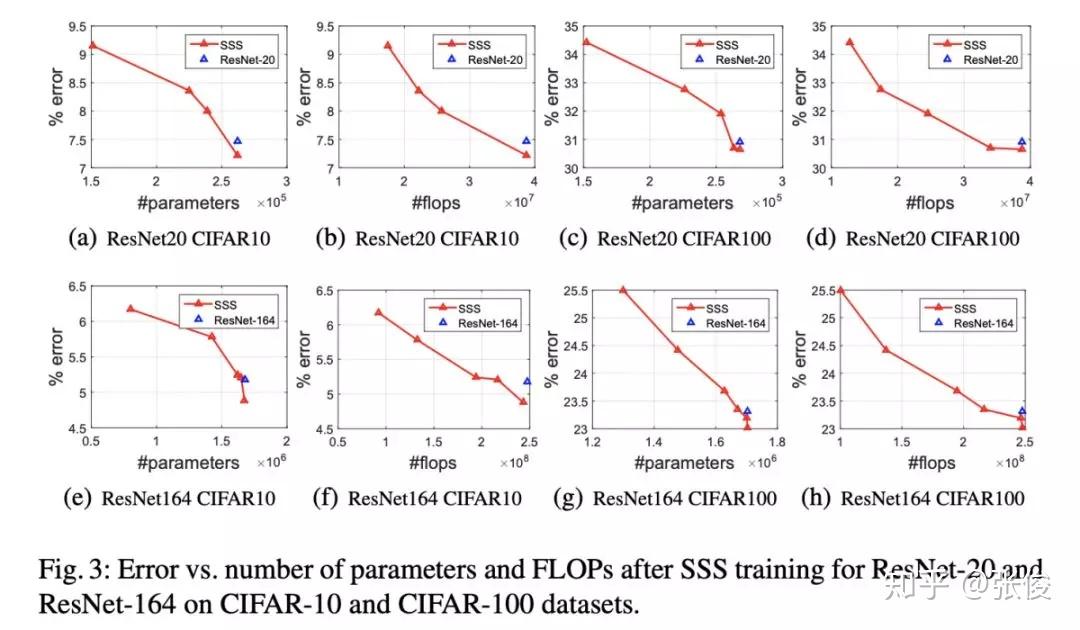

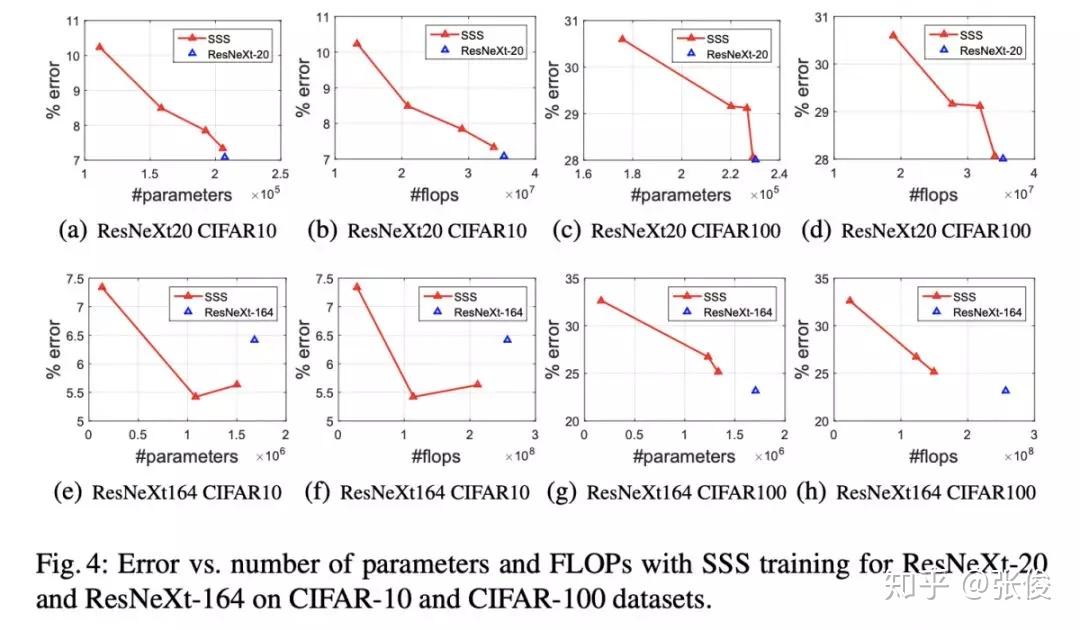

#Network Pruning

论文链接:https://www.paperweekly.site/papers/2540

源码链接:https://github.com/huangzehao/sparse-structure-selection

本文是图森发表在 ECCV 2018 的工作,论文在结构稀疏化的基础上提出了一种更简洁的方式,达到粗粒度的剪枝(直接剪枝整个 residual function/aggregated residual block 中的一个 group),通过引入一个结构缩放因子 lambda,在训练过程中对 lambda 施加一个 L1 正则化,训练结束后,剪掉 lambda=0 的块或 group,达成网络剪枝的效果。

#投 稿 通 道#

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢? 答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学习心得或技术干货。我们的目的只有一个,让知识真正流动起来。

来稿标准:

• 稿件确系个人原创作品,来稿需注明作者个人信息(姓名+学校/工作单位+学历/职位+研究方向)

• 如果文章并非首发,请在投稿时提醒并附上所有已发布链接

• PaperWeekly 默认每篇文章都是首发,均会添加“原创”标志

投稿方式:

• 方法一:在PaperWeekly知乎专栏页面点击“投稿”,即可递交文章

• 方法二:发送邮件至:hr@paperweekly.site ,所有文章配图,请单独在附件中发送

• 请留下即时联系方式(微信或手机),以便我们在编辑发布时和作者沟通

关于PaperWeekly

PaperWeekly 是一个推荐、解读、讨论、报道人工智能前沿论文成果的学术平台。如果你研究或从事 AI 领域,欢迎在公众号后台点击「交流群」,小助手将把你带入 PaperWeekly 的交流群里。

加入社区:http://paperweek.ly

微信公众号:PaperWeekly

新浪微博:@PaperWeekly

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!