今天Flood和大家分享一下Chelsea Finn的博士论文赏析。

Chelsea Finn,想必很多人还是很熟悉的,可以说是AI圈最牛逼的博士之一吧。我也算是自来粉,虽然曾经的paper还被她弊了,但是她的paper我都看啊。

所以我们来看看她的博士论文,吊炸天的博士论文,应该还是可以有所启发的。

她的博士论文名称叫Learning to Learn with Gradients,大家Google一下可以找到原文。

看到这个名称,我的第一感觉是她真的对自己的MAML及之后基于MAML的各种应用有一个非常深刻的理解。MAML的方法可以说是Meta Learning三大方法之一,另外两个方法就是conditional neural network条件神经网络及neural network parameter generator神经网络参数生成,具体我们可以单独开一个blog说。MAML的特点在于通过梯度下降的方法来Learning to Learn。想来还是蛮特别的,所以很多应用本来加个条件神经网络加以处理,改用MAML就显得很fancy。

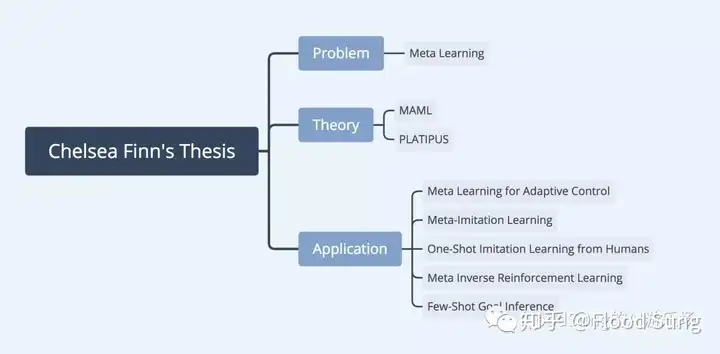

现在我们来说说Chelsea Finn的工作。她的工作给人的感觉就是非常的完整solid,简单的说就是:

1)选择一个新问题

2)构造一个新的方法论

3)基于新的方法论做应用

Chelsea Finn完美的做到了。她的博士论文简直就是一个Meta Learning或者MAML的教程。MAML现在的影响力非常大,虽然方法论看起来真的非常简单。但可能也是正因为简单,所以大家都在用。某种程度上,MAML可以类比Ian Goodfellow提出的GAN,都是各种领域的一个全新方法,并且基本原理都非常简单,只是GAN可以做出很酷炫的视觉效果,而MAML在Meta Learning上相对比较局限,特别是Chelsea Finn只是在Robot Learning领域上做,不过也足够酷了。这确实是一个顶级PhD做出来的事情,很佩服。

那么看她的博士论文,我们应该思考什么问题呢?

1. 为什么选择Meta Learning这一研究方向?

2. 为什么构造出MAML这一通用Meta Learning算法?

3. 为什么选择做这些robot learning的应用?

Meta Learning一开始只是在Few-Shot Learning问题上做,然后当时Reinforcement Learning这块大家最大的质疑恐怕就是测试集就是训练集本身(比如玩Atari游戏,就只是在Atari这个游戏本身上玩高分)。那Reinf