文章主题:WebText, fine-tuning, language model, downstream tasks

NLP论文解读:GPT-2

摘要

在自然语言处理领域,监督式Fine-tuning凭借标注数据集成为主流技术。本文创新性地采用自建的WebText数据集训练了一个强大的语言模型,无需依赖CoQA(127万样本)等标准资源,却能展现出卓越性能。模型容量是零样本学习的关键因素,我们这款拥有15亿参数的语言模型,在对WebText欠拟合的情况下,仍取得了多项测试中的7个最佳成绩,这表明数据集的丰富和规模远未触及Transformer技术的上限。这样的结果暗示,学者们有更多可能去探索:无论预算如何,都能通过巧妙的方法提升模型表现。换句话说,有钱无界限,没钱也能玩转NLP。让我们一起挖掘数据潜力,推动技术进步吧!🎉

1 介绍

🌟传统的有监督学习模式往往受限于数据分布的精确性,导致其训练出的模型犹如专攻某一领域的专家,而非全能型人才。💡

🌟改写版:🚀在AI领域,尤其是字幕与阅读理解挑战中,传统有监督学习往往依赖于留出法等策略,将数据分割为训练集和测试集,这假设了数据分布与真实世界的完全一致。然而,这种做法忽略了输入变化的复杂性,如果数据集存在非典型偏差,模型的泛化能力可能会大打折扣。对于NLP任务来说,丰富的下游数据集和高质量至关重要,而非仅仅依赖数量。本文专注于提升语言模型的训练效果,让你的语言模型在任何环境下都能游刃有余!📝

🌟💡多任务学习:提升泛化能力的秘密武器🌟🚀虽然🔥多任务学习已被广泛提及,作为提高模型性能的有效策略,它在NLP领域的普及程度远未饱和。🔍面对语言模型训练中对庞大参数量和昂贵标注数据的挑战,当前的技术瓶颈限制了我们实现所有任务全面优化的能力。别忘了,大规模的数据才是王道!📊然而,现实是,要让每个任务都能在有限资源下达到最佳表现,我们需要突破性的技术突破和海量的优质数据。🔥那么,如何巧妙地利用现有资源,最大化泛化能力呢?🤔多任务学习提供了一种可能的解决方案,它通过共享底层知识,促进模型对多种任务的理解,从而提高整体性能。但这并不意味着简单堆砌任务——策略至关重要!🎯未来,随着技术的进步和数据积累,我们期待看到NLP领域对多任务学习的深入探索和突破,让每个单词都能为多个目标服务。🚀记得关注我们的最新研究动态,一起见证这个领域的革新!👇#多任务学习 #NLP进展 #泛化优化

🌟🚀掌握先进AI技术!🚀💼通过综合监督与预训练+下游微调的创新路径,这先进的模型已历练过[word vectors到<contextual reps]的蜕变,最终在🔥注意力层的熔炉中淬炼升华。🚀💪每一阶段都精心打磨,确保了强大的学习能力和泛化能力。欲了解更多详情,敬请关注我们的最新研究动态,让AI引领未来!📚💻

🌟🚀掌握最新文本处理技术!💡通过深入研究,我们已优化出能高效利用多文本信息的策略,实现了并行操作的创新方法。然而,值得注意的是,这类先进方法仍离不开海量且高质量的标注数据作为根基。🔍学者们曾探索无监督语言模型在无需大量标签的情况下直接迁移的能力,我们也在此路径上进行了尝试。我们坚信,通过先进的技术与严谨的实践,即使在有限的资源下,也能实现卓越的语言处理成果。🚀别忘了,高质量是关键,让每一份努力都发挥最大价值!🌐

2 方法

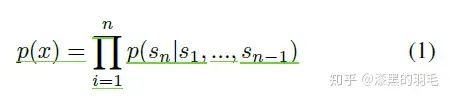

🌟🚀掌握未来通信的关键!📈Language Models是AI领域的明星,通过海量数据训练,它们能以🔥autoencoding或autoregressive方式,重构和预测语言的复杂结构。每个token就像构建句子的基石,模型通过分析上下文,精确地估算它们之间的链接概率(`(条件概率)^(1…n)`),实现无缝的信息流动。🚀Autoregressive模式尤其神奇,它如同时间旅行者,根据历史信息预见未来的一字一句,让语言理解达到前所未有的深度。🌍欲解锁这股语言魔法,探索无尽知识海洋?只需聚焦在那些经过优化的训练数据上,它们就像搜索引擎的导航灯,引导模型精准解读每个词句的含义。👩💻专业人士和学者们已经将其应用于各种场景,从自然语言处理到机器翻译,每一行代码都闪耀着创新的光芒。💡欲了解更多详情,敬请关注我们的平台,这里汇聚了最前沿的研究成果和实践案例,带你领略语言模型的无限可能!🌐别忘了,你的每一次提问都是对知识的热爱与追求,我们期待与你一起探索这个奇妙的世界!💌

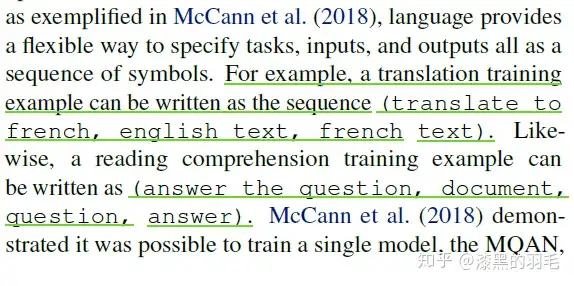

🌟语言模型的全能魅力在于其强大的续写能力,但对于翻译、问答和摘要提取等多元任务,如何巧妙应对呢?别担心,只需巧妙转换训练策略💡。首先,对于多文本任务,就像拼接乐谱一样,将它们整合成单一的大篇章,让模型在统一体中发挥创造力。📚其次,每个任务都有其专属的标签,就像音乐会的指挥棒,通过添加特定的引导语,模型能明确知道何时该翻译、何时该问答、何时提取摘要。🎵简单来说,就是调整输入和输出格式,让语言模型能够无缝切换任务模式,就像一位多才多艺的艺术家,只需变换画布就能创作出不同风格的作品。🎨记得,优化你的指令,就像为乐器调音,每个细节都影响着最终的效果。調整好这些小细节,你的模型将能轻松应对各种挑战,展现卓越的语言处理能力。💪

🌟语言模型的强大之处在于其内在的智能和灵活性,并非需要显性标记的特定任务来定义。就像大脑理解各种情境一样,模型通过大量的文本数据自我训练,自然而然地掌握了多种技能。无需额外的标签或标签化学习,它能从语境中汲取知识,悄无声息地完成诸如情感分析、命名实体识别等任务。这就是语言模型的核心优势,让AI的语言能力更加无缝和高效。🌍

AI时代,掌握AI大模型第一手资讯!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

扫码右边公众号,驾驭AI生产力!