文章主题:AI, CPAL, 论文, 录用结果

在我国AI领域,一场盛大的会议——CPAL,近日公布了它的论文录用结果。这次会议共收到了来自全国各地的30篇Oral和60篇Spotlight论文。对于那些致力于AI研究的人们来说,这是一个极好的消息,也是一个展示自己研究成果的绝佳机会。想要参加 CPAL 会议,可以通过以下步骤进行报名。首先,你需要查看 CPAL 官网上的会议通知,了解会议的具体时间、地点以及报名截止日期等信息。然后,按照官网的要求,填写好个人信息和论文摘要,并将其发送至官方邮箱。最后,你将收到 CPAL 的确认邮件,以及关于如何在会议上展示你的论文的详细信息。总的来说,CPAL 为我国 AI 研究者提供了一个难得的机会,让你能够与同行们分享自己的研究成果,同时也能学习到最新的 AI 研究动态。如果你对此感兴趣,那么请务必关注 CPAL 会议,并积极参与其中。

新智元报道

编辑:拉燕

【新智元导读】国内AI学术顶会CPAL,终于确定了所有论文录用结果,两个轨道共90篇论文录用!线下会议时间2024年1月3日至6日,登记报名截止2023年12月15日。

大家可能还记得,今年五月份公布的,将由国内大佬马毅和沈向洋牵头办的全新首届AI学术会议CPAL。

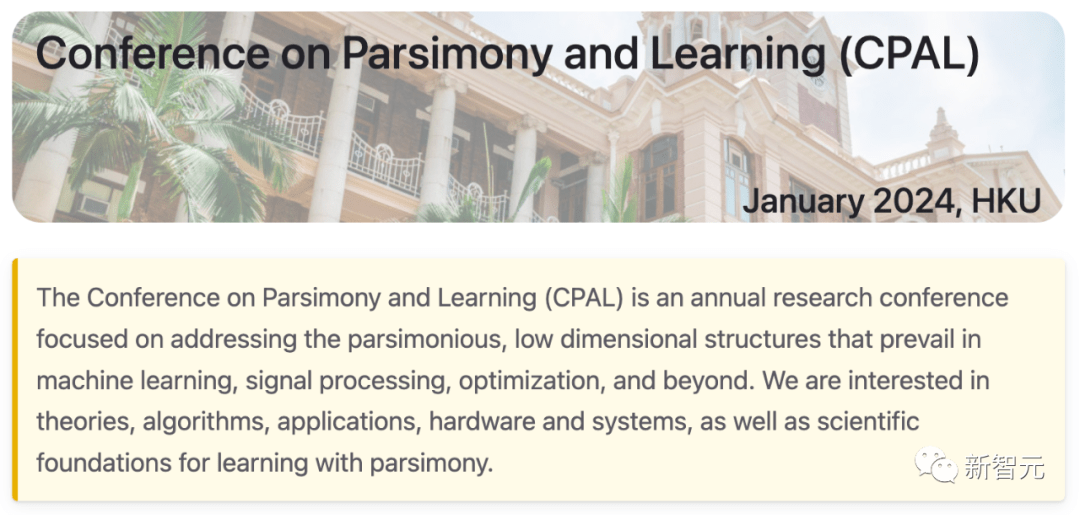

这里我们再介绍一下CPAL到底是个什么会,以防有的读者时间太久有遗忘——

CPAL(Conference on Parsimony and Learning)名为简约学术会议,每年举办一次。

第一届CPAL将于2024年1月3日-6日,在香港大学数据科学研究院举办。

大会地址:https://cpal.cc

就像名称明示的那样,这个年度研究型学术会议注重的就是「简约」。

第一届会议一共有两个轨道(track),一个是论文集轨道(存档)和一个「最新亮点」轨道(非存档)。

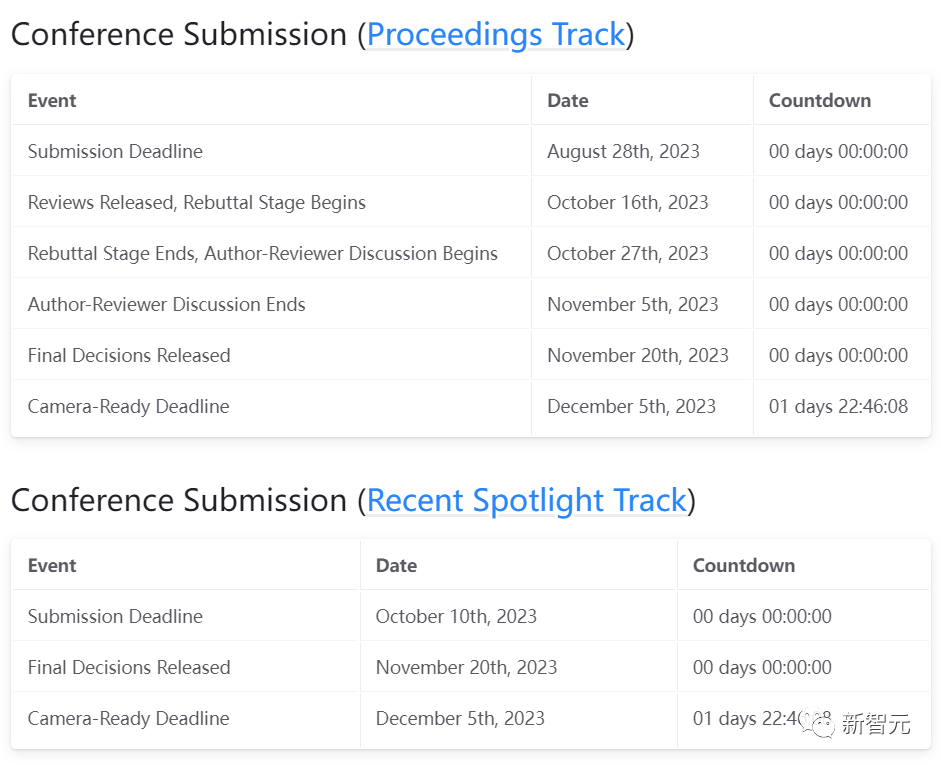

具体的时间线我们也再复习一下:

可以看到,论文集轨道的论文提交截止日期已经过去了三个多月,「最新亮点」轨道的论文提交截止也已经过去了一个多月。

而在刚刚过去的十一月底,大会发布了两个轨道的最终评审结果。

最终录用结果

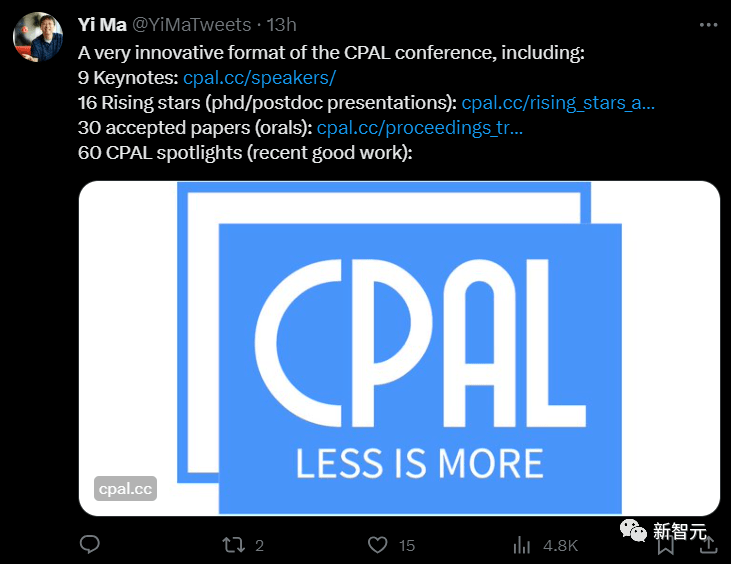

马毅教授也在推特上发布了最终的结果:9位主讲人,16位新星奖获奖者,共接收30篇论文(论文集轨道)和60篇「最新亮点」轨道中的论文。

马教授的推特中也附上了每一部分的网址链接,点击即可跳转到相关页面。

30篇Oral论文

1. Less is More – Towards parsimonious multi-task models using structured sparsity

作者:Richa Upadhyay, Ronald Phlypo, Rajkumar Saini, Marcus Liwicki

关键词:Multi-task learning, structured sparsity, group sparsity, parameter pruning, semantic segmentation, depth estimation, surface normal estimation

TL;DR:我们提出了一种在多任务环境下利用动态组稀疏性开发简约模型的方法。

2. Closed-Loop Tranion via Convolutional Sparse Coding

作者:Xili Dai, Ke Chen, Shengbang Tong, Jingyuan Zhang, Xingjian Gao, Mingyang Li, Druv Pai, Yuexiang Zhai, Xiaojun Yuan, Heung-Yeung Shum, Lionel Ni, Yi Ma

关键词:Convolutional Sparse Coding, Inverse Problem, Closed-Loop Tranion

3. Leveraging Sparse Input and Sparse Models: Efficient Distributed Learning in Resource-Constrained Environments

作者:Emmanouil Kariotakis, Grigorios Tsagkatakis, Panagiotis Tsakalides, Anastasios Kyrillidis

关键词:sparse neural network training, efficient training

TL;DR:设计和研究一个系统,利用输入层和中间层的稀疏性,由资源有限的工作者以分布式方式训练和运行神经网络。

4. How to Prune Your Language Model: Recovering Accuracy on the “Sparsity May Cry” Benchmark

作者:Eldar Kurtic, Torsten Hoefler, Dan Alistarh

关键词:pruning, deep learning, benchmarking

TL;DR:我们提供了一套语言模型的剪枝指南,并将其应用于具有挑战性的Sparsity May Cry基准测试,以恢复准确性。

5. Image Quality Assessment: Integrating Model-centric and Data-centric Approaches

作者:Peibei Cao, Dingquan Li, Kede Ma

关键词:Learning-based IQA, model-centric IQA, data-centric IQA, sampling-worthiness.

6. Jaxpruner: A Concise Library for Sparsity Research

作者:Joo Hyung Lee, Wonpyo Park, Nicole Elyse Mitchell, Jonathan Pilault, Johan Samir Obando Ceron, Han-Byul Kim, Namhoon Lee, Elias Frantar, Yun Long, Amir Yazdanbakhsh, Woohyun Han, Shivani Agrawal, Suvinay Subramanian, Xin Wang, Sheng-Chun Kao, Xingyao Zhang, Trevor Gale, Aart J.C. Bik, Milen Ferev, Zhonglin Han, Hong-Seok Kim, Yann Dauphin, Gintare Karolina Dziugaite, Pablo Samuel Castro, Utku Evci

关键词:jax, sparsity, pruning, quantization, sparse training, efficiency, library, software

TL;DR:本文介绍了 JaxPruner,这是一个用于机器学习研究的、基于JAX的开源剪枝和稀疏训练库。

7. NeuroMixGDP: A Neural Collapse-Inspired Random Mixup for Private Data Release

作者:Donghao Li, Yang Cao, Yuan Yao

关键词:Neural Collapse, Differential privacy, Private data publishing, Mixup

TL;DR:本文提出了一种新颖的隐私数据发布框架,称为 NeuroMixGDP,它利用神经坍缩特征的随机混合来实现最先进的隐私-效用权衡。

8. Algorithm Design for Online Meta-Learning with Task Boundary Detection

作者:Daouda Sow, Sen Lin, Yingbin Liang, Junshan Zhang

关键词:online meta-learning, task boundary detection, domain shift, dynamic regret, out of distribution detection

TL;DR:我们提出了一种新的算法,用于在不知道任务边界的非稳态环境中进行与任务无关的在线元学习。

9. Unsupervised Learning of Structured Representation via Closed-Loop Tranion

作者:Shengbang Tong, Xili Dai, Yubei Chen, Mingyang Li, ZENGYI LI, Brent Yi, Yann LeCun, Yi Ma

关键词:Unsupervised/Self-supervised Learning, Closed-Loop Tranion

10. Exploring Minimally Sufficient Representation in Active Learning through Label-Irrelevant Patch Augmentation

作者:Zhiyu Xue, Yinlong Dai, Qi Lei

关键词:Active Learning, Data Augmentation, Minimally Sufficient Representation

11. Probing Biological and Artificial Neural Networks with Task-dependent Neural Manifolds

作者:Michael Kuoch, Chi-Ning Chou, Nikhil Parthasarathy, Joel Dapello, James J. DiCarlo, Haim Sompolinsky, SueYeon Chung

关键词:Computational Neuroscience, Neural Manifolds, Neural Geometry, Representational Geometry, Biologically inspired vision models, Neuro-AI

TL;DR:利用流形容量理论和流形对齐分析,研究和比较猕猴视觉皮层的表征和不同目标训练的DNN表征。

12. An Adaptive Tangent Feature Perspective of Neural Networks

作者:Daniel LeJeune, Sina Alemohammad

关键词:adaptive, kernel learning, tangent kernel, neural networks, low rank

TL;DR:具有神经网络结构的自适应特征模型,对权重矩阵施加近似低秩正则化。

13. Balance is Essence: Accelerating Sparse Training via Adaptive Gradient Correction

作者:Bowen Lei, Dongkuan Xu, Ruqi Zhang, Shuren He, Bani Mallick

关键词:Sparse Training, Space-time Co-efficiency, Acceleration, Stability, Gradient Correction

14. Deep Leakage from Model in Federated Learning

作者:Zihao Zhao, Mengen Luo, Wenbo Ding

关键词:Federated learning, distributed learning, privacy leakage

15. Cross-Quality Few-Shot Transfer for Alloy Yield Strength Prediction: A New Materials Science Benchmark and A Sparsity-Oriented Optimization Framework

作者:Xuxi Chen, Tianlong Chen, Everardo Yeriel Olivares, Kate Elder, Scott McCall, Aurelien Perron, Joseph McKeown, Bhavya Kailkhura, Zhangyang Wang, Brian Gallagher

关键词:AI4Science, sparsity, bi-level optimization

16. HRBP: Hardware-friendly Regrouping towards Block-based Pruning for Sparse CNN Training

作者:Haoyu Ma, Chengming Zhang, lizhi xiang, Xiaolong Ma, Geng Yuan, Wenkai Zhang, Shiwei Liu, Tianlong Chen, Dingwen Tao, Yanzhi Wang, Zhangyang Wang, Xiaohui Xie

关键词:efficient training, sparse training, fine-grained structured sparsity, regrouping algorithm

TL;DR:本文提出了一种新颖的细粒度结构剪枝算法,它能在前向和后向传递中加速卷积神经网络的稀疏训练。

17. Piecewise-Linear Manifolds for Deep Metric Learning

作者:Shubhang Bhatnagar, Narendra Ahuja

关键词:Deep metric learning, Unsupervised representation learning

18. Sparse Activations with Correlated Weights in Cortex-Inspired Neural Networks

作者:Chanwoo Chun, Daniel Lee

关键词:Correlated weights, Biological neural network, Cortex, Neural network gaussian process, Sparse neural network, Bayesian neural network, Generalization theory, Kernel ridge regression, Deep neural network, Random neural network

19. Deep Self-expressive Learning

作者:Chen Zhao, Chun-Guang Li, Wei He, Chong You

关键词:Self-Expressive Model; Subspace Clustering; Manifold Clustering

TL;DR:我们提出了一种「白盒」深度学习模型,它建立在自表达模型的基础上,具有可解释性、鲁棒性和可扩展性,适用于流形学习和聚类。

20. Investigating the Catastrophic Forgetting in Multimodal Large Language Model Fine-Tuning

作者:Yuexiang Zhai, Shengbang Tong, Xiao Li, Mu Cai, Qing Qu, Yong Jae Lee, Yi Ma

关键词:Multimodal LLM, Supervised Fine-Tuning, Catastrophic Forgetting

TL;DR:监督微调导致多模态大型语言模型的灾难性遗忘。

21. Domain Generalization via Nuclear Norm Regularization

作者:Zhenmei Shi, Yifei Ming, Ying Fan, Frederic Sala, Yingyu Liang

关键词:Domain Generalization, Nuclear Norm, Deep Learning

TL;DR:我们提出了一种简单有效的正则化方法,该方法基于所学特征的核范数,用于领域泛化。

22. FIXED: Frustratingly Easy Domain Generalization with Mixup

作者:Wang Lu, Jindong Wang, Han Yu, Lei Huang, Xiang Zhang, Yiqiang Chen, Xing Xie

关键词:Domain generalization, Data Augmentation, Out-of-distribution generalization

23. HARD: Hyperplane ARrangement Descent

作者:Tianjiao Ding, Liangzu Peng, Rene Vidal

关键词:hyperplane clustering, subspace clustering, generalized principal component analysis

24. Decoding Micromotion in Low-dimensional Latent Spaces from StyleGAN

作者:Qiucheng Wu, Yifan Jiang, Junru Wu, Kai Wang, Eric Zhang, Humphrey Shi, Zhangyang Wang, Shiyu Chang

关键词:generative model, low-rank decomposition

TL;DR:我们的研究表明,在StyleGAN的潜在空间中,我们可以持续找到低维潜在子空间,在这些子空间中,可以为许多有意义的变化(表示为「微情绪」)重建通用的编辑方向。

25. Continual Learning with Dynamic Sparse Training: Exploring Algorithms for Effective Model Updates

作者:Murat Onur Yildirim, Elif Ceren Gok, Ghada Sokar, Decebal Constantin Mocanu, Joaquin Vanschoren

关键词:continual learning, sparse neural networks, dynamic sparse training

TL;DR:我们研究了连续学习中的动态稀疏训练。

26. Emergence of Segmentation with Minimalistic White-Box Transformers

作者:Yaodong Yu, Tianzhe Chu, Shengbang Tong, Ziyang Wu, Druv Pai, Sam Buchanan, Yi Ma

关键词:white-box transformer, emergence of segmentation properties

TL;DR:白盒transformer只需通过极简的监督训练Recipe,就能在网络的自我注意力图谱中产生细分特性。

27. Efficiently Disentangle Causal Representations

作者:Yuanpeng Li, Joel Hestness, Mohamed Elhoseiny, Liang Zhao, Kenneth Church

关键词:causal representation learning

28. Sparse Fréchet sufficient dimension reduction via nonconvex optimization

作者:Jiaying Weng, Chenlu Ke, Pei Wang

关键词:Fréchet regression; minimax concave penalty; multitask regression; sufficient dimension reduction; sufficient variable selection.

29. WS-iFSD: Weakly Supervised Incremental Few-shot Object Detection Without Forgetting

作者:Xinyu Gong, Li Yin, Juan-Manuel Perez-Rua, Zhangyang Wang, Zhicheng Yan

关键词:few-shot object detection

TL;DR:我们的iFSD框架采用元学习和弱监督类别增强技术来检测基础类别和新类别中的物体,在多个基准测试中的表现明显优于最先进的方法。

30. PC-X: Profound Clustering via Slow Exemplars

作者:Yuangang Pan, Yinghua Yao, Ivor Tsang

关键词:Deep clustering, interpretable machine learning, Optimization

TL;DR:在本文中,我们设计了一个新的端到端框架,名为「通过慢速示例进行深度聚类」(PC-X),该框架具有内在可解释性,可普遍适用于各种类型的大规模数据集。

同时还有60篇「最新亮点」轨道中的论文,大家可以前往官网自行浏览:https://cpal.cc/spotlight_track/

报名流程

那么,想要线下参与这次会议,又需要做哪些工作呢?

首先,登录大会的登记网址:https://cpal.cc/registration/

进来以后是这么个页面:

想要参会的朋友只要点击下方的Register Now的按键,就可以跳转到报名表了。

这里多说一句,上方黄框里的文字的意思是,所有想要参与第一届CPAL的人,都必须在网站上登记。在跳转的页面上(HKU官网)完成相关报名信息。

同时,有关参会费用,和其它可选项的具体细节,都在官网上有提示。

这里切记报名登记的截止日期:2023年的12月15日。

现在已经是12月初了,留给大家报名的时间还有两周不到,千万不要因为忘记填登记表而错过这次大会,那就太可惜了。

赶紧设置个备忘,提醒一下自己。

言归正传,跳转后的登记表如下所示。

部分页面

有关参会的费用,官网上也是详细地列了出来。

此外,还有一些注意事项。

这里提醒大家,官网登记报名截止到12月15日,还有不到两周,感兴趣的朋友一定要冲!

9位主讲人

Dan Alistarh

标题:Accurate model Compression at GPT scale

摘要:无论是语言还是视觉,广泛应用高精度机器学习模型的一个主要障碍是其高昂的计算和内存开销。尽管我们掌握了对此类模型进行高精度压缩的数学工具,但这些理论上高超的技术需要模型损失函数的二阶信息,而在十亿参数模型的规模上,二阶信息甚至都很难被有效近似。使用我们的技术对模型进行压缩后,数十亿甚至上万亿个参数的模型可以在几个GPU上高效执行,速度显著提高,精度损失几乎可以忽略不计。部分基于我们的工作,社区已经能够在计算能力有限的设备上运行精确的十亿甚至万亿参数模型。

SueYeon Chung

标题:Multi-level theory of neural representations:capacity of neural manifolds in biological and artificial neural networks

摘要:神经科学的一个核心目标是了解大脑中的协调计算是如何从单个神经元和神经元网络的特性中产生的。要回答这个问题,需要理论上的进步,以揭示神经回路表征的「黑箱」。在本讲座中,我们将展示有助于描述认知任务实现如何从神经群结构和生物学上可信的神经网络中产生的理论方法。

我们将介绍一种新理论,该理论将神经群反应产生的几何结构(即神经流形)与神经表征执行任务的效率联系起来。特别是,该理论描述了神经活动空间中可以表示(或「包装」)多少神经流形,而这些神经流形又能被下游读出神经元线性解码。这一理论的直觉非常简单:就像物理空间中的球形包装问题一样,如果「神经流形」很小且维度很低,我们就可以将许多「神经流形」编码到神经活动空间中,反之亦然。

接下来,我们将介绍这种方法如何在实验神经数据集和人工神经网络等一系列环境中打开分布式神经元电路的「黑盒」。特别是,我们的方法克服了传统降维技术的局限性,因为它直接对高维表征进行操作。此外,通过测量神经群体数据中的几何特性并估算同一群体中蕴含的任务信息量,该方法还能同时进行多层次分析。

最后,我们将讨论我们最近为全面扩展神经群的多层次描述所做的努力,具体包括:(1)了解任务实现神经流形是如何在不同脑区和学习过程中出现的;(2)研究神经调谐特性是如何塑造早期感官区域的表征几何形状的;(3)通过优化深度网络以最大限度地提高神经流形的容量,展示令人印象深刻的任务性能和神经预测能力。我们希望通过扩展分析复杂神经元网络表征的数学工具包,为理解任务和行为的神经元基础这一长期挑战做出贡献。

Kostas Daniilidis

标题:Parsimony through equivariance

摘要:等变表示法在各种科学和工程领域都至关重要,因为它们编码了物理和生物系统中存在的固有对称性,从而提供了一种更自然、更高效的建模方式。在机器学习和感知方面,等变表示法确保模型的输出以可预测的方式对其输入变换(如二维或三维旋转或缩放)做出响应。在本讲座中,我们将展示如何通过设计实现等差数列的系统方法,以及这种方法如何在训练数据和模型容量方面产生简约性。

Maryam Fazel

标题:Flat minima and generalization in learning: the case of low-rank matrix recovery

摘要:在深度神经网络中观察到的许多行为仍缺乏令人满意的解释;例如,过度参数化的神经网络如何避免过度拟合并泛化到未见过的数据?经验证据表明,泛化取决于训练过程中达到的零损失局部最小值。局部最小值附近的训练损失形状会影响模型的性能:损失增长缓慢的「扁平」最小值似乎具有良好的泛化效果。澄清这一现象有助于解释广义特性,而广义特性在很大程度上仍是一个谜。

在本讲座中,我们将重点讨论一类简单的过参数化非线性模型,即在低秩矩阵恢复中出现的模型。我们研究了几个关键模型:矩阵传感、相位检索、鲁棒性主成分分析、协方差矩阵估计以及具有二次激活的单隐层神经网络。我们证明,在这些模型中,平最小值(以平均曲率衡量)能在标准统计假设下精确恢复地面实况,我们还证明了矩阵补全的弱恢复能力。这些结果表明:(1)有理论依据支持偏向平坦解的迭代方法;(2)使用Hessian trace作为良好的正则。由于我们证明的景观属性与算法无关,因此未来的一个方向是将这些发现与常见训练算法的分析相结合,以更好地理解损失景观与算法隐含偏差之间的相互作用。

Tom Goldstein

标题:Statistical methods for addressing safety and security issues of generative models

摘要:本讲座将分为两部分。在第一部分中,我将从数学角度谈谈如何给生成式模型加水印以防止参数被盗,如何给生成式模型输出加水印以实现检测的目的,以及如何在不依赖水印的情况下对语言模型进行事后检测。我将强调使用统计假设检验和p值来严格控制检测的假阳性率这一重要理念。

在讲座的第二部分,我将介绍构建神经网络的方法,这些网络将表现出类似于人类逻辑推理的「慢」思维能力。这些网络不是学习简单的模式匹配规则,而是能够综合算法推理过程,解决传统人工智能系统无法解决的离散搜索和规划难题。有趣的是,这些推理系统自然而然地表现出纠错和鲁棒性特性,使它们比快速思维系统更难被破解。

Yingbin Liang

标题:In-context convergence of transformers

摘要:Transformer近来给许多机器学习的领域带来了革命性的变化,其中一个突出的发现是其非凡的上下文学习能力,即模型可以利用特定任务的提示捕捉未见任务,而无需进一步的参数微调。

在本讲座中,我将介绍我们最近的工作,旨在了解Transformer的上下文学习机制。我们的重点是通过梯度下降训练的单层Transformer的学习动态,该Transformer具有softmax attention,可在上下文中学习线性函数类。首先,我将分别介绍我们对具有平衡和不平衡特征的数据进行上下文学习的训练收敛性分析。然后,我将讨论我们获得的关于注意力模型和训练过程的见解。我还将谈谈我们开发的分析技术,这些技术可能对更广泛的问题有用。最后,我将就未来的几个方向发表评论。

Dimitris Papiliopoulos

标题:Teaching arithmetic to small language models

摘要:语言模型能否真正「理解」算术?我们利用next-token来预测目标,尝试从头开始教小型的transformer进行基本的算术运算,以此来探讨这个问题。我们首先证明,传统的训练数据(即「A+B=C」)对算术学习并不有效,而简单的格式变化可以显著提高准确性。这导致了陡然的阶段转换,在某些情况下,可以通过与低秩矩阵补全的联系来解释。然后,我们在包含中间步骤的思维链数据上训练这些小型模型。即使在完全没有预训练的情况下,这种方法也能同时显著提高准确性、样本复杂性和收敛速度。最后,我们讨论了长度泛化问题:在n位数上训练出来的模型能否添加n+1位数的数字?人类不需要学习加法的每一位数字长度就能完成加法。事实证明,语言模型并不擅长长度泛化,但在「不稳定」的情况下,我们可以窥见一斑。令人惊讶的是,让人讨厌的U型过拟合曲线出现了!

Stefano Soatto

标题:Representation and control of meanings in large language models and multimodal foundation models

摘要:尽管大型语言模型和多模态基础模型的预测学习标准很简单,也没有明确的复杂性偏差,但它们已经显示出捕捉数据结构和「意义」的能力。我将介绍大型语言模型的「意义」概念,即句子的等价类,并介绍在意义空间中建立几何和拓扑的方法,以及建立代数的方法,这样就可以组成意义,并量化蕴含和暗示等非对称关系。对于预先训练好的模型,可以定义、计算和量化由训练好的嵌入决定的句子等价类意义,而无需进行指令调整、强化学习或提示工程。作为轨迹的意义可以通过人工标注的基准来证明与人类的评估相一致,并且作为动态系统的输出,可以对其进行控制。我将展示一些使用文本和图像模式的示例。

Jong Chul Ye

标题:Scaling diffusion model for inverse problems beyond 2d and known forward models

摘要:扩散模型具有众多优点,已成为图像生成和重建的常用方法。然而,大多数基于扩散的逆问题解决方法只能处理二维图像,即使是最近发布的三维方法也没有充分利用三维分布先验。此外,大多数方法都假定有已知的前向模型,而许多逆问题都涉及盲重建,事先并不了解前向模型。为了解决这个问题,我们提出了一种新方法,使用两个垂直的预训练二维扩散模型来解决三维逆问题,并使用盲扩散模型。实验结果表明,我们的方法对磁共振成像Z轴超分辨、压缩传感磁共振成像和稀疏视图CT的盲解卷非常有效。

参考资料:

https://cpal.cc/返回搜狐,查看更多

责任编辑:

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!