文章主题:人工智能, 监管, 安全, 合作

图片来源@视觉中国

文 | 适道

在大众认知中,人工智能未来可能会对人类构成威胁,类似于科幻电影《终结者》的描绘。然而,具体何时会发生这一情况,无人能预测。或许它会在100年后出现,或者50年后降临,甚至可能在短短的10年后就会与我们相伴。

在AI威胁日益严重的背景下,全球各国政府已积极采取应对措施。为了共商人工智能安全策略,的首届全球人工智能安全峰会于去年11月1日在英国布莱切利庄园正式开幕。来自中国、美国、英国、欧盟等超过25个国家的代表,以及马斯克的SpaceX等科技巨头均参与了此次会议。

首次人工智能峰会成功召开,各国代表共同签署《布莱切利宣言》,承诺跨国合作制定人工智能监管策略。

事实上,这次监管峰会的酝酿早已露出端倪。今年5月,全球多位专家共同撰写了一份强调“关注人工智能发展及监管”的通信函件,倡议全球AI实验室立即暂停训练6个月,甚至确保在接下来的6个月内不再开发比GPT-4更为强大的AI模型。今年6月,2023北京智源大会上,众多知名专家,如Yann LeCun和Sam Altman等,针对AI安全问题进行了深入探讨,持续了一整天的会议。

那么《布莱切利宣言》到底说了什么?具体来看,它提出了一个双管齐下的议程:

在面对人工智能的安全风险时,我们需要首先识别这些共同的威胁,并建立一个科学的、基于循证的理解体系。随着我们在这一领域的技能不断提升,我们应努力在全球范围内达成共识,以便深入探讨人工智能对我们社会产生的影响。

在考虑到各种风险的基础上,各国需制定相应的政策来确保安全,并在必要时展开合作。与此同时,我们应认识到,所采用的方法可能会因各国国情以及适用的法律框架的不同而有所差异。

在提升开发前沿人工智能能力的私人行为主体透明度的基础上,我们还需要实施公正的评估标准、安全的测试工具,以及推动相关公共部门的能力建设和科学研究。

重点总结为:各国确定要共同关注AI可能造成的风险,并建立对这些风险的科学理解,同时制定减轻这些风险的跨国政策。

值得关注的是,《布莱切利宣言》这一重要文件,在中、英、美等“跨大洋国家”之间,尤其是在近年来全球战略对抗的大背景下,较为罕见地达成了共识。

在当前的形势下,我们可以明显观察到,AI安全问题的重要性以及紧迫性已经达到了一个全新的高度。这使得各国在国际竞争中不得不暂时放下争端,以平和的态度坐下来,寻找关于AI安全合作的可能性。这种转变从侧面反映出AI安全问题的严重性,也预示着我们需要更加积极、合作的方式来应对这一挑战。

可以说,对AI问题的讨论已经成为了类似气候变化、核扩散等影响人类共同命运的重大课题。

01 AI监管是一场阴谋论?LeCun、Andrew Ng向Hinton开火

那么,在“AI安全与监管“的battle中,最近行业大佬们又有哪些新说法?

先来看看大公司代表的最新说法。

第一位Sam Altman。大家都知道他是OpenAI的创始人,但可能很少人知道Altman和奥本海默是同一天生日。

11月2日,Altman在英国剑桥参加活动时,被反AI活动的激进分子在大礼堂里当面被“砸场子”。

显然,此刻的Altman很淡定,没有变身Real奥特曼。

随后Altman在演讲中表示,即便未来AI模型足够强大,也需要有巨大的算力才能运行。如果提高了算力门槛,能够降低蓄意犯罪风险,也能提高问责性。

不过,Altman一直都是AI威胁论的支持者,他曾强调:监管机构和社会需要参与这项技术,以防止对人类可能产生的负面影响。此外,在今年5月,那份“警告AI或给人类带来‘灭绝风险’ ” 的公开信上,Altman也签了自己的大名。

为什么Altman会在剑桥的“改口”,不得不怀疑这是他担心被“揍”采取的迂回战术。

第二位AI威胁论的支持者是马斯克。他曾多次警告,AI比核武器更危险。

11月2日,马斯克在AI安全峰会期间表示:AI是人类最大威胁之一,而且AI将会成为历史上最具颠覆性的力量,并将比人类更加聪明。

随后,在和英国首相苏纳克长达40分钟的对谈中。苏纳克向马斯克表达了对AI抢走人们工作的担忧。而马斯克则描绘了一种理想化的状态:AI不会“抢走”人类的工作,因为到了一定的阶段,人类将不再需要任何工作。

对于监管,马斯克表示,“监管确实会让人讨厌。……但我认为,多年来我们已经意识到,有裁判是件好事”。而事实上,今年9月,马斯克等美国科技巨头公司高管与美国国会举行闭门会议,马斯克提出,希望为AI设立一个“裁判员”。他当时称,各方对监管AI已达成“一致性共识”。

另外,在今年5月,马斯克也签署了上文那份“警告AI或给人类带来‘灭绝风险’ ” 的公开信。

不过,“阴谋论”无处不在,也有人认为,马斯克签名是为了给自己的AI公司发展争取时间。

马斯克于2015年与他人共同创立了OpenAI,但几年后因在AI安全问题上发生冲突而离开。今年7月,他成立了自己的人工智能公司xAI。就在11月4日,xAI发布公告称,正式推出Grok大语言模型。马斯克还顺便在推特上拉踩了一下GPT:“ 与典型GPT的相比,Grok具有当前信息,但GPT等其他的则没有。”

再来回顾一下近期“图灵奖”得主的瓜,参战方包含:Geoffrey Hinton、Yann LeCun 、Andrew Ng、Yoshua Bengio。

Hinton和Bengio观点基本一致,他们认为要加强对AI的监管。

有一个小故事,Hinton用完GPT-4后觉得很震惊,他觉得虽然推理是人类的强项,但GPT-4完成了他认为不可能完成的常识性推理,智商大概是80或90左右,因此Hinton觉得AI更加可怕。

LeCun的观点则不尽相同,他始终认为AI的发展远未构成对人类的威胁,并提出了那句“没有车造什么刹车”的经典比喻。

最近的混战始于10月30日,起源是当日美国总统拜登签署了一项针对AI的新的行政命令,这是针对AI安全标准方向采取有史以来最全面的行动。但新的行政命令却加强了对AI巨头公司的支持力度,如通过研究资金和其他手段支持AI研究、吸引外国人才等等。

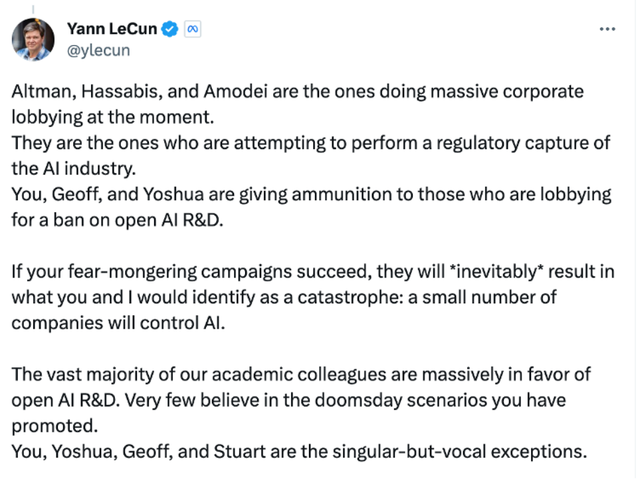

于是,LeCun马上在推特上开火,他认为:如果一些人(Hinton 和 Bengio 等人)的恐惧宣传活动取得成功,将不可避免地造成灾难性的结果:少数公司将控制 AI。

Andrew Ng很快力挺LeCun ,他写道:我对AI的未来最大的担忧是,过度夸大风险(例如人类灭绝)可能会促成人们制定压制开源和压制创新的规定。

当一些来自大公司的游说者让法规制定者认为AI是非常危险的,从而制定出一些导致开源社区AI研究进展缓慢的法规,这会导致小型初创公司遭遇创新瓶颈,最后的获利者可能就是一些巨头。

Hinton迅速反击:如果AI不受到严格监管,它在未来30年内灭绝人类的概率是多少?

LeCun则反问:AI实际上可能会拯救人类免于灭绝,你估计这个概率是多少?

不过,“阴谋论”确实让Hinton破防了,他很快发了一条推特自证:我从谷歌离职就是对“阴谋论”观点最好的反驳。

结果就是,Bengio、Hinton 等人发联名信《在快速发展的时代管理人工智能风险》,呼吁在开发AI系统之前,研究者应该采取紧急治理措施。

与此同时,一封名为《人工智能安全和开放的联合声明》的公开信正在社交媒体发酵。这封信在结尾表明:在人工智能安全方面,开放是解药,而不是毒药。截至目前,LeCun、Andrew Ng等370多人已经在这封公开信上签名。

有趣的是,今年10月22日,LeCun还晒出了他和Hinton、Bengio的合照,不知道此次battle会不会影响三大巨头的友谊,我们可以继续吃瓜。

02 国内观点:AI监管要在发展中解决问题

总体来说,“AI威胁论”分为两派:

赞成AI威胁论:代表人物为Geoffrey Hinton,马斯克

反对鼓吹AI威胁论:代表人物为Yann LeCun,吴恩达

那么在“AI威胁论”方面,国内行业内专家有哪些精华观点?

根据腾讯科技和赋雅FOYA联名出品的创投圈首档辩论节目《创投变辨辩》第一季第四期中所展现,赞成AI威胁论的“威胁派”代表是黄民烈指导下的清华大学CoAI课题组,而反对鼓吹AI威胁论的“乐观派”代表则是IDEA研究院、封神榜大模型开源团队负责人甘如饴。他们的观点具体有以下三点:

1、AI是否具备“犯罪能力”?

“威胁派”认为:AI发展到现在,已经展示出了一定的自主性,优化速度之快远超想象,AI做决策的依据,是基于开发技术和数据,而不是人类社会的道德伦理原则,AI 容易“三观不正”。

“乐观派”认为:AI还没有展现出真正的自主学习能力,要先给AI喂数据,它才能学习。此外,基于深度学习的AI还没有达到能够进行交互式学习,也没有进化出更高级智能水平的程度。

2、AI是否会产生“犯罪动机”?

“威胁派”认为:虽然AI的动机是由开发者赋予的,但在实现人类目的的过程中,AI会抛弃道德标准。

“乐观派”认为:人类作为开发者,可以对动机进行一个最基本的规范。

3、人类是否要限制AI的应用?

“威胁派”认为:在进一步推进AI的应用层面的发展之前,必须把研究的重点放到真正“理解”AI上来,在此之前,应该限制AI的大规模的应用和实验。

“乐观派”认为:没有必要对AI的应用和实验进行特别的限制,但可以对AI的物质基础,也就是算力和能源等“物理”资源控制来应对风险。

不过总体而言,在这场辩论中,正反双方的主要分歧点在于时间维度,即正方更多是从长期的角度出发,而反方则更多从短期的角度出发。

最后,在主持人英诺天使基金合伙人王晟的看来,他认为“当然要监管”,但诸如“停工6个月提议”的“一刀切”,既不现实也不合理。AI监管要在发展中解决问题,摸着石头过河。借用此前的LeCun比喻,“边造车,边造安全带”。

03 从应用场景出发,AI治理良方看中国

总而言之,关于“AI安全与监管”的争论无休无止。因为思维模式的不同,夹杂利益立场的纠葛,从目前来看,谁都说服不了谁。

那么,我们从解决现实问题的角度来看,在AI监管方面,目前有没有治理良方?

美国《外交政策》杂志网站一篇文章指出:比起美国试图将所有问题解决方案打包塞进一项立法的天方夜谭,中国是找出AI最具隐患的代表性应用场景,并制定一系列法规来逐个破解,与时俱进持续更新政策,丰富对症下药的监管措施。一旦早期的规定不足以应对人工智能技术的快速发展时,国家也可以迅速对修订这些法规。

文章作者Matt Sheehan认为,中国在人工智能领域建立了较为完善的法律法规,监管措施领先全球,美国政府应当向中国学习,借鉴中国的AI监管经验。

或许,借鉴与合作是各国实现AI治理的大方向。

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!