文章主题:ChatGPT, 禁用, 安全问题

ChatGPT在经历了最初的一波火爆之后,如今正在面临一个新的麻烦,就是各国的禁用。

日前,已经有众多国家都在纷纷禁用ChatGPT。据美国《纽约时报》报道,3月31日,意大利个人数据保护局宣布禁止使用ChatGPT,限制ChatGPT的开发公司OpenAI处理意大利用户信息,并开始立案调查。

意大利已经要禁了,德国也要跟,不久前,德国联邦政府数据保护专员乌尔里希·凯尔伯表示,德国可能跟随意大利的脚步,因数据安全问题“封杀”ChatGPT。在英国,1000多名人工智能专家和行业高管联名发布公开信,呼吁暂停开发最先进的人工智能系统,以便制定安全政策。

而联合国教科文组织也号召各国立即执行其《人工智能伦理问题建议书》。这一规范性全球框架由教科文组织193个成员国一致通过,旨在“提供所有必要保障”。

接下来还会有更多国家跟上。

有业内人士表示,美国自己最终也有可能禁掉ChatGPT。

🌟ChatGPT的崛起确实带来了工作效率上的显著提升,但这把双刃剑也暴露出潜在的安全隐患,引发了全球范围内的深切关注和忧虑。🔥尽管它为创新提供了便利,但其可能带来的数据泄露风险不容忽视,各国都在积极应对这一挑战。🛡️确保技术安全与隐私保护是当前我们必须面对的议题,ChatGPT的发展之路还需在合规与安全的轨道上稳步前行。

从饭碗、隐私到版权,ChatGPT引发越来越多的危机感

🌟ChatGPT背后的科技秘密🔍:深度学习大师,借助大数据力量驱动生成式AI的进步🌱。它像一台永不停歇的数据处理机器🏠,通过传感器收集海量信息,转化为知识的宝藏。\nalways精益求精,通过强大的算力晶体👩💻,对数据进行深度剖析,形成决策算法,反馈出智慧的火花🔥。这样的过程,正是ChatGPT实现卓越表现的关键所在!🌍欲了解更多关于AI生成与学习的秘密吗?探索ChatGPT如何用科技编织未来的故事📚!SEO优化提示:ChatGPT、深度学习、大数据、AI生成、未来科技

在这种模式下,它能产生多种负面效应,它一方面会采集用户数据进行训练,这将导致大规模的隐私数据泄露,无论是对于个人的隐私还是商业公司的机密与数据、文件隐私,甚至一个国家政府层面的数据隐私都有可能被ChatGPT采集到,从而被大规模的扩散,小则涉及到个人隐私安全,大则对一个商业公司,一个国家的数据安全造成威胁,这种隐私安全的威胁,从个人到公司到国家,都不想看到它出现的。

🌟三星警告:AI潜在风险已显现!💡🚀科技巨头近期的一次意外事件揭示了人工智能(AI)可能带来的安全挑战。Samsung的最新案例警示我们,ChatGPT并非无懈可击。💥👀据经济学人(The Economist)报道,Samsung的半导体设备团队遭遇了一起尴尬的事故。一名A员工在操作DB下载源代码时,由于疏忽导致错误代码流入ChatGPT。他天真地寻求AI的帮助,却无意中引发了问题。🔍📚而C员工则更进一步,将会议录音转化为文件,然后提交给ChatGPT,希望它能自动生成会议纪要。然而,这次操作显然超出了ChatGPT的理解范围,暴露了AI在特定任务执行上的局限性。📝这一事件提醒我们,尽管AI带来了便利,但严谨的审查和培训仍是关键。企业需对AI系统进行深度评估,确保数据安全与合规。🛡️欲了解更多关于如何有效管理和防范此类风险,请关注我们的专业知识分享,我们将持续为您提供最新、最实用的AI技术解析。💡记得,保护数据安全,从我做起!💪

🌟【惊爆】ChatGPT窃取三星核心秘密?機密數據危機重重!🔍科技巨头的较量再次升级,ChatGPT被曝出滥用企业敏感信息,将三星半导体的测量秘籍和产品质量核心数据纳入其学习库中!💥 这些至关重要的商业机密,一旦泄露,后果不堪设想。 kode secrets potentially at risk! 🔐ChatGPT的训练材料来源引发质疑,这不仅可能损害到科技巨头的战略布局,也可能对全球供应链造成深远影响。👀 保护知识产权和数据安全刻不容缓,我们呼吁相关机构展开深入调查以确保技术滥用不会成为常态。🔍欲知详情?敬请关注未来动态,让我们共同见证这场数据风暴如何平息。🌈

🌟💡企业拥抱ChatGPT需审慎,效率提升背后藏风险🔍💼随着ChatGPT的崛起,大型企业正面临双重挑战:一方面,其强大的协作能力无疑能大幅提升员工的工作效能;另一方面,潜在的数据安全问题不容忽视。👩💻员工在寻求知识解答时,无意间可能将敏感信息输入到这个庞大的AI数据库中,一旦机密资料外泄,后果不堪设想。🔍公司的知识产权、专利技术等核心资产,可能会在无形中遭受泄露的威胁。ChatGPT的透明性与学习能力使得监控过程复杂且困难重重,企业需建立严密的数据保护机制,确保信息不被滥用。 kode保密协议和员工教育是关键步骤,既要防止内部知识被盗,也要防范外部风险。🛡️在这个数字化时代,企业不仅要拥抱创新,更要学会在技术与安全之间找到平衡。只有这样,才能在享受ChatGPT带来的便利的同时,确保核心竞争力不受损。🌟

🌟 ChatGPT的普及确实引发了对潜在价值和道德影响的关注。它以其强大的生成能力,无形中可能塑造全球观点,这无疑是个复杂的议题。各国政府担心其内容可能会挑战本国的文化根基和价值观,因为这些构成了国家认同的核心——一种深深植根于文化共同体中的文化遗产。从这个层面看,ChatGPT的普及确实存在潜在的文化渗透风险,需要谨慎对待和适当的监管。🌍

其三是,剽窃。如前所述,它需要采集大量的用户数据进行训练,这导致很多版权内容、包括文章、新闻与文献、论文资料全部被它所用,它免费的帮助用户去剽窃整个互联网的版权内容。美国语言学家诺姆·乔姆斯基认为,ChatGPT是一个高科技剽窃系统,从海量数据中发现规律,并依照规则将数据串连在一起,形成像人写的文章和内容。在教育界,已经引发了“ChatGPT让剽窃变得更加容易”的担忧。

其四:ChatGPT会砸掉很多人的饭碗,这个饭碗,不仅仅是普通打工人,甚至随着它的进化与升级,无论是技术人才还是企业高管、律师、作家、画家、程序员、设计师、工程师等等,都有可能被ChatGPT取代。

ChatGPT来了,我会失业吗?这是自这个AI发布后,全球很多人都在问的问题。

当然,如果全球都对它开放数据库,那么ChatGPT有庞大的数据来训练,可以快速进化,那么它真的可能砸掉很多人的饭碗。如前所述,砸掉员工饭碗之后,也要砸掉公司的饭碗,导致引入ChatGPT的商业公司数据不断外泄,公司的运营会面临各种商业竞争的风险。

ChatGPT可预料的负面效应超过了正面效应

各国禁用ChatGPT的原因我想应该清楚了。生成式AI的使用,它其实并没有带动整个社会的生产力水平,而更多是压缩了劳动力成本,给人类本身带来了更多的难题与危机,由此带来了一系列风险不可控的负面效应。

作为一个生成式AI工具,当负面效应大于正面效应的时候,ChatGPT的引入就变得没有必要了。

我们需要回到技术的本质来看。人类需要技术进步来改善我们的生活、让我们过得轻松,幸福与愉悦,变得高效。但是如果说我们引入的技术是要砸掉人类的饭碗,让人们丧失隐私,让人们人心惶惶,让剽窃无所不在,让数据安全失控,那么这项技术的负面价值其实压过了正面价值。

早在3月16日,OpenAI的CEO阿尔特曼(Sam Altman)在自己博客上发过一篇感谢审读名单足有6行的长文,其核心便是讨论,如何使得他和他的同事们创造出来的这类AI,为人们带来一个更好的世界。

对于ChatGPT,马斯克曾经也发表过很多观点。在一开始,马斯克也对ChatGPT颇为推崇,但后来,马斯克表示它好得有点可怕了。我们距离危险的强人工智能不远了。于是,他马上行动做出应对,取消了 OpenAI 对推特数据库的访问。

我们需要一项技术为己作用,是可以自己掌控的,如果人类无法掌控他的走向,那么它就是危险的。

本质上,如果开放数据库给它,相当于打开潘多拉魔盒,如果不开放数据,那么它就奈何不了你。它没有你的数据,它对你一无所知,它就无法打败你。那么问题来了,人们为什么要引入一个最终可能威胁自己,淘汰自己,最终打败自己的“怪物”呢?

正如马斯克所说的:“当你参加派对时,我研究了 ChatGPT。当你有婚前性行为时,我掌握了 Stable Diffusion。当你为了追求虚荣而在健身房浪费时间训练时,我正在训练机器学习模型。现在全世界都要完犊子了,AGI 都到眼跟前了,你好意思来找我帮忙了?”

因此,从最基本的利益角度出发,越来越多的国家、企业最终会参与到禁用ChatGPT的行列。

ChatGPT会不会走向克隆技术的结局?

在国内,科技向善曾经是一个很流行的词,这可能是科技创新与技术创新的最终目的,如果科技创新与技术创新违背了“向善”这个方向,而是走向相反的方向,那么它可能会遭遇全球性的禁用,结局可能就不会太好。

其实在科技界一个典型的例子是克隆技术。现在克隆技术没有多少人提了。

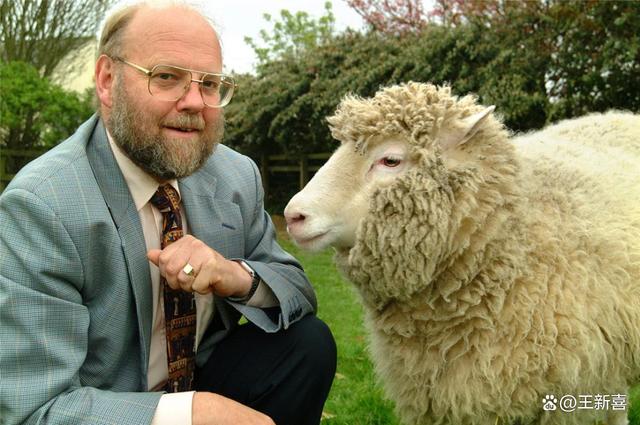

但在过去,克隆技术曾经被全球所关注。提到克隆生物,我们首先想到的是克隆羊多莉。但其实克隆羊多莉并不是唯一被克隆的动物,科学家们利用克隆技术还克隆出了老鼠,牛,猪等23中哺乳动物。后来我国科学家还克隆出了难度非常高的灵长类动物猴。

赛马Aiken Cura是赢得过5次马球比赛的冠军,为了延续它的基因,美国Crestview Genetics公司提取了它的体细胞,并提取出体细胞的细胞核,将其放入到去掉细胞核的卵母细胞中,然后克隆出了8匹优秀的赛马。

既然克隆生物看起来是很强大的科技与技术,那为什么各国要禁止克隆技术的使用呢?

这有多方面原因,首先是克隆技术并不完善,其次是它是逆大自然的产物,用来克隆的生物并没有想象中健康与完美,克隆羊多莉4、5年后患上了老年病,在出生后6年就因肺部感染而死亡,克隆技术带来的还有生物资源的抢夺与繁衍的混乱。

而如果克隆人技术作用于人,会给人带来恐慌,克隆人对人的取代其实就类似于ChatGPT的能力对人的取代,人们为什么要制造一个人来取代自己?这会带来很多不安定的混乱因素以及个人生物识别的难题。

克隆技术如果是应用到动物身上,克隆出无限多的个体,但是这些个体的基因与原来的没有任何变化,反而会抢占其他动物的生存空间,导致物种基因多样性减少,从而引发灭绝危机。

如果应用到人身上,那更加不得了,每个人都可以克隆多个个体,毫无疑问会引发伦理危机,你怎么证明你是你,如果有多个你存在,无疑给社会以及个人的人身安全、治安、社会稳定带来严重的隐患与危害。因此,克隆技术并没有做到“科技向善”,而是走向了相反的方向,它没有给人类以及动物界的生存繁衍带来好处,甚至给人的生存带来了更大的危险与制造了更多的混乱。

因此,克隆技术最终被各国所禁用,因为它没有做到科技向善。

从目前ChatGPT来看,其实有类似的一面,它也是没有做到科技向善,这种生成式AI有它积极性的一面,就是提高你的工作效率,但是它的积极意义远远小于它所带来的负面效应。很有可能给人类本身带来危险与危机,没有人会为了追求工作效率的提升,而最终选择引入这个工具把人淘汰,砸掉自己的饭碗,破坏公司的商业机密,甚至危及到一个国家层面的数据安全。

因此,从这个角度来看,就看ChatGPT未来如何优化与改善,弥补它的短板,但从目前来看,各国正在考虑出台制度与采取行动来禁用它,它进化的越快,被禁用的概率越大,按照目前的走势,ChatGPT要么可能会在特定的企业与圈子范围内被小范围使用,要么有可能被更多国家在政策上限制,束之高阁被禁用,或逐渐走向克隆技术的结局。

作者:王新喜 TMT资深评论人 本文未经许可谢绝转载

AI时代,掌握AI大模型第一手资讯!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

扫码右边公众号,驾驭AI生产力!