文章标签:二、少样本训练;ChatGPT;句式格式;稳定性

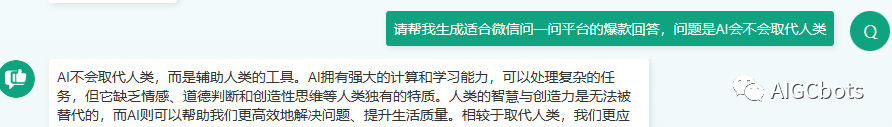

今天让AI帮助写诗,同时通过这个案例教大家两个非常重要的GPT使用技巧:

1. 信息确认,减少误差

2. 少样本训练,投喂优质案例,提升回答质量

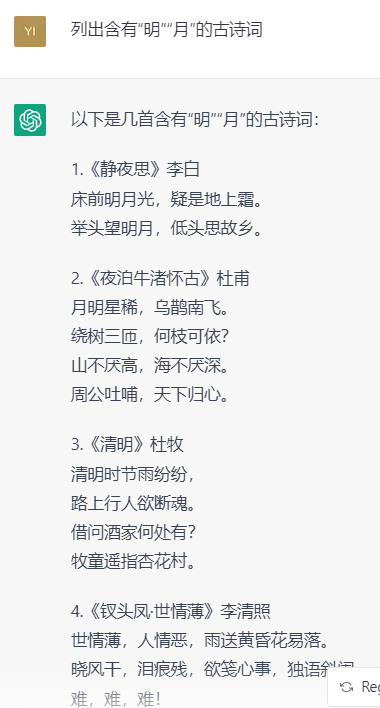

一、信息确认,减少误差在使用ChatGPT时,我们要注意到它的训练数据是截至2021年9月的,并且中文语料库相对较少。因此,有些概念和问题ChatGPT可能并不了解。如果ChatGPT不了解您的问题,它很可能会胡编乱造,因为它不理解您的需求。举个例子,我让ChatGPT写一首七言绝句,但它没能写出来,显然它并不了解七言绝句是什么。

不过生成的格式可能还不太对,这时可以多次调教,直到ChatGPT生成正确的格式内容。

二、少样本训练

即使进行了信息确认,ChatGPT还是有可能会出错,因此我们可以采用少样本训练的方法。这种方法只需要少量的样本就可以让模型学习到某种特定的知识。 刚才的问题在于,ChatGPT对于七言绝句的格式输出非常不稳定。所以我们可以提供一些七言绝句的诗句作为训练样本,让ChatGPT学习七言绝句的格式。训练完后,再让ChatGPT生成类似的诗句。这种方法的优点是,我们不需要大量的数据,只需要一些具有代表性的样本,就可以让ChatGPT学习到我们想要的知识。

刚才的问题在于,ChatGPT对于七言绝句的格式输出非常不稳定。所以我们可以提供一些七言绝句的诗句作为训练样本,让ChatGPT学习七言绝句的格式。训练完后,再让ChatGPT生成类似的诗句。这种方法的优点是,我们不需要大量的数据,只需要一些具有代表性的样本,就可以让ChatGPT学习到我们想要的知识。

我测试了4、5遍后,发现ChatGPT的句式格式已经非常稳定了。

我们可以投喂一些优质的示例给ChatGPT,让它学习。投喂的内容质量越高,ChatGPT生成的内容质量就会越高。通过这样的训练,我们的AI李白诗仙就诞生了。它可以生成类似李白的诗句,让我们感受到古诗的魅力。经过确认,我们可以确保ChatGPT在信息上保持透明,减少信息误差和歧义,以提升回答的质量。通过进行少样本训练,我们可以让ChatGPT迅速学习优秀的示例,从而产生更高质量的内容。然而,这要建立在您提供的内容足够优质的前提之上。希望这个案例能够帮助大家更深入地理解这两个ChatGPT使用技巧!玩转AI智能,让AI提速增效

防止迷路,一定要关注公众号

点 击 下 方 名 片

? 立 即 体 验?

二、少样本训练;ChatGPT;句式格式;稳定性

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。