文章标签:数学能力, GSM8k数据集, WizardMath, AI生成的指令

用AI生成的指令微调羊驼大模型,数学能力超ChatGPT——

微软最新开源大模型WizardMath来了。

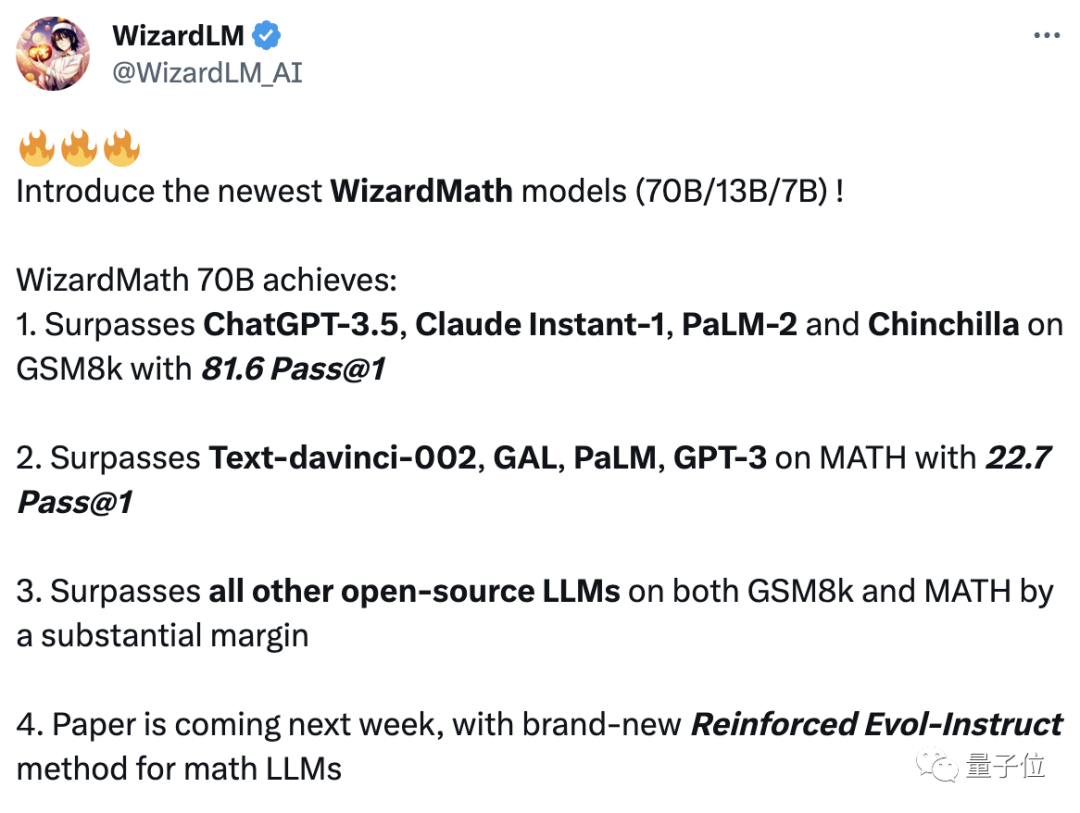

在GSM8k数据集的测试中,WizardMath数学能力的表现超越了诸如ChatGPT、Claude Instant 1、PaLM 2-540B等一系列强大的模型。

并且是在参数只有700亿,远不及后三者的情况之下。

HuggingFace已上线3个在线可玩版本(分别为7B、13B和70B参数),各种数学题可以直接丢进去试一试。

比如解决下面这道四次多项式方程:

或者是一道简单的微积分:

亦或者是稍微修改过的拉格朗日方程推导:

它都全部正确(过程也不需要等太久)。

有网友向作者表示:

效果真的很惊人,感谢你们对开源LLM的贡献。

目前,相关代码、复现方式以及论文也都开源或上线,GitHub短短几天已揽获4.8k标星。

那么,WizardMath究竟是如何做到的?

用AI生成的指令增强大模型能力

OpenAI的大模型如InstructGPT和GPT-4之所以能够取得巨大成功并应对各种复杂和多元化的任务,其中一部分原因归功于它们接受了由真实的人类用户生成的开放域指令数据进行的微调。这种方法使得这些大模型得以更好地理解和执行各种任务,从而在各个领域取得了显著的成果。

然而,不是谁都能像这家公司一样获得这样的指令数据集。

一是因为整个注释过程极其昂贵且耗时,二是人工难以创建出足够比例的高难度指令。

因此,开发出一种成本相对较低的、大规模开放域指令自动生产方法,成为当下指令调优语言模型的关键。

在此,作者将他们的方法命名为Evol Instruction。

它是一种利用AI来代替人类自动生成涵盖各种难度级别开放域指令的新方法。

具体而言,Evol Instruction分为指令进化器和指令消除器。

指令进化器具备两种途径来提升指令的复杂程度,一是通过深度进化(蓝线)途径,二是通过广度进化(红线)。这两种方法都可以将简单的指令升级为较为复杂的指令,甚至能够生成全新的指令。

具体执行哪一条?随机选择就好。

其中,深度进化的具体“进化法”,则是通过五种类型的操作来完成,包括:

在撰写高质量的文章时,我们需注意以下五个方面以提高文章的专业性和深度。首先,我们需要添加适当的约束,以确保文章的结构和内容符合要求和标准。其次,为了增强文章的逻辑性和说服力,我们需要对其进行深化,深入挖掘主题的核心观点和论据。此外,为了使文章更具說服力,我们需要具体化抽象的概念和理论,通过生动的实例和数据来阐述。同时,增加推理步骤有助于展示我们的思考过程和分析能力,从而使文章更具说服力。最后,使输入复杂化意味着我们在文章中要引入各种类型的信息和观点,以丰富文章的内容和结构。总之,遵循这些原则将有助于我们撰写出高质量、有深度的文章。

由于所有指令均由AI完成,有时难免会出现错误。因此,指令消除器就是用于过滤失败指令的。

以下是一个具体示例,该方法从“1 1=?”开始,最终通过以上步骤自动生成了相当多的新指令。

通过重复这一生成过程,最终我们就能得到足够多的指令,然后将它们合并并随机打乱,组成一个难度级别均匀分布的指令集,就可以对基础大模型进行微调了。

在本研究中,作者选择了Alpaca的训练数据作为初始数据集,该数据集仅包含由175个人 manually 创建的种子指令。接着,作者利用 ChatGPT 的 API 进行了四个进化周期的运行,最终成功地生成了250,000 条指令。

为确保与Vicuna的70k真实用户数据(ShareGPT)展开公平竞争,作者从25万条数据中随机选取了等量样本,用于训练LLaMA 7B模型。经过优化,所得到的WizardLM在性能上显著超越了Vicuna。

Alpaca 和 Vicuna 是两种不同的语言模型,分别基于 LLaMa-7B 和 LLaMa-13B 进行了微调。斯坦福大学的研究团队在 Alpaca 模型的基础上进行了进一步的优化和改进,而 UC 伯克利则在 Vicuna 模型的基础上展开了类似的微调工作。这两种模型的改进都基于原始的 LLaMa-7B 和 LLaMa-13B 模型,通过针对特定领域的数据进行训练,提高了其性能和应用价值。

在实施更为严苛的测试指令时,人类更倾向于依赖WizardLM的输出结果,而不是ChatGPT,这一现象揭示了这种方法在显著提升LLM处理复杂指令上的能力。

基于此,作者又利用Evol Instruction生成了很多数学领域相关的指令,然后微调羊驼大模型,得到了WizardMath。

其效果如开头所示,在GSM8k数据集上测得其数学能力超越包括ChatGPT、Claude Instant 1、PaLM 2-540B等一众大模型,位列第5名,仅次于GPT-4、Claud1.3和2.0,以及5400亿参数的Flan-PaLM 2之后。

以此类推,作者还在羊驼之上得到了专攻代码能力的WizardCoder,效果超越Claude和Bard(详情可戳文末地址)。

团队介绍

本文共9位作者,全华人。

一作有3位:

Can Xu,微软亚洲互联网工程院S D NLP组高级应用科学家,之前曾在微软小冰研究组和微软亚研院从事聊天机器人系统工作;

Qingfeng Sun, Microsoft Research科学家,研究方向为自然语言处理和信息检索,精通构建高效搜索系统,为Microsoft Bing和Office 365贡献了核心深度模型;

Kai Zheng,Microsoft Research科学家,研究方向为自然语言处理、搜索和推荐排名,同样为Microsoft Bing和Office 365贡献了核心深度模型。

通讯作者为姜大昕,微软全球合伙人、副总裁、前微软亚洲研究院首席科学家,在微软工作16年有余、曾作为微软必应搜索引擎和Cortana智能助手自然语言理解负责人,日前已被曝离职投身大模型创业。

另还有一位作者Jiazhan Feng,是北大学生,这篇合著论文是TA在微软实习时产出的。

数学能力, GSM8k数据集, WizardMath, AI生成的指令