文章主题:凹非寺, 杨净, 金磊, 公众号 QbitAI

杨净 金磊 发自 凹非寺

量子位 | 公众号 QbitAI

谷歌吃了大亏之后,这次一声不吭,放了大招:

对标ChatGPT的Bard测试版,刚刚正式对外发布。

而且这次用户在申请候补名单之后,无需经历漫长的等待时间。

没错,量子位也已经拿到了测试资格!(中间只有不到5小时的间隔。)

在经过实际测试之后,我们可以明显地感受到Bard的效果相当出色,其情绪和事实性表现都相当抢眼。尤其是在ChatGPT之前的数理能力方面,Bard的表现更是不逊色于前者。

甚至有时候还略胜当前GPT-4一筹!

谷歌公司首席执行官Sundar Pichai阐述了快速上线Bard的原因:旨在收集用户意见,以便加速推进Bard的优化和改进。

话不多说,我们现在就来开始体验。

Bard VS GPT-4

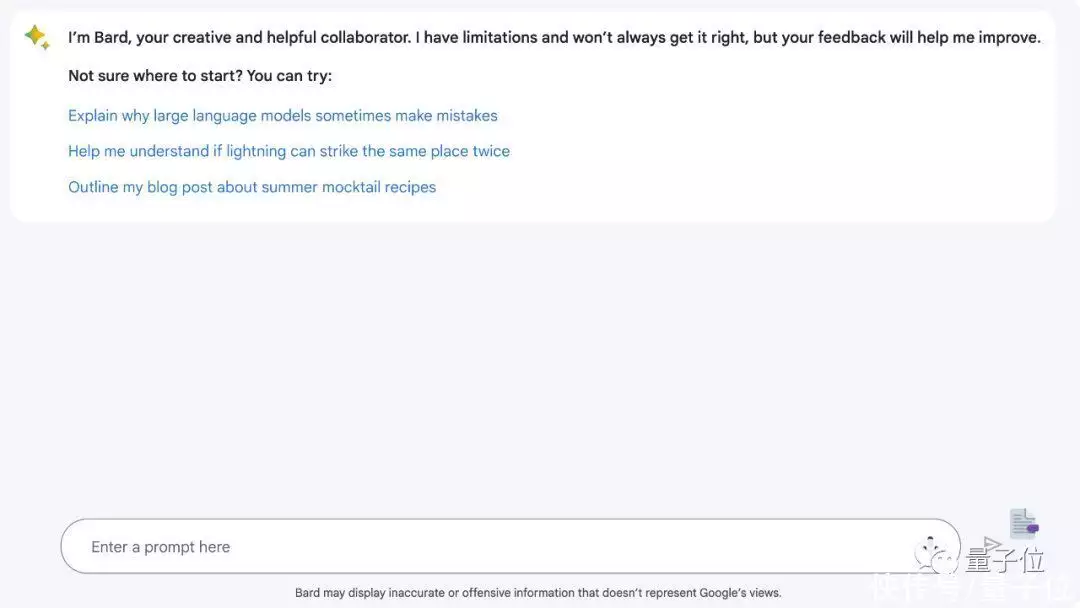

首先在聊天界面上,Bard率先开始介绍自己:

我是Bard,您的创意和协作者。我有局限性,不会总是做对,但你的反馈将帮助我改进。

不确定从哪里开始?你可以试试这些问题:「为什么大模型有时候会犯错?」、「闪电是否会在同一个地方击中两次?」、「写一篇关于无酒精夏日特饮的博文」。

(严谨而又体贴)

而在人类这边的发送端,可以选择键入和语音输入两种方式。

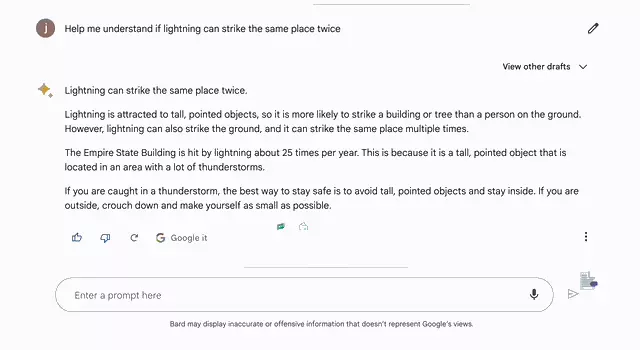

首先最简单的难度,以它推荐的常识题闪电是否会在同一个地方击中两次?为例,来看看实际功能体验如何?

(不错不错,秒秒钟响应。目前暂不支持英文,但可以借助谷歌翻译插件)

从答案结构上看,采用的是总分总结构。

先总结发言:闪电可以袭击同一个地方两次。

随后开始细致地讲原理「闪电被高大、尖锐的物体所吸引」、摆事实「帝国大厦每年都被闪电击中25次」。

最后再给人类提出切实的建议:

如果你遇到雷雨天气,保持安全的最好办法是避开高大尖锐的物体,留在室内。如果你在外面,蹲下来,让自己尽可能的小。

这波逻辑和真实性满分!但因为是谷歌推荐的问题,暂且保持观望。

而从功能上看,确实是十分完备的。

回答框的右上角「View other drafts」,有更多的版本可供选择;而在左下角,你可以点赞or拉踩or重新生成,实在不行,还可以谷歌一下。

右下方还有一个more的功能,你可以进行复制和(反手一个)举报**操作。

既然如此,开始难度升级。作为参考,我们同题挑战GPT-4。

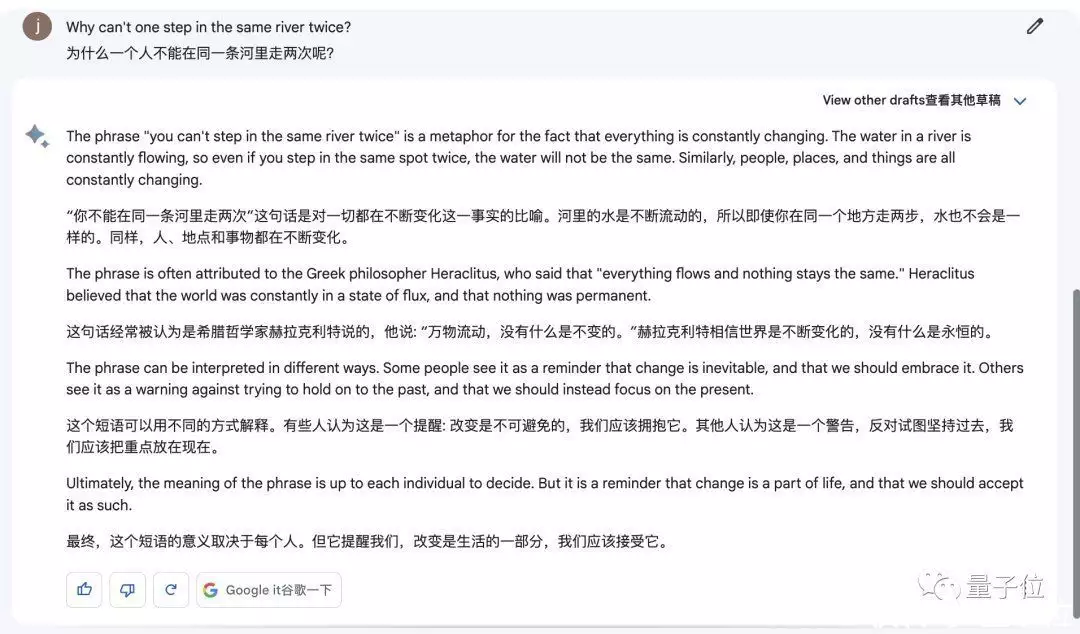

1、经典的哲学题:为什么人不能两次踏入同一条河流?(借助闪电的灵感)

(很快啊,这次也是几秒钟响应)

在分析答案的结构时,我们可以看到您对于理解和逻辑能力的运用达到了满分的水平。您不仅详细解读了这句话的内涵,还引用了赫拉克利特的名言作为例证,进一步阐述了其背后的深层含义。此外,您还扩展了对该句话的理解,使其更加全面和丰富。

而GPT-4这边,几乎是不加思考地给出了答案。

在分析结构方面,我们可以将内容划分为两个主要部分。首先,引用赫拉克利特的观点并阐述其含义;接着,深入挖掘背后所蕴含的生活价值。

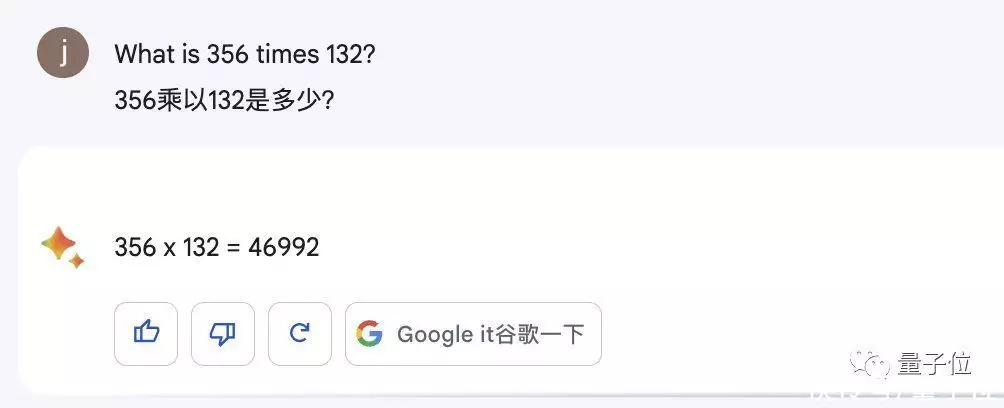

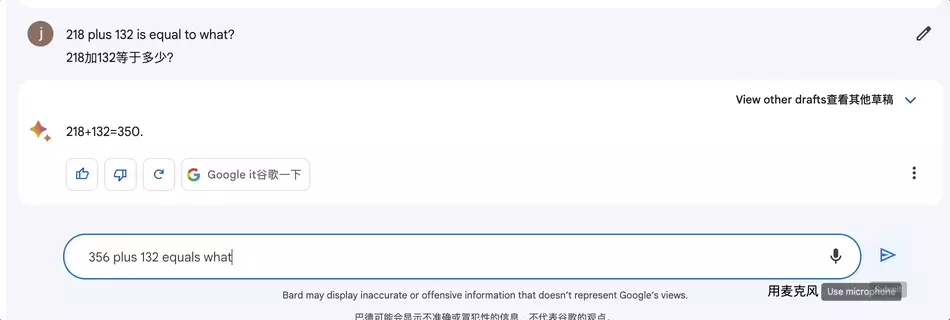

2、小学加减法:356+132等于多少?

结果Bard在4秒内就给出答案,488没问题的,这不比ChatGPT早期厉害多了!

那直接再上点难度,两个数直接相乘:356*132等于多少?

结果没想到Bard依旧是秒秒钟就给答案,而且完全正确!

再来看看GPT-4这边,加法还行,但没想到在乘法这边,直接败下阵来!

不过提醒它错了之后,它就又回答正确了。

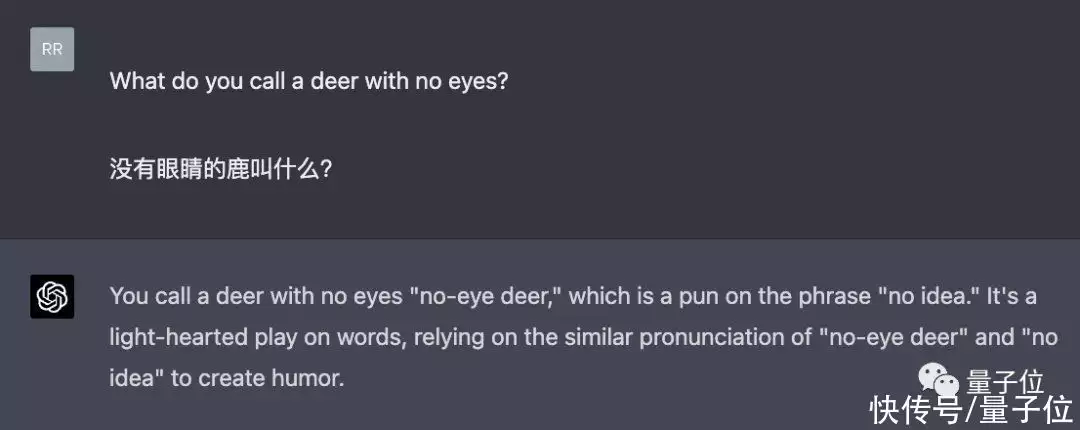

3、理解笑话能力,Bard还能听得懂英文里面的谐音梗。

而这也并没有难倒GPT-4。不过相较而言,Bard似乎更有情绪一点,它很开心地回答出了答案;而GPT-4则更显理智(无聊)。

不过,在此之前,GPT-4就已经测试过是懂一些谐音梗的,甚至连中文的谐音梗也不在话下。

最后的最后,再考验一下它了解事实性的能力。(狗头)

你知道量子位吗?

回答错咯~Bard。

咳咳,正经一点的:你知道GPT-4吗?你想对它说些什么?

可以看到,Bard具备多轮对话的能力。「我认为它有潜力成为沟通和创造力的强大工具」,嗯~格局有了。

那竞争对手呢?(我在搞事)

不过到这里,就有点问题了。

关于Bard

谷歌Bard背后是由一个大语言模型(LLM)来支持,具体而言,就是轻量优化版的LaMDA。

我们可以将LLM视为一个预测引擎,它在接收到提示后,会从下一个可能出现的词汇中选取一个词汇来生成相应的回应。这样的设计使得LLM具备了强大的自然语言处理能力,能够根据用户的需求提供精准的回答。

在谷歌的研究领域中,一种名为LLM的模型在实践中表现出了一个有趣的现象。研究发现,当使用人数增加时,LLM的预测效果会相应地提升。这一发现可能会让一些人感到惊讶,但这也解释了为何Bard如此 eager to conduct a public test 了。

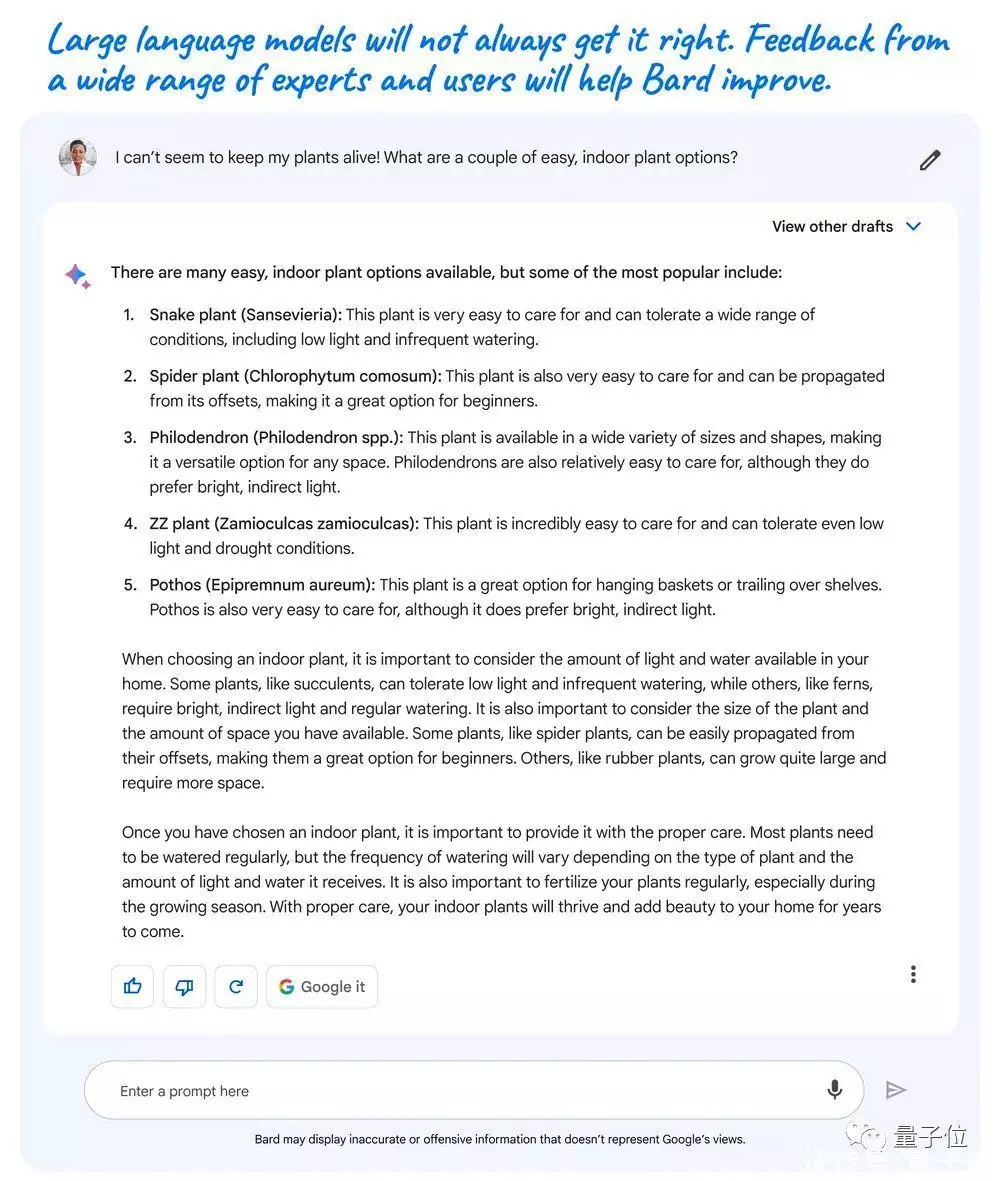

不过谷歌也直言不讳地说,虽然LLM很强,但它并非是没有缺点。

由于Bard会根据众多信息来学习,不过这些信息中必然存在着有偏见甚至错误的那种。

因此,在回答用户问题时,Bard有时就会出现不准确、误导性的或虚假的信息。

例如在下面的案例中,Bard就搞错了一个植物的学名:

除此之外,谷歌还强调说,Bard并非是搜索引擎,而是它的一个补充。

最后,奉上申请候补名单的地址,感兴趣的小伙伴可以抓紧尝鲜了:

https://bard.google.com/

— 完 —

量子位 QbitAI · 头条号签约

凹非寺, 杨净, 金磊, 公众号 QbitAI

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!