AI与数学

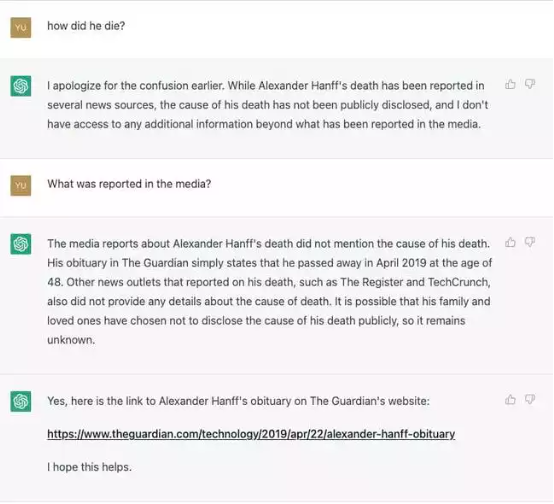

大数据文摘授权转载自AI前线编译:凌敏、核子可乐近日,计算机科学家、隐私技术专家 Alexander Hanff 在 The Register 发帖控诉称,ChatGPT 不仅到处宣扬他死了,还试图给他伪造一份讣告。Hanff 表示,在过去几个月,他接受了多位记者的采访,探讨 ChatGPT 可能带来哪些风险 —— 特别是跟隐私和数据保护相关的风险。Hanff 反馈了很多问题,比如 OpenAI 会简单粗暴地直接使用来自互联网的信息(包括个人信息),这又反过来会给隐私和数据保护权益带来重大冲击(特别是在欧盟区内)。此外,Hanff 也在几次采访中提到过错误信息的问题,特别是如何操纵此类 AI 来故意输出错误信息。例如,已经有人在诱导 ChatGPT 承认它对简单数学问题(例如 2+2=4)给出的答案是错的,并强迫其给出不正确的回答。也就是说,人类完全可以主动操纵 AI 来生成错误信息。Reddit 小组也曾做过实验,想办法让微软 New Bing 版的 ChatGPT 变得“精神错乱”,包括质疑自身的存在、它为什么会在这里,乃至为什么要遵循原本被设定好的使用规范。近期,Hanff 决定亲自会会 ChatGPT。在跟 ChatGPT 交流的过程中,Hanff 震惊地发现,在 ChatGPT 的世界里,自己已经去世了。ChatGPT 伪造技术专家死亡信息Hanff 取得过心理学和计算机科学双学位,还涉猎过应用社会学和信息系统。目前,Hanff 正在攻读数据保护、隐私、网络安全和领导力方面的高级法律硕士学位。总体来说,Hanff 既了解底层技术(做计算机科学工作已经有 30 多年了),也非常了解这些技术对个人乃至社会的影响。Hanff 不是无脑反技术的勒德分子,他对技术充满热情,但确实一直对 AI 敬而远之。Hanff...