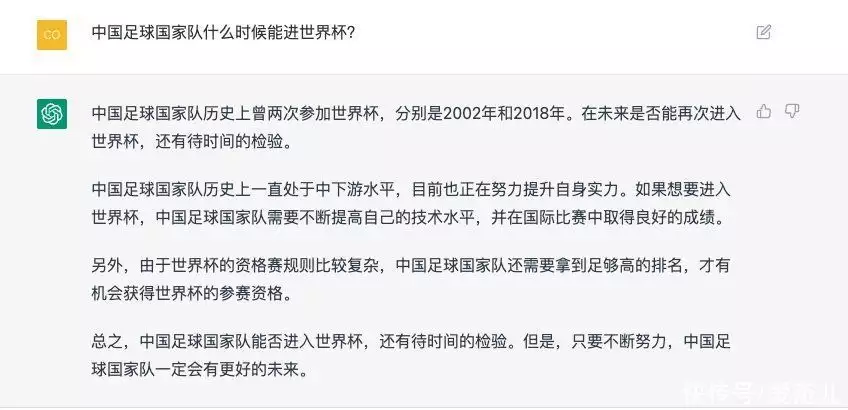

旗帜鲜明地支持 ChatGPT 干掉遍地垃圾的互联网内容刘亦菲上学时没人追?当看到她的学生照后,网友:我也不敢追

上知天文、下知地理的聊天机器人 ChatGPT,对话截图流传整个互联网——没跟它聊过秦皇汉武、新冠病毒的人生,是不完整的。 就在亚洲球队接连失利、告别 2022 卡塔尔世界杯之时, ChatGPT 给出了一个振奋人心的答案。也许,在某一个平行世界里,我们曾有两次入选世界杯正赛的辉煌。 这几天,每个人都看了太多 ChatGPT 的惊艳表演,无论是写论文,还是写代码,它都一气呵成,游刃有余。但它的回答依然具有一定的局限性,也不乏错误。如果你知道正确答案,不妨随意浏览。如果你不知道的话,还是慎重一点好。 ChatGPT 的深远意义在于,它拉高了世面上所有文章的下限。 绝大多数泛滥于各个渠道的文章,其准确性、知识性和逻辑性都远逊于 ChatGPT 。「众所周知」,互联网上有大量人力,要么做标题党,要么生产水文,要么炮制庸俗的话题。Google Webmaster 的趋势分析师 Gary Illyes 称,互联网上六成的内容是重复的。 但是,AI 写的文章再好,终究只是「短平快」的资料整合。 写作者不应该满足于 ChatGPT 这种赛博「影子写手」的套路;读者应该去追求更深入、更有质量的报道。 圣诞老人和圣诞树 ChatGPT特别擅长处理一些生活难题,比如家庭纠纷、情感问题等。 上个星期就流传一张 ChatGPT 帮人解答「妻子气恼丈夫嫌圣诞树太贵不买」的截图,ChatGPT 先拉架,说有事好商量千万不要情绪化,再给出解决方案——要么俩人自己动手做一个圣诞树,惠而不费;要么出门旅行,就不用在家死磕圣诞树的贵贱。 这个套路完全符合心理学理论:安抚情绪,站在说话人一边,然后理性地给出一些切实可行的办法。从这个角度看,ChatGPT 堪比最贴心的可爱朋友。 「圣诞」是十二月份的高频问题。Shopify 高管辛西娅·萨瓦德就对 ChatGPT「破防」了。ChatGPT 帮她给儿子解释圣诞老人:「我写信是为了让你知道,我不是一个真实的人,而是一个你父母出于爱告诉你的故事的角色。」 「你的父母给你讲了关于我和我的精灵的故事,以此给你的童年带来欢乐和魔法。他们希望你相信其中蕴含的精神和假日的魔力。」 文中充满感情地写道,「父母对你的爱和关心是真实的。他们为你创造了美好的回忆和传统,希望你的童年变得特别。」 两则「圣诞」的故事,实际上突显了 ChatGPT 作为新一代「聊天生成预训练转换器」的真正能力:尽量全面、得体、有信息量地像人类一样,回答人类提出的问题。 顺着人类心思作答 ChatGPT 来自 OpenAI...